أحد الأعمال الشائعة هو جريج يانغ ، وهو عضو مؤسس في xAI وتلميذ Yau Chengtong.

في السابق ، صرح Yange علنا أن اتجاهه البحثي في xAI هو "الرياضيات مقابل الذكاء الاصطناعي" و "الذكاء الاصطناعي للرياضيات".

أحد النقاط البارزة هو مواصلة بحثه السابق:

برامج Tensor ، وهي لغة برمجة موحدة تصف معماريات الشبكات العصبية - الإنجازات ذات الصلة ، وهي متوفرة بالفعل في GPT-4.

تركز هذه الورقة الجديدة ، التي تنتمي إلى السلسلة ، على "كيفية تدريب الشبكات العميقة اللانهائية".

تحقيقا لهذه الغاية ، أجرى Yange نفسه أيضا مشاركة بث مباشر على X.

دعونا نلقي نظرة على المحتوى الرائع الذي يستحق علامة ~

تدريب الشبكات العصبية العميقة اللانهائية

بعبارات بسيطة ، تدرس هذه الورقة توسع الشبكات المتبقية (ResNet) في اتجاه العمق.

نحن نعلم أن الشبكات المتبقية تحل مشكلة تدهور أداء الشبكات العصبية التلافيفية العميقة مع زيادة العمق. ولكن مع استمرار تعميق الشبكة ، لا يزال تدريب شبكة عميقة متبقية جيدة مهمة غير سهلة:

عندما تتعمق الشبكة ، سيستمر حجم الميزات في الزيادة ، مما يؤدي إلى عدم استقرار الشبكة. بعد تعميق الشبكة ، من الضروري إعادة ضبط المعلمات الفائقة ، وهي ليست كمية صغيرة من العمل ...

كانت الفكرة بالنسبة ل Yanger وأصدقائه هي إيجاد طريقة حدودية عميقة يمكنها تعلم الميزات وتحقيق نقل المعلمات الفائقة.

فكروا أولا في حدين للشبكات العصبية الواسعة بلا حدود: إما أجهزة النواة أو المتعلمين المميزين. بالنسبة للأخير ، لا تتغير المعلمات الفائقة المثلى مع العرض.

هنا ، قاموا بتحليل حدود شبكة واسعة لا نهائية باستخدام إطار برامج Tensor.

كما ذكرنا سابقا ، تعد برامج Tensor أحد أهداف Younger البحثية طويلة المدى: بناء لغة البرمجة الأساسية التي يمكنها وصف وتحليل معماريات الشبكات العصبية باللغة الرياضية.

على وجه التحديد ، تتكون برامج Tensor من وظائف ضرب المصفوفة والتنشيط. وجد يونغ أنه إذا كان من الممكن التعبير عن وظائف الشبكة العصبية بهذه اللغة ، فيمكن تهيئتها تلقائيا وبشكل كامل للتحليل.

جزء من الاشتقاق الرياضي ، دون توسع محدد هنا ، يمكننا أن نشعر بأسلوب الرسم بسطحية...

على أساس هذه التحليلات المشتقة ، يقترح المؤلفون طريقة Depth-μP ، والتي يمكن أن تحقق نقل المعلمات الفائقة في اتجاه العمق وتبسط إلى حد كبير تعديل المعلمات الفائقة في أعماق مختلفة.

يحتوي Depth-μP على النقاط التالية:

يتناسب المعامل a / sqrt (L) عكسيا مع الجذر التربيعي لكل فرع متبقي وعمق L.

ينخفض معدل التعلم لكل مصفوفة وزن مع زيادة العمق L ، اعتمادا على نوع خوارزمية التحسين. بالنسبة ل SGD ، يستغرق معدل التعلم η ثابتا ، وبالنسبة لخوارزميات التحسين التكيفي مثل Adam ، يأخذ معدل التعلم η / sqrt (L).

تجدر الإشارة إلى أن المؤلفين وجدوا أنه عندما يكون عمق الكتلة المتبقية هو 1 ، فإن Depth-μP هي الطريقة المثلى لمعلمات العمق ، والتي يمكن أن تضمن أن المعلمات الفائقة تتقارب مع زيادة العمق وتحقيق نقل المعلمات الفائقة في اتجاه العمق.

ومع ذلك ، عندما ≥ عمق الكتلة المتبقية 2 ، سيستمر فشل ترحيل المعلمات الفائقة وتدهور أداء التدريب.

بالإضافة إلى ذلك ، تستكشف الورقة مفهوم "تنوع الميزات" كدور رئيسي في الشبكات العميقة.

مؤلف مشارك آخر للورقة هو دينغلي يو من برينستون. تخرج من صف تسينغهوا ياو بدرجة البكالوريوس ويسعى حاليا للحصول على درجة الدكتوراه في علوم الكمبيوتر في برينستون.

**ماذا قال يانجر في البث المباشر؟ **

خلال البث المباشر ، أجاب Yange أيضا على الأسئلة التي تهم الجمهور. دون تغيير المعنى الأصلي ، قامت الكيوبتات بفرز بعض المشاكل.

س: بالنسبة للكثيرين منا ، قد يكون [محتوى الورقة] أبعد من فهمنا. لكنني أتساءل ، كيف يختلف النموذج الذي ذكرته عن تقنية ChatGPT و OpenAI التي يمكننا تجربتها؟ ما هي الاختلافات أو الابتكارات المهمة بين هذه الورقة ونتائج OpenAI؟

الأصغر سنا: اسمحوا لي أن أدلي بتعليق موجز ، وأود أن أقول إن هذه الخصائص لا ترتبط مباشرة بالتطبيقات العملية في الوقت الحالي ، ولكنها أشبه بالبحث في الطبيعة.

بطبيعة الحال ، فإن الهدف النهائي للقيام بكل هذا هو جعل النموذج أفضل وأكثر أمانا ، ومن ثم إفادة البشرية. ما نقوم به الآن هو وصف التأثير المقصود ، والذي ليس بالضرورة أن يكون له تأثير مباشر.

الآن بعد أن أصبحنا في نفس القارب ، فإننا نفعل ما في وسعنا ، سواء كان ذلك عملا قصير الأجل أو بحثا تطبيقيا طويل الأجل ، لجعله يعمل لصالح الجميع.

س: يبدو أنك تبني دماغا حاسوبيا اصطناعيا قادرا على التفكير ، فهل هذا ما تعمل عليه؟ بالإضافة إلى ذلك ، أنا أم وابني البالغ من العمر 7 سنوات مهتم جدا بالرياضيات ، هل لديك أي نصيحة يمكن أن تبقيه مهتما ومتحمسا في مجال الذكاء الاصطناعي؟

الأصغر سنا: يشير مصطلح "الويب الجديد" إلى الشبكات العصبية الاصطناعية ، والتي أعتقد أنها العمود الفقري للعديد من التقنيات الحديثة ، بما في ذلك Google و Facebook و Instagram وما إلى ذلك التي تستخدمها كل يوم ، وتستخدم هذه الخدمات هذه الشبكات العصبية الاصطناعية تحتها. ولدت هذه الشبكات منذ حوالي ستين أو سبعين عاما مستوحاة من الشبكات العصبية الحقيقية في الحيوانات والبشر ، لكنها انحرفت عن علم الأعصاب الحقيقي.

هذه الشبكات هي في الأساس مسائل رياضية ، لذا يمكننا فهم هذه الشبكات العصبية بعمق بعد أن نفهم هذه المشكلات الرياضية الجديدة ونقوم بالكثير من التحليل.

على الرغم من أننا لا نعرف حتى الآن بالضبط كيف تتصل الخلايا العصبية ، من خلال البحث الرياضي ، يمكننا تحسين هذه الشبكات العصبية الاصطناعية لمساعدة شركات التكنولوجيا على تحسين حياة الناس.

فيما يتعلق بسؤالك الثاني ، من الرائع أن تسمع أن ابنك مهتم جدا بالرياضيات. هذا هو الأساس لخلق إنجازات عظيمة في مجال التكنولوجيا وتحسين حياة الجميع.

النصيحة التي أود تقديمها هي أولا وقبل كل شيء أن تحافظ على شغف ابنك بالرياضيات ، وهو أمر مهم للغاية. بمجرد أن تفقد هذا الشغف ، يصبح من الصعب مواصلة التعلم.

انتبه أيضا إلى مراقبة ما يحبه ، مما يجعل عملية التعلم ممتعة ويزيد من تحفيز اهتمامه. في الوقت نفسه ، من الضروري أيضا تنمية فضوله حول مبدأ كيفية عمل الأشياء ، ومحاولة تنمية التفكير العلمي ، الذي يحركه الفضول للدراسة. إنه مثل تفكيك الأشياء ومحاولة فهم كيفية عملها.

إذا فقد المرء حماسه لاستكشاف الحقائق الرياضية للكون ، فقد يكون من الصعب اكتساب الزخم. بشكل عام ، أوصي بأن تنمي اهتمام ابنك العميق وفضوله حول العالم ، وخاصة طبيعة الرياضيات والعلوم.

س: لدي سؤال أكثر تجريدا. كانت لديك فكرة أن العمق يقترب من اللانهاية ، ثم كتبت هذه الورقة بناء على تلك الفكرة. هل فكرت في الشبكات العصبية ذات البنى المختلفة؟ ليست بنية قياسية مع الخلايا العصبية وطبقات لا حصر لها ، ولكن شيء مختلف تماما. على سبيل المثال ، ترتبط هذه الخلايا العصبية بطرق مختلفة تماما ، ربما نوع من المربع؟

الأصغر سنا: في الواقع ، فإن الأفكار حول اللاخطية وعدد الطبقات في عملنا هي دراسات بدائية للغاية. هناك بالتأكيد العديد من الأسئلة التي يمكن استكشافها حول ما هو الهيكل المناسب ، أو نوع الهيكل الذي يجب أن يكون.

على سبيل المثال ، درس فريق Meta سابقا ما يحدث للخلايا العصبية المتصلة عشوائيا وحصل على بعض النتائج المثيرة للاهتمام. لذلك ، هناك بالتأكيد الكثير للقيام به هنا. الآن ليس لدي حقا إجابة محددة لأقول ما هو الصحيح أو الأفضل تنظيما.

**عن جانج **

ولد يانغ جي في مقاطعة هونان ، وذهب إلى الولايات المتحدة بعد تخرجه من المدرسة الابتدائية ، حيث درس في جامعة هارفارد تحت إشراف البروفيسور تشنغتونغ ياو.

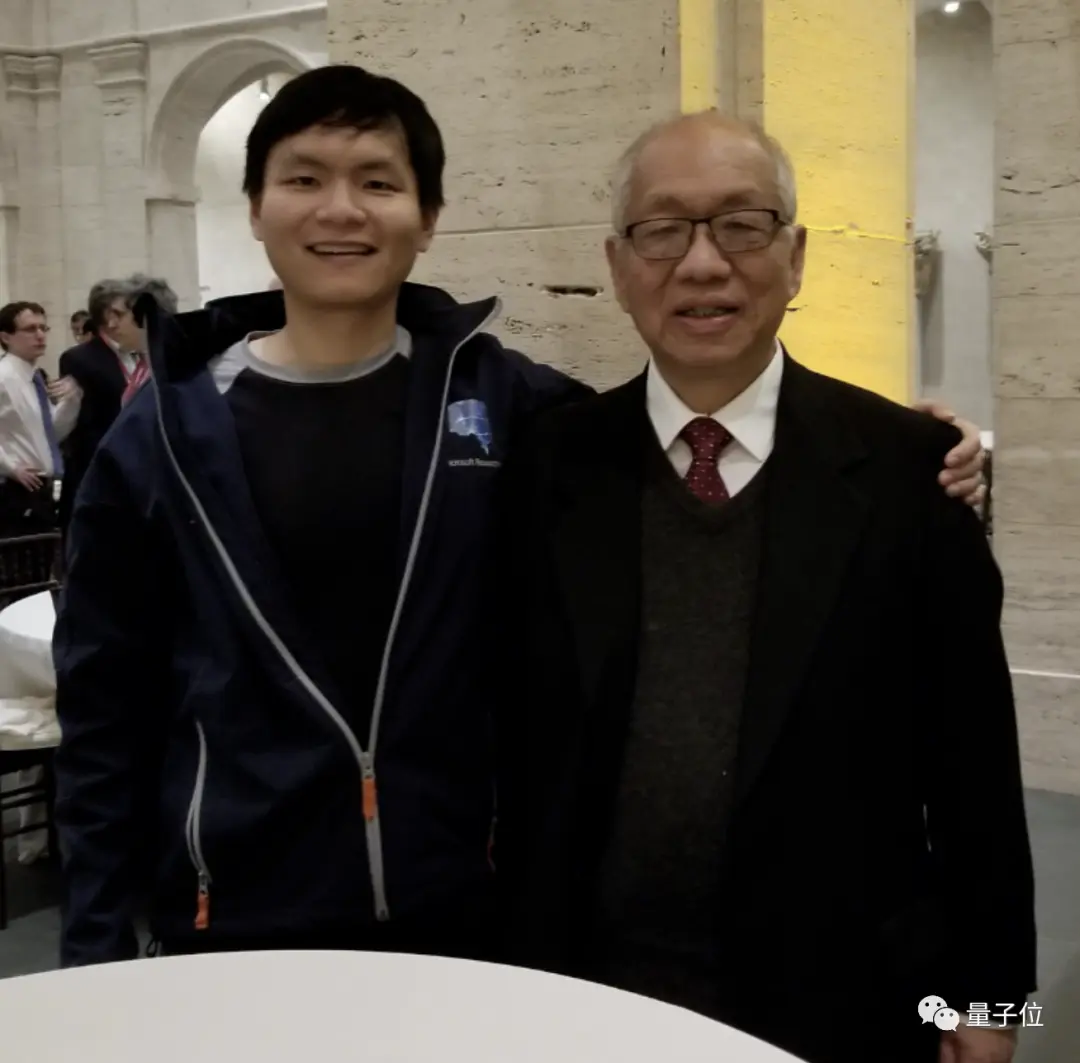

** △ يانغ جي وياو تشنغ تونغ ، المصدر: يانغ جي تويتر **

في عام 2017 ، تخرج يانغ من جامعة هارفارد ثم دخل مايكروسوفت بتوصية من شين شيانغيانغ.

في مايكروسوفت ، أشاد شين شيانغ يانغ بيانغ جي. قبل بضعة أشهر ، في منتدى يسمى "العلوم الأساسية والذكاء الاصطناعي" ، صرح شين شيانغيانغ علنا:

عادة ما تقوم > Microsoft Research بتجنيد طلاب الدكتوراه فقط ، ودخل Yange Microsoft Research كخريج جامعي. لم تدخل Microsoft Research فحسب ، بل حققت أيضا أداء جيدا للغاية في السنوات الخمس الماضية ، خاصة في تطوير GPT وقد قدمت مساهمة حاسمة.

تجدر الإشارة إلى أنه هو نفسه قد اعترف بأن GPT-4 يستخدم طريقة μTransfer (سلسلة برامج Tensor).

كانت أبحاث يونغر حول برامج Tensor موجودة منذ وقت مبكر جدا ، وتم نشر "Tensor Programs I" في عام 2019 ، واستمر في استكشافها بعمق عندما كان يعمل في Microsoft. وهو يعتقد أن أي حساب تقريبا في التعلم العميق يمكن تمثيله على أنه برامج Tensor.

في يوليو من هذا العام ، أعلن ماسك عن تشكيل شركة جديدة ، xAI ، وغادر يونغ Microsoft للانضمام إلى الفريق المؤسس ل xAI وأصبح عالم رياضيات في xAI.

بعد انضمامه إلى xAI ، كشف يونغ أكثر من مرة أن الهدف طويل المدى لمشروع برامج Tensor هو تطوير "نظرية لكل شيء" للتعلم العميق على نطاق واسع ، أي إيجاد قاعدة نظرية يمكنها حقا فهم سلوك الذكاء الاصطناعي النماذج الكبيرة.

وقال أيضا:

سيمكن > الذكاء الاصطناعي الجميع من فهم كوننا الرياضي بطرق لم يكن من الممكن تصورها من قبل.

رابط الورق:

شاهد النسخة الأصلية

قد تحتوي هذه الصفحة على محتوى من جهات خارجية، يتم تقديمه لأغراض إعلامية فقط (وليس كإقرارات/ضمانات)، ولا ينبغي اعتباره موافقة على آرائه من قبل Gate، ولا بمثابة نصيحة مالية أو مهنية. انظر إلى إخلاء المسؤولية للحصول على التفاصيل.

تم إصدار نتائج بحث ماسك الأولى ل xAI! الأعضاء المؤسسون الشباب وخريجي فئة ياو عملت بشكل مشترك

المصدر: الكيوبت

ماسك xAI ، أول نتيجة بحث عام هنا!

أحد الأعمال الشائعة هو جريج يانغ ، وهو عضو مؤسس في xAI وتلميذ Yau Chengtong.

في السابق ، صرح Yange علنا أن اتجاهه البحثي في xAI هو "الرياضيات مقابل الذكاء الاصطناعي" و "الذكاء الاصطناعي للرياضيات".

أحد النقاط البارزة هو مواصلة بحثه السابق:

برامج Tensor ، وهي لغة برمجة موحدة تصف معماريات الشبكات العصبية - الإنجازات ذات الصلة ، وهي متوفرة بالفعل في GPT-4.

تركز هذه الورقة الجديدة ، التي تنتمي إلى السلسلة ، على "كيفية تدريب الشبكات العميقة اللانهائية".

دعونا نلقي نظرة على المحتوى الرائع الذي يستحق علامة ~

تدريب الشبكات العصبية العميقة اللانهائية

بعبارات بسيطة ، تدرس هذه الورقة توسع الشبكات المتبقية (ResNet) في اتجاه العمق.

نحن نعلم أن الشبكات المتبقية تحل مشكلة تدهور أداء الشبكات العصبية التلافيفية العميقة مع زيادة العمق. ولكن مع استمرار تعميق الشبكة ، لا يزال تدريب شبكة عميقة متبقية جيدة مهمة غير سهلة:

عندما تتعمق الشبكة ، سيستمر حجم الميزات في الزيادة ، مما يؤدي إلى عدم استقرار الشبكة. بعد تعميق الشبكة ، من الضروري إعادة ضبط المعلمات الفائقة ، وهي ليست كمية صغيرة من العمل ...

كانت الفكرة بالنسبة ل Yanger وأصدقائه هي إيجاد طريقة حدودية عميقة يمكنها تعلم الميزات وتحقيق نقل المعلمات الفائقة.

فكروا أولا في حدين للشبكات العصبية الواسعة بلا حدود: إما أجهزة النواة أو المتعلمين المميزين. بالنسبة للأخير ، لا تتغير المعلمات الفائقة المثلى مع العرض.

كما ذكرنا سابقا ، تعد برامج Tensor أحد أهداف Younger البحثية طويلة المدى: بناء لغة البرمجة الأساسية التي يمكنها وصف وتحليل معماريات الشبكات العصبية باللغة الرياضية.

جزء من الاشتقاق الرياضي ، دون توسع محدد هنا ، يمكننا أن نشعر بأسلوب الرسم بسطحية...

يحتوي Depth-μP على النقاط التالية:

تجدر الإشارة إلى أن المؤلفين وجدوا أنه عندما يكون عمق الكتلة المتبقية هو 1 ، فإن Depth-μP هي الطريقة المثلى لمعلمات العمق ، والتي يمكن أن تضمن أن المعلمات الفائقة تتقارب مع زيادة العمق وتحقيق نقل المعلمات الفائقة في اتجاه العمق.

مؤلف مشارك آخر للورقة هو دينغلي يو من برينستون. تخرج من صف تسينغهوا ياو بدرجة البكالوريوس ويسعى حاليا للحصول على درجة الدكتوراه في علوم الكمبيوتر في برينستون.

**ماذا قال يانجر في البث المباشر؟ **

خلال البث المباشر ، أجاب Yange أيضا على الأسئلة التي تهم الجمهور. دون تغيير المعنى الأصلي ، قامت الكيوبتات بفرز بعض المشاكل.

س: بالنسبة للكثيرين منا ، قد يكون [محتوى الورقة] أبعد من فهمنا. لكنني أتساءل ، كيف يختلف النموذج الذي ذكرته عن تقنية ChatGPT و OpenAI التي يمكننا تجربتها؟ ما هي الاختلافات أو الابتكارات المهمة بين هذه الورقة ونتائج OpenAI؟

الأصغر سنا: اسمحوا لي أن أدلي بتعليق موجز ، وأود أن أقول إن هذه الخصائص لا ترتبط مباشرة بالتطبيقات العملية في الوقت الحالي ، ولكنها أشبه بالبحث في الطبيعة.

بطبيعة الحال ، فإن الهدف النهائي للقيام بكل هذا هو جعل النموذج أفضل وأكثر أمانا ، ومن ثم إفادة البشرية. ما نقوم به الآن هو وصف التأثير المقصود ، والذي ليس بالضرورة أن يكون له تأثير مباشر.

الآن بعد أن أصبحنا في نفس القارب ، فإننا نفعل ما في وسعنا ، سواء كان ذلك عملا قصير الأجل أو بحثا تطبيقيا طويل الأجل ، لجعله يعمل لصالح الجميع.

س: يبدو أنك تبني دماغا حاسوبيا اصطناعيا قادرا على التفكير ، فهل هذا ما تعمل عليه؟ بالإضافة إلى ذلك ، أنا أم وابني البالغ من العمر 7 سنوات مهتم جدا بالرياضيات ، هل لديك أي نصيحة يمكن أن تبقيه مهتما ومتحمسا في مجال الذكاء الاصطناعي؟

الأصغر سنا: يشير مصطلح "الويب الجديد" إلى الشبكات العصبية الاصطناعية ، والتي أعتقد أنها العمود الفقري للعديد من التقنيات الحديثة ، بما في ذلك Google و Facebook و Instagram وما إلى ذلك التي تستخدمها كل يوم ، وتستخدم هذه الخدمات هذه الشبكات العصبية الاصطناعية تحتها. ولدت هذه الشبكات منذ حوالي ستين أو سبعين عاما مستوحاة من الشبكات العصبية الحقيقية في الحيوانات والبشر ، لكنها انحرفت عن علم الأعصاب الحقيقي.

هذه الشبكات هي في الأساس مسائل رياضية ، لذا يمكننا فهم هذه الشبكات العصبية بعمق بعد أن نفهم هذه المشكلات الرياضية الجديدة ونقوم بالكثير من التحليل.

على الرغم من أننا لا نعرف حتى الآن بالضبط كيف تتصل الخلايا العصبية ، من خلال البحث الرياضي ، يمكننا تحسين هذه الشبكات العصبية الاصطناعية لمساعدة شركات التكنولوجيا على تحسين حياة الناس.

فيما يتعلق بسؤالك الثاني ، من الرائع أن تسمع أن ابنك مهتم جدا بالرياضيات. هذا هو الأساس لخلق إنجازات عظيمة في مجال التكنولوجيا وتحسين حياة الجميع.

النصيحة التي أود تقديمها هي أولا وقبل كل شيء أن تحافظ على شغف ابنك بالرياضيات ، وهو أمر مهم للغاية. بمجرد أن تفقد هذا الشغف ، يصبح من الصعب مواصلة التعلم.

انتبه أيضا إلى مراقبة ما يحبه ، مما يجعل عملية التعلم ممتعة ويزيد من تحفيز اهتمامه. في الوقت نفسه ، من الضروري أيضا تنمية فضوله حول مبدأ كيفية عمل الأشياء ، ومحاولة تنمية التفكير العلمي ، الذي يحركه الفضول للدراسة. إنه مثل تفكيك الأشياء ومحاولة فهم كيفية عملها.

إذا فقد المرء حماسه لاستكشاف الحقائق الرياضية للكون ، فقد يكون من الصعب اكتساب الزخم. بشكل عام ، أوصي بأن تنمي اهتمام ابنك العميق وفضوله حول العالم ، وخاصة طبيعة الرياضيات والعلوم.

س: لدي سؤال أكثر تجريدا. كانت لديك فكرة أن العمق يقترب من اللانهاية ، ثم كتبت هذه الورقة بناء على تلك الفكرة. هل فكرت في الشبكات العصبية ذات البنى المختلفة؟ ليست بنية قياسية مع الخلايا العصبية وطبقات لا حصر لها ، ولكن شيء مختلف تماما. على سبيل المثال ، ترتبط هذه الخلايا العصبية بطرق مختلفة تماما ، ربما نوع من المربع؟

الأصغر سنا: في الواقع ، فإن الأفكار حول اللاخطية وعدد الطبقات في عملنا هي دراسات بدائية للغاية. هناك بالتأكيد العديد من الأسئلة التي يمكن استكشافها حول ما هو الهيكل المناسب ، أو نوع الهيكل الذي يجب أن يكون.

على سبيل المثال ، درس فريق Meta سابقا ما يحدث للخلايا العصبية المتصلة عشوائيا وحصل على بعض النتائج المثيرة للاهتمام. لذلك ، هناك بالتأكيد الكثير للقيام به هنا. الآن ليس لدي حقا إجابة محددة لأقول ما هو الصحيح أو الأفضل تنظيما.

**عن جانج **

ولد يانغ جي في مقاطعة هونان ، وذهب إلى الولايات المتحدة بعد تخرجه من المدرسة الابتدائية ، حيث درس في جامعة هارفارد تحت إشراف البروفيسور تشنغتونغ ياو.

** △ يانغ جي وياو تشنغ تونغ ، المصدر: يانغ جي تويتر **

△ يانغ جي وياو تشنغ تونغ ، المصدر: يانغ جي تويتر **

في عام 2017 ، تخرج يانغ من جامعة هارفارد ثم دخل مايكروسوفت بتوصية من شين شيانغيانغ.

في مايكروسوفت ، أشاد شين شيانغ يانغ بيانغ جي. قبل بضعة أشهر ، في منتدى يسمى "العلوم الأساسية والذكاء الاصطناعي" ، صرح شين شيانغيانغ علنا:

عادة ما تقوم > Microsoft Research بتجنيد طلاب الدكتوراه فقط ، ودخل Yange Microsoft Research كخريج جامعي. لم تدخل Microsoft Research فحسب ، بل حققت أيضا أداء جيدا للغاية في السنوات الخمس الماضية ، خاصة في تطوير GPT وقد قدمت مساهمة حاسمة.

تجدر الإشارة إلى أنه هو نفسه قد اعترف بأن GPT-4 يستخدم طريقة μTransfer (سلسلة برامج Tensor).

كانت أبحاث يونغر حول برامج Tensor موجودة منذ وقت مبكر جدا ، وتم نشر "Tensor Programs I" في عام 2019 ، واستمر في استكشافها بعمق عندما كان يعمل في Microsoft. وهو يعتقد أن أي حساب تقريبا في التعلم العميق يمكن تمثيله على أنه برامج Tensor.

في يوليو من هذا العام ، أعلن ماسك عن تشكيل شركة جديدة ، xAI ، وغادر يونغ Microsoft للانضمام إلى الفريق المؤسس ل xAI وأصبح عالم رياضيات في xAI.

بعد انضمامه إلى xAI ، كشف يونغ أكثر من مرة أن الهدف طويل المدى لمشروع برامج Tensor هو تطوير "نظرية لكل شيء" للتعلم العميق على نطاق واسع ، أي إيجاد قاعدة نظرية يمكنها حقا فهم سلوك الذكاء الاصطناعي النماذج الكبيرة.

وقال أيضا:

سيمكن > الذكاء الاصطناعي الجميع من فهم كوننا الرياضي بطرق لم يكن من الممكن تصورها من قبل.

رابط الورق: