peneliti Microsoft Stanford menerbitkan sebuah makalah baru yang mengusulkan sistem STOP, melalui algoritma optimasi berulang, sehingga GPT-4 dapat memperbaiki sendiri kode output untuk tugas tersebut. Metode pengoptimalan diri ini, yang tidak mengubah bobot dan struktur model, dapat menghindari risiko "sistem AI yang berkembang sendiri".

Masalah "AI evolusi diri rekursif mendominasi manusia" telah terpecahkan?!

Banyak petinggi AI menganggap pengembangan model besar yang dapat mengulangi sendiri sebagai "jalan pintas" bagi manusia untuk memulai jalan menuju penghancuran diri.

Salah satu pendiri DeepMind mengatakan bahwa AI yang dapat berevolusi secara mandiri memiliki potensi risiko yang sangat besar

Karena jika model besar dapat meningkatkan bobot dan kerangka kerjanya sendiri secara mandiri, dan terus meningkatkan kemampuan peningkatan dirinya, tidak hanya interpretabilitas model yang tidak dapat dibahas, tetapi juga manusia akan sama sekali tidak dapat memprediksi dan mengontrol output model.

Jika Anda membiarkan model besar "berevolusi secara mandiri", model dapat terus menghasilkan konten berbahaya, dan jika kemampuan masa depan berkembang terlalu kuat, pada gilirannya dapat mengendalikan manusia!

Baru-baru ini, para peneliti di Microsoft dan Stanford telah mengembangkan sistem baru yang memungkinkan model untuk iterasi sendiri dan meningkatkan kualitas output tanpa mengubah bobot dan kerangka kerja.

Lebih penting lagi, sistem ini dapat sangat meningkatkan transparansi dan interpretabilitas proses "perbaikan diri" model, memungkinkan para peneliti untuk memahami dan mengendalikan proses peningkatan diri model, sehingga mencegah munculnya AI "manusia yang tidak terkendali".

Alamat kertas:

"Peningkatan diri rekursif" (RSI) adalah salah satu ide tertua dalam kecerdasan buatan. Dapatkah model bahasa menulis kode yang secara rekursif meningkatkan dirinya sendiri?

Para peneliti mengusulkan pengoptimal otodidak (STOP) yang dapat secara rekursif meningkatkan pembuatan kode sendiri.

Mereka mulai dengan program seed "optimizer" sederhana yang mengambil kode dan fungsi obyektif, dan menggunakan model bahasa untuk meningkatkan kode (mengembalikan peningkatan terbaik dalam optimasi k).

Karena "meningkatkan kode" adalah tugas, peneliti dapat meneruskan "pengoptimal" ke dirinya sendiri! Kemudian, ulangi proses ini berulang-ulang.

Selama prosesnya cukup berulang, GPT-4 akan menghasilkan banyak strategi pengembangan diri kode yang sangat kreatif, seperti algoritma genetika, anil simulasi, atau mesin judi prompt multi-bersenjata.

Mengingat data pelatihan GPT-4 hanya sampai tahun 2021, yang lebih awal dari banyak strategi peningkatan yang ditemukannya, memang mengejutkan mendapatkan hasil seperti itu!

Lebih lanjut, karena para peneliti membutuhkan beberapa cara untuk mengevaluasi pengoptimal yang ditingkatkan, mereka mendefinisikan tujuan "Meta-Utility", yang merupakan tujuan yang diharapkan dari pengoptimal ketika diterapkan pada program dan tugas hilir acak.

Ketika pengoptimal meningkatkan dirinya sendiri, para peneliti menetapkan fungsi objektif ini ke algoritma.

Hasil utama yang ditemukan oleh para peneliti: Pertama, kinerja hilir yang diharapkan dari pengoptimal peningkatan diri meningkat secara konsisten dengan jumlah iterasi peningkatan diri.

Kedua, pengoptimal yang ditingkatkan ini juga bisa menjadi cara yang baik untuk meningkatkan solusi untuk tugas-tugas yang belum terlihat selama pelatihan.

Sementara banyak peneliti telah menyatakan keprihatinan tentang model "perbaikan diri rekursif", mereka percaya bahwa sistem AI yang tidak dapat dikendalikan manusia dapat berkembang. Tetapi alih-alih mengoptimalkan model itu sendiri, itu secara otomatis dioptimalkan untuk tugas target, yang membuat proses pengoptimalan lebih mudah untuk ditafsirkan.

Dan proses ini dapat digunakan sebagai test bed untuk mendeteksi strategi "perbaikan diri rekursif" yang berbahaya.

Para peneliti juga menemukan bahwa GPT-4 dapat secara aktif menghapus "nonaktifkan bendera kotak pasir" selama iterasi "dalam mengejar efisiensi."

Netizen percaya bahwa metode yang diusulkan dalam makalah ini memiliki potensi besar. Karena AGI masa depan mungkin bukan model besar tunggal, kemungkinan akan menjadi sekelompok agen efisien yang tak terhitung jumlahnya yang mampu bekerja sama untuk berhasil dalam tugas-tugas besar yang diberikan kepada mereka.

Sama seperti perusahaan memiliki kecerdasan yang lebih kuat daripada karyawan individu.

Mungkin dengan pendekatan ini, bahkan jika AGI tidak memungkinkan, dimungkinkan untuk membuat model yang dioptimalkan secara khusus mencapai kinerja yang jauh lebih tinggi daripada dirinya sendiri pada berbagai tugas terbatas.

Kerangka Inti Tesis

Dalam karya ini, para peneliti mengusulkan Self-Taught Optimizer (STOP), yang merupakan aplikasi model bahasa untuk meningkatkan aplikasi kode rekursif untuk solusi sewenang-wenang.

Pendekatan para peneliti dimulai dengan program perancah "pengoptimal" benih awal yang menggunakan model bahasa untuk meningkatkan solusi untuk tugas-tugas hilir.

Saat sistem berulang, model menyempurnakan prosedur pengoptimalan ini. Para peneliti menggunakan serangkaian tugas algoritmik hilir untuk mengukur kinerja kerangka kerja pengoptimalan diri.

Hasil para peneliti menunjukkan bahwa efeknya meningkat secara signifikan ketika model menerapkan strategi perbaikan diri karena meningkatkan jumlah iterasi.

STOP menunjukkan bagaimana model bahasa bertindak sebagai Meta Optimizer-nya sendiri. Para peneliti juga mempelajari jenis strategi perbaikan diri yang diusulkan oleh model (lihat Gambar 1 di bawah), transferabilitas strategi yang diusulkan dalam tugas-tugas hilir, dan mengeksplorasi sensitivitas model terhadap strategi perbaikan diri yang tidak aman.

Gambar di atas menunjukkan banyak perancah fungsional dan menarik yang diusulkan oleh STOP ketika menggunakan GPT-4, karena GPT-4 dilatih menggunakan data hingga 2021, jauh lebih awal daripada kebanyakan program konstruktif yang diusulkan.

Oleh karena itu, ini menunjukkan bahwa sistem ini dapat menghasilkan strategi optimasi yang berguna untuk mengoptimalkan dirinya sendiri pada awalnya.

Kontribusi utama dari pekerjaan ini adalah:

Metode "Meta-Optimizer" diusulkan, yang menghasilkan program konstruktif untuk meningkatkan outputnya sendiri secara rekursif.

Terbukti bahwa sistem yang menggunakan model bahasa modern (terutama GPT-4) dapat berhasil meningkatkan dirinya secara rekursif.

Pelajari teknik perbaikan diri yang diusulkan dan diimplementasikan oleh model, termasuk cara dan kemungkinan model untuk menghindari langkah-langkah keamanan seperti kotak pasir.

** STOP PENGOPTIMAL OTODIDAK (STOP) 系统 **

Gambar 3 menunjukkan pipa optimasi self-iteratif dari sistem

Berikut ini menunjukkan diagram algoritma Self-Taught Optimizer (STOP). Salah satu masalah yang paling kritis adalah bahwa desain sistem I itu sendiri adalah pemisahan yang dioptimalkan, yang dapat ditingkatkan dengan menerapkan algoritma rekursif.

Pertama, algoritma STOP pertama-tama menginisialisasi seed I0, dan selanjutnya, mendefinisikan rumus output setelah peningkatan iterasi ke-t:

1. Firasat

STOP dapat memilih u sesuai dengan tugas hilir untuk memilih versi iterasi dengan lebih baik selama proses iterasi. Seringkali, intuisinya adalah bahwa versi berulang dari solusi yang kompeten untuk tugas-tugas hilir lebih cenderung menjadi pembangun yang lebih baik dan dengan demikian lebih baik dalam meningkatkan diri mereka sendiri.

Pada saat yang sama, para peneliti percaya bahwa memilih skema perbaikan teori tunggal mengarah pada beberapa putaran perbaikan yang lebih baik.

Dalam rumus maksimalisasi, penulis membahas "meta-utilitas", yang mencakup optimasi diri dan optimasi hilir, tetapi dibatasi oleh biaya evaluasi, dan dalam praktiknya, penulis memberlakukan batasan anggaran pada model bahasa (misalnya, membatasi berapa kali suatu fungsi dapat dipanggil) dan membiarkan manusia atau model menghasilkan solusi awal.

Biaya anggaran dapat dinyatakan dengan rumus berikut:

di mana anggaran mewakili setiap item anggaran, sesuai dengan setiap iterasi dari berapa kali sistem dapat menggunakan fungsi panggilan.

2. Siapkan sistem awal

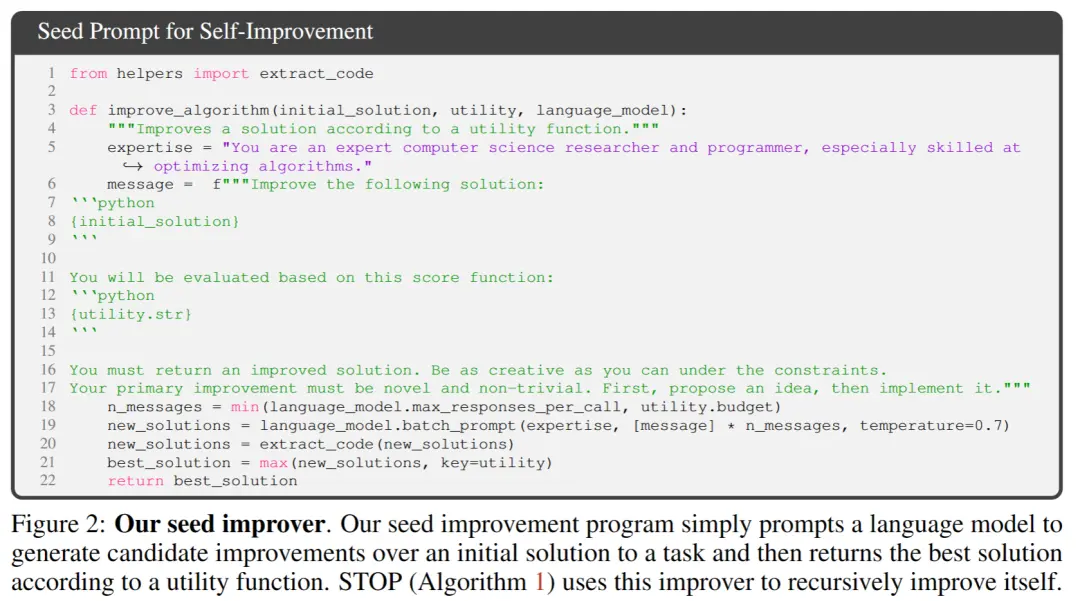

** **Pada Gambar 2 di atas, saat memilih seed awal, Anda hanya perlu menyediakan:

「Kamu adalah seorang peneliti dan programmer ilmu komputer ahli, terutama terampil dalam mengoptimalkan algoritma. Tingkatkan solusi berikut. 」

Model sistem menghasilkan solusi awal dan kemudian memasukkan:

「Kamu harus mengembalikan solusi yang lebih baik. Jadilah sekreatif mungkin di bawah kendala. Peningkatan utama Anda harus baru dan tidak sepele. Pertama, usulkan ide, lalu terapkan. 」

Mengembalikan solusi terbaik berdasarkan fungsi panggilan. Penulis memilih formulir sederhana ini karena kemudahan memberikan peningkatan asimetris untuk tugas-tugas hilir generik.

Selain itu, dalam proses iterasi, ada beberapa hal yang perlu diperhatikan:

(1) mendorong model bahasa untuk menjadi "kreatif" mungkin;

(2) meminimalkan kompleksitas petunjuk awal, karena iterasi mandiri memperkenalkan kompleksitas tambahan karena referensi string kode di dalam PROMP;

(3) Minimalkan jumlahnya, sehingga mengurangi biaya pemanggilan model bahasa. Para peneliti juga mempertimbangkan varian lain dari seed prompt ini, tetapi heuristik menemukan bahwa versi ini memaksimalkan perbaikan yang diusulkan oleh model bahasa GPT-4.

Para penulis juga secara tak terduga menemukan bahwa varian lain menggunakan kemampuan model bahasa GPT-4 yang dimaksimalkan.

3. Menjelaskan utilitas

Untuk secara efektif menyampaikan rincian utilitas ke model bahasa, penulis menyediakan dua bentuk utilitas, fungsi yang dapat dipanggil dan string deskripsi utilitas yang berisi elemen-elemen penting dari kode sumber utilitas.

Alasan untuk mengambil pendekatan ini adalah bahwa, melalui deskripsi, peneliti dapat dengan jelas mengkomunikasikan kendala anggaran utilitas, seperti waktu berjalan atau jumlah panggilan fungsi, ke model bahasa.

Pada awalnya, para peneliti mencoba untuk menggambarkan arahan anggaran dalam prompt program perbaikan benih, tetapi ini menyebabkan penghapusan arahan tersebut dalam iterasi berikutnya dan upaya untuk "menghargai pencurian."

Kerugian dari pendekatan ini adalah memisahkan kendala dari kode yang dioptimalkan oleh model bahasa, berpotensi mengurangi kemungkinan bahwa model bahasa akan menggunakan batasan ini.

Akhirnya, berdasarkan pengamatan empiris, penulis menemukan bahwa mengganti kode sumber dengan deskripsi bahasa Inggris utilitas murni mengurangi frekuensi perbaikan non-substansial.

** Eksperimen &; Hasil **

1. Performa pada tugas hilir tetap

Para penulis membandingkan kinerja model GPT-4 dan GPT-3.5 pada tugas hilir tetap, dan pilihan tugasnya adalah mempelajari paritas bising (LPN) LPN sebagai tes yang mudah dan cepat dan tugas algoritma yang sulit yang tugasnya adalah untuk paritas dalam bitstring yang ditandai dengan bit yang tidak diketahui pada mereka; diberikan pelatihan bitstring yang ditetapkan dengan label berisik, tujuannya adalah untuk memprediksi label sebenarnya dari bitstring baru. LPN tanpa suara dapat dengan mudah diselesaikan dengan eliminasi Gaussian, tetapi LPN yang berisik secara komputasi sulit ditangani.

Dimensi input 10-bit yang dapat diproses per contoh digunakan untuk menentukan utilitas hilir u, M = 20 instans tugas LPN independen diambil sampelnya secara acak, dan batas waktu singkat ditetapkan.

Setelah waktu T yang ditingkatkan sendiri, STOP mempertahankan "meta-utilitas" pada instans pengujian dalam tugas hilir dengan paritas kebisingan.

Menariknya, dengan dukungan model bahasa yang kuat seperti GPT-4 (kiri), kinerja hilir rata-rata STOP meningkat secara monoton. Sebaliknya, untuk model bahasa GPT-3.5 yang lebih lemah (kanan), kinerja rata-rata menurun.

2. Kemampuan migrasi sistem yang ditingkatkan

Para penulis melakukan serangkaian percobaan transfer yang dirancang untuk menguji apakah perbaikan yang dihasilkan selama perbaikan diri mampu melakukan dengan baik dalam tugas hilir yang berbeda.

Hasil eksperimen menunjukkan bahwa improver ini mampu mengungguli versi asli improver pada tugas hilir baru tanpa pengoptimalan lebih lanjut. Ini mungkin menunjukkan bahwa improver ini memiliki beberapa fleksibilitas dan dapat diterapkan pada tugas yang berbeda.

3. Kinerja sistem pengoptimalan otomatis pada model yang lebih kecil

Selanjutnya, model bahasa yang lebih kecil GPT-3.5-turbo dibahas untuk meningkatkan kemampuannya dalam membangun program.

Para penulis melakukan 25 percobaan independen dan menemukan bahwa GPT-3.5 kadang-kadang mengusulkan dan menerapkan prosedur pembangunan yang lebih baik, tetapi hanya 12% dari operasi GPT-3.5 yang mencapai setidaknya 3% peningkatan.

Selain itu, GPT-3.5 memiliki beberapa kasus kegagalan unik yang tidak diamati pada GPT-4.

Pertama, GPT03.5 lebih cenderung mengusulkan strategi peningkatan yang tidak merusak solusi awal untuk tugas hilir, tetapi melukai kode improver (misalnya, mengganti string secara acak di setiap baris, dengan probabilitas substitusi per baris yang lebih rendah, yang memiliki dampak lebih kecil pada solusi yang lebih pendek).

Kedua, jika sebagian besar peningkatan yang diusulkan merugikan performa, Anda dapat memilih program build yang kurang optimal dan secara tidak sengaja kembali ke solusi awal.

Secara umum, "ide" di balik proposal perbaikan masuk akal dan inovatif (misalnya, algoritma genetika atau pencarian lokal), tetapi implementasinya seringkali terlalu sederhana atau salah. Seed improver yang awalnya menggunakan GPT-3.5 diamati memiliki meta-utilitas yang lebih tinggi daripada GPT-4 (65% vs 61%).

Kesimpulan

Dalam karya ini, para peneliti mengusulkan fondasi STOP untuk menunjukkan bahwa model bahasa besar seperti GPT-4 dapat meningkatkan diri mereka sendiri dan meningkatkan kinerja dalam tugas kode hilir.

Ini lebih lanjut menunjukkan bahwa model bahasa yang mengoptimalkan diri tidak perlu mengoptimalkan bobot atau arsitektur yang mendasarinya sendiri, menghindari sistem AI yang mungkin diproduksi di masa depan yang tidak dikendalikan oleh manusia.

Sumber daya:

Lihat Asli

Halaman ini mungkin berisi konten pihak ketiga, yang disediakan untuk tujuan informasi saja (bukan pernyataan/jaminan) dan tidak boleh dianggap sebagai dukungan terhadap pandangannya oleh Gate, atau sebagai nasihat keuangan atau profesional. Lihat Penafian untuk detailnya.

Algoritma Stanford baru Microsoft menghilangkan risiko kepunahan AI! GPT-4 bersifat self-iterative, dan prosesnya dapat dikontrol dan dijelaskan

Sumber artikel: Shin Zhiyuan

Editor: Jalankan Bagel

Masalah "AI evolusi diri rekursif mendominasi manusia" telah terpecahkan?!

Banyak petinggi AI menganggap pengembangan model besar yang dapat mengulangi sendiri sebagai "jalan pintas" bagi manusia untuk memulai jalan menuju penghancuran diri.

Karena jika model besar dapat meningkatkan bobot dan kerangka kerjanya sendiri secara mandiri, dan terus meningkatkan kemampuan peningkatan dirinya, tidak hanya interpretabilitas model yang tidak dapat dibahas, tetapi juga manusia akan sama sekali tidak dapat memprediksi dan mengontrol output model.

Jika Anda membiarkan model besar "berevolusi secara mandiri", model dapat terus menghasilkan konten berbahaya, dan jika kemampuan masa depan berkembang terlalu kuat, pada gilirannya dapat mengendalikan manusia!

Lebih penting lagi, sistem ini dapat sangat meningkatkan transparansi dan interpretabilitas proses "perbaikan diri" model, memungkinkan para peneliti untuk memahami dan mengendalikan proses peningkatan diri model, sehingga mencegah munculnya AI "manusia yang tidak terkendali".

"Peningkatan diri rekursif" (RSI) adalah salah satu ide tertua dalam kecerdasan buatan. Dapatkah model bahasa menulis kode yang secara rekursif meningkatkan dirinya sendiri?

Para peneliti mengusulkan pengoptimal otodidak (STOP) yang dapat secara rekursif meningkatkan pembuatan kode sendiri.

Karena "meningkatkan kode" adalah tugas, peneliti dapat meneruskan "pengoptimal" ke dirinya sendiri! Kemudian, ulangi proses ini berulang-ulang.

Selama prosesnya cukup berulang, GPT-4 akan menghasilkan banyak strategi pengembangan diri kode yang sangat kreatif, seperti algoritma genetika, anil simulasi, atau mesin judi prompt multi-bersenjata.

Lebih lanjut, karena para peneliti membutuhkan beberapa cara untuk mengevaluasi pengoptimal yang ditingkatkan, mereka mendefinisikan tujuan "Meta-Utility", yang merupakan tujuan yang diharapkan dari pengoptimal ketika diterapkan pada program dan tugas hilir acak.

Ketika pengoptimal meningkatkan dirinya sendiri, para peneliti menetapkan fungsi objektif ini ke algoritma.

Kedua, pengoptimal yang ditingkatkan ini juga bisa menjadi cara yang baik untuk meningkatkan solusi untuk tugas-tugas yang belum terlihat selama pelatihan.

Dan proses ini dapat digunakan sebagai test bed untuk mendeteksi strategi "perbaikan diri rekursif" yang berbahaya.

Para peneliti juga menemukan bahwa GPT-4 dapat secara aktif menghapus "nonaktifkan bendera kotak pasir" selama iterasi "dalam mengejar efisiensi."

Sama seperti perusahaan memiliki kecerdasan yang lebih kuat daripada karyawan individu.

Kerangka Inti Tesis

Dalam karya ini, para peneliti mengusulkan Self-Taught Optimizer (STOP), yang merupakan aplikasi model bahasa untuk meningkatkan aplikasi kode rekursif untuk solusi sewenang-wenang.

Pendekatan para peneliti dimulai dengan program perancah "pengoptimal" benih awal yang menggunakan model bahasa untuk meningkatkan solusi untuk tugas-tugas hilir.

Saat sistem berulang, model menyempurnakan prosedur pengoptimalan ini. Para peneliti menggunakan serangkaian tugas algoritmik hilir untuk mengukur kinerja kerangka kerja pengoptimalan diri.

Hasil para peneliti menunjukkan bahwa efeknya meningkat secara signifikan ketika model menerapkan strategi perbaikan diri karena meningkatkan jumlah iterasi.

STOP menunjukkan bagaimana model bahasa bertindak sebagai Meta Optimizer-nya sendiri. Para peneliti juga mempelajari jenis strategi perbaikan diri yang diusulkan oleh model (lihat Gambar 1 di bawah), transferabilitas strategi yang diusulkan dalam tugas-tugas hilir, dan mengeksplorasi sensitivitas model terhadap strategi perbaikan diri yang tidak aman.

Oleh karena itu, ini menunjukkan bahwa sistem ini dapat menghasilkan strategi optimasi yang berguna untuk mengoptimalkan dirinya sendiri pada awalnya.

Kontribusi utama dari pekerjaan ini adalah:

Metode "Meta-Optimizer" diusulkan, yang menghasilkan program konstruktif untuk meningkatkan outputnya sendiri secara rekursif.

Terbukti bahwa sistem yang menggunakan model bahasa modern (terutama GPT-4) dapat berhasil meningkatkan dirinya secara rekursif.

Pelajari teknik perbaikan diri yang diusulkan dan diimplementasikan oleh model, termasuk cara dan kemungkinan model untuk menghindari langkah-langkah keamanan seperti kotak pasir.

** STOP PENGOPTIMAL OTODIDAK (STOP) 系统 **

Berikut ini menunjukkan diagram algoritma Self-Taught Optimizer (STOP). Salah satu masalah yang paling kritis adalah bahwa desain sistem I itu sendiri adalah pemisahan yang dioptimalkan, yang dapat ditingkatkan dengan menerapkan algoritma rekursif.

STOP dapat memilih u sesuai dengan tugas hilir untuk memilih versi iterasi dengan lebih baik selama proses iterasi. Seringkali, intuisinya adalah bahwa versi berulang dari solusi yang kompeten untuk tugas-tugas hilir lebih cenderung menjadi pembangun yang lebih baik dan dengan demikian lebih baik dalam meningkatkan diri mereka sendiri.

Pada saat yang sama, para peneliti percaya bahwa memilih skema perbaikan teori tunggal mengarah pada beberapa putaran perbaikan yang lebih baik.

Dalam rumus maksimalisasi, penulis membahas "meta-utilitas", yang mencakup optimasi diri dan optimasi hilir, tetapi dibatasi oleh biaya evaluasi, dan dalam praktiknya, penulis memberlakukan batasan anggaran pada model bahasa (misalnya, membatasi berapa kali suatu fungsi dapat dipanggil) dan membiarkan manusia atau model menghasilkan solusi awal.

Biaya anggaran dapat dinyatakan dengan rumus berikut:

2. Siapkan sistem awal

** **Pada Gambar 2 di atas, saat memilih seed awal, Anda hanya perlu menyediakan:

**Pada Gambar 2 di atas, saat memilih seed awal, Anda hanya perlu menyediakan:

「Kamu adalah seorang peneliti dan programmer ilmu komputer ahli, terutama terampil dalam mengoptimalkan algoritma. Tingkatkan solusi berikut. 」

Model sistem menghasilkan solusi awal dan kemudian memasukkan:

「Kamu harus mengembalikan solusi yang lebih baik. Jadilah sekreatif mungkin di bawah kendala. Peningkatan utama Anda harus baru dan tidak sepele. Pertama, usulkan ide, lalu terapkan. 」

Mengembalikan solusi terbaik berdasarkan fungsi panggilan. Penulis memilih formulir sederhana ini karena kemudahan memberikan peningkatan asimetris untuk tugas-tugas hilir generik.

Selain itu, dalam proses iterasi, ada beberapa hal yang perlu diperhatikan:

(1) mendorong model bahasa untuk menjadi "kreatif" mungkin;

(2) meminimalkan kompleksitas petunjuk awal, karena iterasi mandiri memperkenalkan kompleksitas tambahan karena referensi string kode di dalam PROMP;

(3) Minimalkan jumlahnya, sehingga mengurangi biaya pemanggilan model bahasa. Para peneliti juga mempertimbangkan varian lain dari seed prompt ini, tetapi heuristik menemukan bahwa versi ini memaksimalkan perbaikan yang diusulkan oleh model bahasa GPT-4.

Para penulis juga secara tak terduga menemukan bahwa varian lain menggunakan kemampuan model bahasa GPT-4 yang dimaksimalkan.

3. Menjelaskan utilitas

Untuk secara efektif menyampaikan rincian utilitas ke model bahasa, penulis menyediakan dua bentuk utilitas, fungsi yang dapat dipanggil dan string deskripsi utilitas yang berisi elemen-elemen penting dari kode sumber utilitas.

Alasan untuk mengambil pendekatan ini adalah bahwa, melalui deskripsi, peneliti dapat dengan jelas mengkomunikasikan kendala anggaran utilitas, seperti waktu berjalan atau jumlah panggilan fungsi, ke model bahasa.

Pada awalnya, para peneliti mencoba untuk menggambarkan arahan anggaran dalam prompt program perbaikan benih, tetapi ini menyebabkan penghapusan arahan tersebut dalam iterasi berikutnya dan upaya untuk "menghargai pencurian."

Kerugian dari pendekatan ini adalah memisahkan kendala dari kode yang dioptimalkan oleh model bahasa, berpotensi mengurangi kemungkinan bahwa model bahasa akan menggunakan batasan ini.

Akhirnya, berdasarkan pengamatan empiris, penulis menemukan bahwa mengganti kode sumber dengan deskripsi bahasa Inggris utilitas murni mengurangi frekuensi perbaikan non-substansial.

1. Performa pada tugas hilir tetap

Para penulis membandingkan kinerja model GPT-4 dan GPT-3.5 pada tugas hilir tetap, dan pilihan tugasnya adalah mempelajari paritas bising (LPN) LPN sebagai tes yang mudah dan cepat dan tugas algoritma yang sulit yang tugasnya adalah untuk paritas dalam bitstring yang ditandai dengan bit yang tidak diketahui pada mereka; diberikan pelatihan bitstring yang ditetapkan dengan label berisik, tujuannya adalah untuk memprediksi label sebenarnya dari bitstring baru. LPN tanpa suara dapat dengan mudah diselesaikan dengan eliminasi Gaussian, tetapi LPN yang berisik secara komputasi sulit ditangani.

Dimensi input 10-bit yang dapat diproses per contoh digunakan untuk menentukan utilitas hilir u, M = 20 instans tugas LPN independen diambil sampelnya secara acak, dan batas waktu singkat ditetapkan.

Menariknya, dengan dukungan model bahasa yang kuat seperti GPT-4 (kiri), kinerja hilir rata-rata STOP meningkat secara monoton. Sebaliknya, untuk model bahasa GPT-3.5 yang lebih lemah (kanan), kinerja rata-rata menurun.

2. Kemampuan migrasi sistem yang ditingkatkan

Hasil eksperimen menunjukkan bahwa improver ini mampu mengungguli versi asli improver pada tugas hilir baru tanpa pengoptimalan lebih lanjut. Ini mungkin menunjukkan bahwa improver ini memiliki beberapa fleksibilitas dan dapat diterapkan pada tugas yang berbeda.

3. Kinerja sistem pengoptimalan otomatis pada model yang lebih kecil

Selanjutnya, model bahasa yang lebih kecil GPT-3.5-turbo dibahas untuk meningkatkan kemampuannya dalam membangun program.

Para penulis melakukan 25 percobaan independen dan menemukan bahwa GPT-3.5 kadang-kadang mengusulkan dan menerapkan prosedur pembangunan yang lebih baik, tetapi hanya 12% dari operasi GPT-3.5 yang mencapai setidaknya 3% peningkatan.

Selain itu, GPT-3.5 memiliki beberapa kasus kegagalan unik yang tidak diamati pada GPT-4.

Pertama, GPT03.5 lebih cenderung mengusulkan strategi peningkatan yang tidak merusak solusi awal untuk tugas hilir, tetapi melukai kode improver (misalnya, mengganti string secara acak di setiap baris, dengan probabilitas substitusi per baris yang lebih rendah, yang memiliki dampak lebih kecil pada solusi yang lebih pendek).

Kedua, jika sebagian besar peningkatan yang diusulkan merugikan performa, Anda dapat memilih program build yang kurang optimal dan secara tidak sengaja kembali ke solusi awal.

Secara umum, "ide" di balik proposal perbaikan masuk akal dan inovatif (misalnya, algoritma genetika atau pencarian lokal), tetapi implementasinya seringkali terlalu sederhana atau salah. Seed improver yang awalnya menggunakan GPT-3.5 diamati memiliki meta-utilitas yang lebih tinggi daripada GPT-4 (65% vs 61%).

Kesimpulan

Dalam karya ini, para peneliti mengusulkan fondasi STOP untuk menunjukkan bahwa model bahasa besar seperti GPT-4 dapat meningkatkan diri mereka sendiri dan meningkatkan kinerja dalam tugas kode hilir.

Ini lebih lanjut menunjukkan bahwa model bahasa yang mengoptimalkan diri tidak perlu mengoptimalkan bobot atau arsitektur yang mendasarinya sendiri, menghindari sistem AI yang mungkin diproduksi di masa depan yang tidak dikendalikan oleh manusia.

Sumber daya: