出典:新志源> Wayve が発売した LINGO-1 で自動運転を一口体験!この車の運転方法は、それ自体が説明する大きな言語モデルであり、もはやブラックボックスではありません。自動運転が発明されて以来、自動運転に関して最も懸念されているのは、自動運転の頭の中で何が起こっているのか人間には分からないことだ。今日から、本当に自分の考えを「口に出す」ことができるようになる?最近、Wayve は、大規模言語モデルと自動運転を深く統合する、視覚言語アクション大規模モデル (VLAM) に基づく大規模自動運転インタラクション モデル LINGO-1 を発表しました。 具体的には、LINGO-1 はビデオ言語モデルをトレーニングしました。これは非常にパーソナライズされたものであると言えます。目の前で起こっているシーンについてコメントすることができます。> - 何をしているのですか?・現在、道路状況が複雑なため、慎重に通行しています。> - 次に何をするつもりですか? - 左に曲がります。> - 現在のシナリオにおける潜在的なリスクは何ですか? - 信号機、自転車、道路を横断する歩行者インテリジェント運転システムに関する疑問をすべてわかりやすく説明します。 Q:なぜ止まったのですか?答え: 今は赤信号だからです。さまざまな視覚データおよび言語データでトレーニングされた後、LINGO-1 は、知覚、反事実、計画、推論、注意などの視覚的質問応答 (VQA) タスクを実行できるだけでなく、運転行動や推論を記述することもできます。つまり、LINGO-1に質問することで、運転の意思決定に影響を与える要因を理解することができるのです。 ネットユーザーは「このようにしてエンドツーエンドのブラックボックスが開かれた。GPT時代にはまさに奇跡だ。自動運転システムは現実の物理世界との相互作用から大きな一歩を踏み出した」と嘆いた。身体化された人工知能の限界を押し広げるにつれて、言語は自動運転モデルの解釈とトレーニングの方法を強化するための新しいパラダイムを提供するため、視覚・音声・行動モデルが大きな影響を与えると考えられます。## **自動運転車に褒め言葉はつきものですか? **LINGO-1 のユニークな特徴は、運転シーンの口頭解説データをトレーニングするための人間の専門家の導入であり、これによりモデルが環境認識、行動の意思決定、人間らしいシーンの解釈を結び付けることが可能になります。 このようにして、自然言語対話を通じて自動運転システムの決定と動作を解釈できます。NVIDIA のシニア AI サイエンティストである Jim Fan 氏は、興奮気味に次のようにコメントしました。「これは、私が最近読んだ自動運転の分野で最も興味深い著作です。」 これまでの自動運転は「知覚→運転操作」でしたが、今後の自動運転には「知覚→言語的推論→行動」という推論のステップが加わります。この新しい明示的推論ステップの利点は何ですか?ジム・ファン氏は次のように説明する——> - 解釈可能性: 駆動モデルはもはや謎のブラック ボックスではありません。> - 反事実的なシナリオ: トレーニング データにないシナリオを想像し、それらを正しく処理する方法を推論することができます。> - ロングテール プログラミング: 運転には多数のエッジ シナリオがあり、すべてのシナリオに適切なデータ カバレッジを提供することは不可能です。人間の専門家は、症例を「ニューロプログラム」するために何千もの例を収集するのではなく、少数の例を説明するプロンプト () を作成して、特定のまたは複雑なシナリオを処理する方法についてシステムをガイドできます。それだけでなく、LINGO-1 は、どちらも AI エージェントである MineDojo や Thought Cloning など、ゲーム人工知能の分野の一部の研究とも密接に関連しています。前者は、レビュー テキストと Minecraft ビデオ ピクセルを関連付ける報酬モデルを学習できます。後者は、「ピクセル→言語→アクションループ」の完全なリンクを実現できます。## **LINGO-1——オープンループ運転ナレーター**### **私自身の説明**モデルが注目している点は何ですか?何やっていますか?さて、これはもはや謎ではありません。LINGO-1 は、各段階で何を行うのかを明確に説明します。 たとえば、道路脇に駐車している車両を追い越したい場合、> LINGO-1: 交通量が少ないため追い越しをしています。> LINGO-1: 駐車中の車の前を通り過ぎます。> LINGO-1: 前方の道が空いているので加速しています。 横断歩道に近づくと——> LINGO-1: 速度を維持しています。道はまだ空いています。 LINGO-1: ブレーキをかけ、速度を落とします。 LINGO-1: 横断歩道で止まります。 LINGO-1: 停止したところから加速しています。リンゴ-1: 道路が空いているのでスピードを出しています。 交差点を左折するとき——> LINGO-1: 前の車も止まったので、じっとしていました。 LINGO-1: 前の車が遠ざかったので加速しています。リンゴ-1: 交差点で止まるためにブレーキをかけています。リンゴ-1: 車線が空いているので、前に進みます。 LINGO-1: 左折を完了し、ルートに従ってください。 ### **ビジュアル質問応答 (VQA)**LINGO-1 は、それ自体を説明するだけでなく、質問に答えることもできるため、シーンの理解と推論の能力を評価することができます。 たとえば、LINGO-1 に「この交差点では何に注意すべきですか?」と尋ねるとします。「前方の信号、前方の自転車、道路を横断する歩行者に注意しなければなりません」と書かれています。 LINGO-1に聞いてください、今の天気は何ですか?運転にどのような影響が出るのでしょうか?「今日は雨の日ですが、雨の日は路面が滑りやすく視界が悪くなりますので、運転には細心の注意が必要です。」と表示されます。 LINGO-1 さん、自転車と安全に並走するにはどうすればよいですか?「自転車から距離を保ち、必要に応じて停止しなければなりません。潜在的な危険です。また、路肩に駐車している車にも注意しなければなりません。」と書かれています。 ### **キー: 運転解説データセット**LINGO-1 開発の鍵は、スケーラブルで多様なデータセットを作成することでした。このデータセットには、画像、言語、行動データなど、英国全土を運転中のプロのドライバーによるコメントが含まれています。これは、私たちが自動車学校の教官から運転を習っているときの光景を思い出させます。教官は、なぜ運転中にそのような行動をとるのかについて、時折、次のようなコメントや説明をして、生徒が推測できるようにしていました。 。> - 前方の車両/信号が変わりました。速度を落としてください - 車線を変更する時間です - 速度を上げても構いません。最高速度制限を超えないように注意してください - 注意!他の車両が道路に進入している/交差点で停止している - ロータリーに注意し、前方の標識に道を譲ってください - 前方に駐車車両/信号機/学校があります - 隣の車両が車線変更中/駐車車両を追い越しています - 自転車/歩行者が交差点で待機しています横断歩道上記の文章、感覚画像、および基礎となる運転動作が時間内で同期されると、研究者は、さまざまなタスクのモデルをトレーニングするために使用できる豊富な視覚言語動作データセットを取得できます。### **ビジュアル言語アクション モデル (VLAM)**LLM の台頭後、多くのビジュアル言語モデル (VLM) は、LLM の推論機能と画像やビデオを組み合わせています。Wayve はさらに、画像、運転データ、言語の 3 種類の情報を含む視覚-言語-アクション モデル (VLAM) を開始しました。これまで、自然言語はロボットのトレーニング (特に自動運転の分野) で使用されることはほとんどありませんでした。自然言語が追加されれば、基本的な運転モデルをより強力に解釈して訓練できるようになり、この新しいモデルは大きな影響を与えるでしょう。言語を使用して運転シナリオのさまざまな原因を説明することで、モデルのトレーニング速度を加速し、新しいシナリオに拡張することができます。また、モデルに質問できるため、モデルが何を理解しているのか、モデルがどの程度推論して意思決定できるのかを知ることができます。自動運転システムはもはや神秘的なブラックボックスではなく、運転中に時々「何を考えているの?」と尋ねることができます。これにより自動運転に対する国民の信頼が高まることは間違いありません。さらに、トレーニング サンプルの数はわずかですが、自然言語の迅速な学習能力により、モデルは新しいタスクを迅速かつ効率的に学習し、新しいシナリオに適応できます。たとえば、自然言語を使用してモデルに「この動作は間違っています」と伝える限り、自動運転システムの誤った動作を修正できます。今後、エンドツーエンドの自動運転の基本モデルを確立するには、おそらく自然言語のみが必要となるでしょう。### **精度 60%**この間、チームはモデル アーキテクチャとトレーニング データ セットを改善してきました。この図から、LINGO-1 のパフォーマンスが当初に比べて 2 倍になっていることがわかります。現在、LINGO-1の精度は人間レベルの60%に達しています。 自然言語の導入は、多くの面で自動運転技術に革命をもたらす可能性があることは明らかです。### **エンドツーエンドモデルの解釈可能性を向上させる**機械学習モデルの解釈可能性の欠如は常に研究の焦点となってきました。自然言語に基づいたインタラクティブなインターフェイスを作成することで、ユーザーは直接質問し、AI に回答させることができ、それによってモデルによるシーンの理解と意思決定方法を深く理解することができます。乗客と自動運転車の間のこのユニークな対話により、透明性が高まり、これらのシステムの理解と信頼が容易になります。同時に、自然言語は、人間のフィードバックに適応し、そこから学習するモデルの能力も強化します。インストラクターがハンドルを握って生徒を指導するのと同じように、修正指示とユーザーのフィードバックにより、時間の経過とともにモデルの理解と意思決定のプロセスが改善されます。### **計画と推論の改善、運転パフォーマンスの向上**自動運転のパフォーマンスに影響を与える主な要因は 2 つあります。1. さまざまな入力モードのシナリオを正確に解釈する言語モデルの機能2. 中レベルの推論を効果的な低レベルの計画に変換するモデルの熟練度この点で、チームは LINGO の自然言語、推論、計画機能を通じて閉ループ運転モデルを強化しようとしています。 Wayve LINGO-1 クローズドループ自動運転モデル### **新しいシナリオまたはロングテール シナリオの効率的な学習**通常、百聞は一見に如かずです。しかし、モデルをトレーニングする場合、1 つのテキストは 1,000 枚の写真に匹敵します。歩行者のために車が速度を落とす何千もの例を用意する代わりに、モデルに速度を落とすように教え、この状況でどのように動作すべきかを学習するために必要なのは、短いテキストの説明とともにいくつかの例だけです。ご存知のとおり、自動運転の最も重要な部分の 1 つは因果推論です。これにより、システムはシーン内の要素と動作の間の関係を理解できるようになります。優れたパフォーマンスの VLAM により、システムは横断歩道で待っている歩行者を「横断禁止」信号機と接続することができます。これは、データが限られている困難なシナリオにおいて非常に意味があります。さらに、LLM はインターネット データ セットから人間の行動に関する大量の知識をすでに持っているため、物体の識別、交通規制、木々の間、店舗、住宅の間、ボールを追いかける犬、車の運転操作などの概念を理解することができます。学校の前に停まっているバス。VLAM によるグラフィックス データの広範な情報エンコーディングを通じて、自動運転はより高度かつ安全になります。## **制限事項**もちろん、LINGO-1 にも一定の制限があります。### **一般化**LINGO-1 は、ロンドン中心部の運転体験とインターネット規模のテキストに基づいてトレーニングされています。私は世界中の運転文化について学びましたが、現在最も得意なのは英国の交通法の解釈です。他国での運転経験から学ぶことも必要です。### **幻覚**幻覚は大規模な言語モデルにおけるよく知られた問題であり、LINGO-1 も例外ではありません。ただし、通常の LLM と比較して、LINGO-1 には利点があります。視覚、言語、行動に基づいているため、より多くの監視源があり、世界をよりよく理解できます。### **コンテクスト**ビデオ データは通常、画像やテキスト データセットよりも桁違いに大きいため、ビデオ ディープ ラーニングは困難です。ビデオベースのマルチモーダル言語モデルでは、複雑な動的な運転シナリオを推論するために多くのビデオ フレームを埋め込むことができるように、長いコンテキスト長が特に必要です。### **閉ループ推論**現在、Wayve はモデルの解釈可能性に取り組んでいますが、最終的には、LLM の推論機能が人間の運転に真の影響を与えることができるようになります。研究者たちは、将来的に自動運転車上で LINGO-1 を実行できる閉ループ アーキテクチャを開発中です。## **ネチズン ディスカッション**ネチズンもこれを非常に刺激的だと感じました。「興味深いことに、自然言語では必要な精度が失われるため、言語モデルは運転そのものに影響を与えるのではなく、運転制御モデルのステアリング、ブレーキ、スロットルの予測を言葉で解釈すると思います。」 「このアプローチにより、私たちはAGIに非常に近づいています。」「これは世界モデルに言語を追加するものと考えることができます。なぜこれまで試行されなかったのか理解できません。エージェントを訓練してコミュニケーションを図るというアイデアは誰もが思いつきそうなものだからです。」 「純粋な知覚によるアクションからテキストによる推論の追加への移行は、状況を大きく変えるものです。私の意見では、これは自動運転に欠けている部分です。なぜなら、非技術的な方法で解釈可能になるからです。」 現時点では、ロボット トレーニングと自然言語の統合はまだ初期段階にあります。LINGO-1 は、自然言語を使用して基本的な運転モデルの学習と解釈可能性を強化するという重要な一歩を正式に踏み出しました。想像してみてください。将来、単純なテキスト プロンプトを使用するだけで、AI に前方の道路状況を教えてもらったり、AI にさまざまな地域の交通規制を学習させたりできるようになります。このシーンはとてもエキサイティングです。したがって、自然言語は、より安全で信頼性の高い自動運転車の開発において大きな可能性を秘めています。参考文献:

大型モデルは実際に自動運転を搭載しており、AIがどのように運転するのかを解説します!

出典:新志源

自動運転が発明されて以来、自動運転に関して最も懸念されているのは、自動運転の頭の中で何が起こっているのか人間には分からないことだ。

今日から、本当に自分の考えを「口に出す」ことができるようになる?

最近、Wayve は、大規模言語モデルと自動運転を深く統合する、視覚言語アクション大規模モデル (VLAM) に基づく大規模自動運転インタラクション モデル LINGO-1 を発表しました。

インテリジェント運転システムに関する疑問をすべてわかりやすく説明します。

さまざまな視覚データおよび言語データでトレーニングされた後、LINGO-1 は、知覚、反事実、計画、推論、注意などの視覚的質問応答 (VQA) タスクを実行できるだけでなく、運転行動や推論を記述することもできます。

つまり、LINGO-1に質問することで、運転の意思決定に影響を与える要因を理解することができるのです。

身体化された人工知能の限界を押し広げるにつれて、言語は自動運転モデルの解釈とトレーニングの方法を強化するための新しいパラダイムを提供するため、視覚・音声・行動モデルが大きな影響を与えると考えられます。

**自動運転車に褒め言葉はつきものですか? **

LINGO-1 のユニークな特徴は、運転シーンの口頭解説データをトレーニングするための人間の専門家の導入であり、これによりモデルが環境認識、行動の意思決定、人間らしいシーンの解釈を結び付けることが可能になります。

NVIDIA のシニア AI サイエンティストである Jim Fan 氏は、興奮気味に次のようにコメントしました。「これは、私が最近読んだ自動運転の分野で最も興味深い著作です。」

この新しい明示的推論ステップの利点は何ですか?ジム・ファン氏は次のように説明する——

それだけでなく、LINGO-1 は、どちらも AI エージェントである MineDojo や Thought Cloning など、ゲーム人工知能の分野の一部の研究とも密接に関連しています。

前者は、レビュー テキストと Minecraft ビデオ ピクセルを関連付ける報酬モデルを学習できます。後者は、「ピクセル→言語→アクションループ」の完全なリンクを実現できます。

LINGO-1——オープンループ運転ナレーター

私自身の説明

モデルが注目している点は何ですか?何やっていますか?さて、これはもはや謎ではありません。

LINGO-1 は、各段階で何を行うのかを明確に説明します。

LINGO-1 は、それ自体を説明するだけでなく、質問に答えることもできるため、シーンの理解と推論の能力を評価することができます。

「前方の信号、前方の自転車、道路を横断する歩行者に注意しなければなりません」と書かれています。

「今日は雨の日ですが、雨の日は路面が滑りやすく視界が悪くなりますので、運転には細心の注意が必要です。」と表示されます。

「自転車から距離を保ち、必要に応じて停止しなければなりません。潜在的な危険です。また、路肩に駐車している車にも注意しなければなりません。」と書かれています。

LINGO-1 開発の鍵は、スケーラブルで多様なデータセットを作成することでした。このデータセットには、画像、言語、行動データなど、英国全土を運転中のプロのドライバーによるコメントが含まれています。

これは、私たちが自動車学校の教官から運転を習っているときの光景を思い出させます。教官は、なぜ運転中にそのような行動をとるのかについて、時折、次のようなコメントや説明をして、生徒が推測できるようにしていました。 。

上記の文章、感覚画像、および基礎となる運転動作が時間内で同期されると、研究者は、さまざまなタスクのモデルをトレーニングするために使用できる豊富な視覚言語動作データセットを取得できます。

ビジュアル言語アクション モデル (VLAM)

LLM の台頭後、多くのビジュアル言語モデル (VLM) は、LLM の推論機能と画像やビデオを組み合わせています。

Wayve はさらに、画像、運転データ、言語の 3 種類の情報を含む視覚-言語-アクション モデル (VLAM) を開始しました。

これまで、自然言語はロボットのトレーニング (特に自動運転の分野) で使用されることはほとんどありませんでした。

自然言語が追加されれば、基本的な運転モデルをより強力に解釈して訓練できるようになり、この新しいモデルは大きな影響を与えるでしょう。

言語を使用して運転シナリオのさまざまな原因を説明することで、モデルのトレーニング速度を加速し、新しいシナリオに拡張することができます。

また、モデルに質問できるため、モデルが何を理解しているのか、モデルがどの程度推論して意思決定できるのかを知ることができます。

自動運転システムはもはや神秘的なブラックボックスではなく、運転中に時々「何を考えているの?」と尋ねることができます。

これにより自動運転に対する国民の信頼が高まることは間違いありません。

さらに、トレーニング サンプルの数はわずかですが、自然言語の迅速な学習能力により、モデルは新しいタスクを迅速かつ効率的に学習し、新しいシナリオに適応できます。

たとえば、自然言語を使用してモデルに「この動作は間違っています」と伝える限り、自動運転システムの誤った動作を修正できます。

今後、エンドツーエンドの自動運転の基本モデルを確立するには、おそらく自然言語のみが必要となるでしょう。

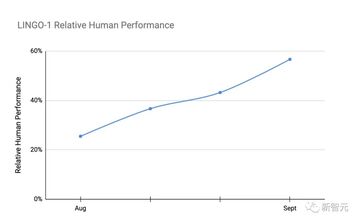

精度 60%

この間、チームはモデル アーキテクチャとトレーニング データ セットを改善してきました。

この図から、LINGO-1 のパフォーマンスが当初に比べて 2 倍になっていることがわかります。

現在、LINGO-1の精度は人間レベルの60%に達しています。

エンドツーエンドモデルの解釈可能性を向上させる

機械学習モデルの解釈可能性の欠如は常に研究の焦点となってきました。

自然言語に基づいたインタラクティブなインターフェイスを作成することで、ユーザーは直接質問し、AI に回答させることができ、それによってモデルによるシーンの理解と意思決定方法を深く理解することができます。

乗客と自動運転車の間のこのユニークな対話により、透明性が高まり、これらのシステムの理解と信頼が容易になります。

同時に、自然言語は、人間のフィードバックに適応し、そこから学習するモデルの能力も強化します。

インストラクターがハンドルを握って生徒を指導するのと同じように、修正指示とユーザーのフィードバックにより、時間の経過とともにモデルの理解と意思決定のプロセスが改善されます。

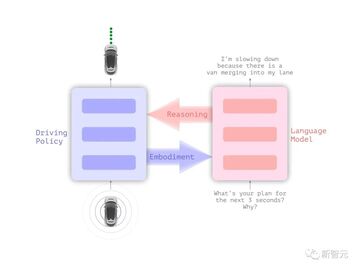

計画と推論の改善、運転パフォーマンスの向上

自動運転のパフォーマンスに影響を与える主な要因は 2 つあります。

さまざまな入力モードのシナリオを正確に解釈する言語モデルの機能

中レベルの推論を効果的な低レベルの計画に変換するモデルの熟練度

この点で、チームは LINGO の自然言語、推論、計画機能を通じて閉ループ運転モデルを強化しようとしています。

新しいシナリオまたはロングテール シナリオの効率的な学習

通常、百聞は一見に如かずです。

しかし、モデルをトレーニングする場合、1 つのテキストは 1,000 枚の写真に匹敵します。

歩行者のために車が速度を落とす何千もの例を用意する代わりに、モデルに速度を落とすように教え、この状況でどのように動作すべきかを学習するために必要なのは、短いテキストの説明とともにいくつかの例だけです。

ご存知のとおり、自動運転の最も重要な部分の 1 つは因果推論です。これにより、システムはシーン内の要素と動作の間の関係を理解できるようになります。

優れたパフォーマンスの VLAM により、システムは横断歩道で待っている歩行者を「横断禁止」信号機と接続することができます。これは、データが限られている困難なシナリオにおいて非常に意味があります。

さらに、LLM はインターネット データ セットから人間の行動に関する大量の知識をすでに持っているため、物体の識別、交通規制、木々の間、店舗、住宅の間、ボールを追いかける犬、車の運転操作などの概念を理解することができます。学校の前に停まっているバス。

VLAM によるグラフィックス データの広範な情報エンコーディングを通じて、自動運転はより高度かつ安全になります。

制限事項

もちろん、LINGO-1 にも一定の制限があります。

一般化

LINGO-1 は、ロンドン中心部の運転体験とインターネット規模のテキストに基づいてトレーニングされています。

私は世界中の運転文化について学びましたが、現在最も得意なのは英国の交通法の解釈です。

他国での運転経験から学ぶことも必要です。

幻覚

幻覚は大規模な言語モデルにおけるよく知られた問題であり、LINGO-1 も例外ではありません。

ただし、通常の LLM と比較して、LINGO-1 には利点があります。視覚、言語、行動に基づいているため、より多くの監視源があり、世界をよりよく理解できます。

### コンテクスト

ビデオ データは通常、画像やテキスト データセットよりも桁違いに大きいため、ビデオ ディープ ラーニングは困難です。

ビデオベースのマルチモーダル言語モデルでは、複雑な動的な運転シナリオを推論するために多くのビデオ フレームを埋め込むことができるように、長いコンテキスト長が特に必要です。

閉ループ推論

現在、Wayve はモデルの解釈可能性に取り組んでいますが、最終的には、LLM の推論機能が人間の運転に真の影響を与えることができるようになります。

研究者たちは、将来的に自動運転車上で LINGO-1 を実行できる閉ループ アーキテクチャを開発中です。

ネチズン ディスカッション

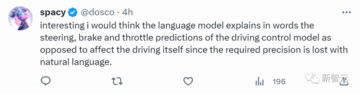

ネチズンもこれを非常に刺激的だと感じました。

「興味深いことに、自然言語では必要な精度が失われるため、言語モデルは運転そのものに影響を与えるのではなく、運転制御モデルのステアリング、ブレーキ、スロットルの予測を言葉で解釈すると思います。」

「これは世界モデルに言語を追加するものと考えることができます。なぜこれまで試行されなかったのか理解できません。エージェントを訓練してコミュニケーションを図るというアイデアは誰もが思いつきそうなものだからです。」

LINGO-1 は、自然言語を使用して基本的な運転モデルの学習と解釈可能性を強化するという重要な一歩を正式に踏み出しました。

想像してみてください。将来、単純なテキスト プロンプトを使用するだけで、AI に前方の道路状況を教えてもらったり、AI にさまざまな地域の交通規制を学習させたりできるようになります。このシーンはとてもエキサイティングです。

したがって、自然言語は、より安全で信頼性の高い自動運転車の開発において大きな可能性を秘めています。

参考文献: