元のソース: 量子ビット 画像ソース: Unbounded AI によって生成伝説的なプログラマー、ジョン カーマックは、強化学習の父であるリチャード サットンと協力して、All in AGI を作成しました。> **2030** 一般人工知能の目標が実現可能であることを社会に実証する。また、主流の方法とは異なり、大規模なモデルのパラダイムに依存せず、リアルタイムのオンライン学習を追求します。 両氏は、サットン氏が教鞭を執るアルバータ大学のマシンインテリジェンス研究所(Amii)の特別イベントで発表した。サットン氏はアルバータ州での教職を維持しながら、カーマック氏のAIスタートアップ、キーン・テクノロジーズに入社する。両氏はイベントで、数百人、数千人の従業員を抱える大企業に比べ、キーン・テクノロジーズのチームは小規模であることを認めた。まだ初期段階にあり、会社の技術チーム全員が現場にいます—**立っているのはこの 4 人だけです**。 資金調達規模は2000万ドルで、数十億ドルを調達することも多いOpenAIやAnthropicとは比べものにならない。しかし彼らは、AGI の最終的なソース コードは 1 人で書ける程度のものになり、行数は数万行にとどまると考えています。さらに、AI分野は現在、レバレッジ効果が最も高まる特別な時期にあり、小規模チームにも大きな貢献をするチャンスがあります。## **伝説的なプログラマーであり強化学習の父**世界初の 3D ゲームの開発から、ロケット製造への移行、Oculus への入社、その後の Meta VR の中心人物になるまで、カーマック氏の伝説的な経験はよく知られています。その後AIに関わるようになり、OpenAIとも関わりました。彼はかつて別のインタビューで、**サム・アルトマンから OpenAI** への参加に誘われ、自分がシステム最適化において重要な役割を果たすことができると信じていたと明かしました。しかし、カーマック氏は当時、機械学習パラダイムにおける現代の AI についてまったく理解していなかったので、同意しませんでした。これが彼にとってAIを理解するきっかけとなった。 彼は、OpenAI の主任科学者である Ilya Sutskever に、入門用の必読書リストを求め、ゼロから独学で学習を開始し、まず従来の機械学習アルゴリズムの基本的な理解を獲得しました。自由時間が少しあり、引き続きディープ ラーニングに参加する予定だったとき、**1 週間のプログラミング チャレンジ**を思いつきました。LeCun の古典的な論文をいくつか印刷し、ネットワークが切断されたときにバックプロパゲーションの公式から始めて練習してください。1 週間が経過した後、彼は Python の最新の深層学習フレームワークの助けを借りずに、C++ で手作りした畳み込みニューラル ネットワークを使用してリトリートを終了しました。私が言えるのは、偉大なマスターを尊敬しているということだけです。 この時点では、彼の主な業務はまだ Facebook の子会社である Oculus (後に Meta に改名) で VR の研究を行っており、チームを率いて Ouclus Go や Quest などの製品を発売しました。しかし、その過程で徐々に経営陣との間に軋轢や意見の相違が生じ、社内の効率性が低いと考え、不満も公に表明した。 2019年にOculusのCTOを辞任して「アドバイザリーCTO」となり、AIへのエネルギーシフトを開始した。2022年8月には新興AIスタートアップのキーン・テクノロジーズが2,000万ドルの資金調達を発表、投資家にはセコイア・キャピタルや元GitHub CEOのナット・フリードマンなどが名を連ねると発表した。その後、彼は実際にはわずか 2,000 万ドルでお金を稼ぐことができることも明らかにしました。しかし、他人からお金を受け取ることは、彼に危機感と切迫感を与え、物事をやり遂げるというより強い決意を与える可能性があります。 2022 年末に彼は正式に Meta を去り、VR は人生の終わったステージとみなし、その後完全に AI に転向しました。 この明らかな本筋に加えて、カーマックと AI には不可解な運命もあります。当時の彼の 3D ゲームはグラフィックス コンピューティングの需要を刺激し、ゲーム分野での GPU の開発と拡大が始まりました。現在、AI の爆発的な発展を支えているのは GPU の計算能力であり、彼は今でもこれについて語るときに自分の貢献を誇りに思っています。……今日のもう一人の主人公**サットン**も伝説です。彼は強化学習の父として知られ、強化時間差学習やポリシー勾配などの手法に重要な貢献をしており、強化学習に関する標準教科書の共著者でもあります。2017 年に、彼は優秀な科学者として DeepMind に入社し、AlphaGo シリーズの研究に参加し、彼の教え子である David Silver は AlphaGo の主要リーダーの 1 人です。 サットン氏は有名な短い記事 **The Bitter Lesson** を書き、人間の経験を AI に教えようとしてもうまくいかないと主張しました。これまでのすべての進歩は、コンピューティング能力の向上に依存していました。スケールを活用し続けるのは正しいことです。コンピューティング能力の効果、その方法。両者が正式にやりとりする前に、カーマック氏はこの記事に対する懸念と賛同を表明していた。 しかし、二人の間の本当の直接のコミュニケーションはサットンによってなされた。数か月前、カーマック氏がAGI Venturesへの資金提供を発表した後、サットン氏からメールを受け取った。サットンは、彼の研究の道が純粋に学術的なものなのか、商業的なものなのか、それとも非営利的なものなのかを尋ねたいと考えていました。しかし、その後のメールのやりとりの中で、両者はAI研究の方向性やコンセプトに驚くほど一致していることがわかり、徐々に協力関係を築いていきました。具体的には、2 者は次の **4 つの合意**に達しました。* 彼らは皆、AGI の現在の開発は少数の非常に狭い方向に限定されており、ビッグデータと大きな計算能力に依存しすぎてイノベーションを無視していると信じています。* 早すぎる商業化は AGI の発展を妨げると誰もが信じています* 彼らは皆、最終的な AGI はそれほど複雑ではなく、1 人ですべての原理を習得でき、メイン コードも 1 人で書くことができると信じています。* 2030 年の AGI プロトタイプの出現は実現可能な目標であると誰もが信じています。## **大規模なモデルに依存するだけでなく、小規模なチームにもチャンスがあります**非常に大胆なゴールであり、観客もそう思った。「小規模なチームがこのような野心的な目標を達成するにはどうすればよいでしょうか?」という疑問に直面したカーマック氏は、AGI を達成するために必要なデータとコンピューティング能力の量は想像されているほど大きくないかもしれないと考えました。> 人間が 1 年間目で見たものを 30 フレーム/秒のビデオにキャプチャし、親指サイズの USB フラッシュ ドライブにインストールできます。> 1 歳児は経験データが限られており、すでに明らかな知性を示しています。> アルゴリズムが正しければ、AGI の学習にインターネットのデータ全体を使用する必要はありません。計算能力の需要についても、人間の脳の計算能力には限界があり、大規模な計算能力クラスターのレベルに達するのは程遠い、と彼はこの種の直観的思考を用いて考察している。> サーバノード(ノード)よりも大きく、キャビネット(ラック)よりも大きくなりますが、最大でも一桁大きいだけです。そして時間が経つにつれて、アルゴリズムはより効率的になり、必要な計算能力は減少し続けます。 3D ゲーム、ロケット、VR という、一見無関係に見えるこれらの仕事分野における Carmack の仕事に共通点があるとすれば、それは大規模なリアルタイム フィードバック システムの最適化であるということです。これは、サム アルトマンが OpenAI への参加を誘ったときに求めていたものです。彼が思い描いた AGI アーキテクチャは、巨大な集中型モデルではなく、**モジュール式で分散型**である必要があります。また、学習は、ほとんどのパラメーターが更新されなくなっている現在の事前トレーニングではなく、**継続的なオンライン学習**である必要があります。> 私の結論は、トレーニング中に約 33 ミリ秒ごとに更新される 30hz でシステムを実行できない場合、私はそのシステムを使用しないということです。さらに、独自のCudaコードを記述してネットワーク通信を管理できる低レベルのシステムプログラマーとして、他の人がまったく考慮しないような仕事もできるかもしれないと述べました。既存のディープラーニングフレームワークにさえ限定されず、より効率的なネットワークアーキテクチャとコンピューティング手法を試みます。全体的な目標は、仮想環境で継続的に学習するための内発的動機と継続的学習能力を備えた仮想エージェントをシミュレートすることです。ロボットではありません。ロケット製造の経験から、扱わなければならない物理的な物体は少ないほど良いと彼は考えたからです**。 少し前に AGI に参加したばかりのカーマック氏と比較すると、サットン氏はこの問題に数十年を費やしており、より具体的な研究計画を持っています。今回のイベントでは多くは語られなかったが、主要部分は「Project Alberta」という形でarXivの論文に書かれている。 Project Alberta は、特定のトレーニング セットではなく普遍的なエクスペリエンスを重視し、時間的一貫性を重視し、コンピューティング能力とマルチエージェント インタラクションによってスケール効果を生み出すことができる方法を優先する、統一エージェント フレームワークを提案しています。12段階のロードマップも提案されている。最初の 6 つのステップはモデルフリーの継続学習方法の設計に重点を置き、最後の 6 つのステップでは環境モデルと計画を導入します。 最後のステップは **Intelligence Amplification** (Intelligence Amplification) と呼ばれ、エージェントは学習した知識を使用して、いくつかの一般原則に従って、別のエージェントの行動、知覚、認知を増幅および強化できます。サットン氏は、この種の強化が人工知能の可能性を最大限に発揮するための重要な部分であると考えています。このプロセスでは、AI の進歩を評価するための指標を決定することが非常に重要ですが、非常に難しく、チームはさまざまな開発を模索しています。さらに、カーマック氏は常にオープンソースの支持者ですが、AGIの問題に関しては、ある程度のオープン性を維持するが、アルゴリズムの詳細をすべて公開するつもりはないと述べました**。カーマックは、小規模なチームとして、開拓者精神を維持し、短期的な利益ではなく長期的な発展に焦点を当てる必要があると信じています。商用化は時期尚早には考慮されず、ChatGPT のように一般に公開できる中間形式もありません。2030年に何が達成できるかについて、カーマック氏は**「一般に実証できるAGIがある」**と考えており、サットン氏の発言は**「AIのプロトタイプは生命の兆候(サイン・オブ・ライフ)を示すことができる」**である。## **2030 年が重要なノードになる**2030 年と AGI が同時に登場するのはこれが初めてではありません。トップの AI チームは、2030 年頃が AGI を達成するための鍵となるノードであると満場一致で考えています。たとえば、OpenAI は、総コンピューティング能力の 20% を超知能連携部門の設立に投入するという発表の中で、**超知能はこの 10 年以内に到来する**と信じていると述べています。 投資界隈でも同様の意見があり、孫正義氏もソフトバンク世界企業会議でそのようなPPTを発表したばかりだ。 OpenAI と Keen Technologies を除けば、AGI の開発に取り組んでいる組織は多くありません。OpenAI の最大の競争相手である **Anthropic** は、40 億ドルの資金を調達したばかりですが、同社 CEO のダリオ・アモデイ氏は最近のインタビューで、AI は 2 ~ 3 年以内に十分な教育を受けた人間のように行動できるようになると述べました。 Transformer の著者である Vaswani 氏と Palmer 氏は Google を退職した後、一般的な知能を作成することを目的として **AdeptAI** を設立しました。しかし、2人は今年初めに突然同社を去り、残るは共同創設者のデビッド・ルアン(右端)1人だけとなった。 Transformer の著者 2 人は Essential AI も設立しており、この会社のビジョンは「星を見上げること」ではなく、より実用的な大規模モデルの商品化です。また、AGI の目標を明確に表明している国内プレーヤーは多くありませんが、主なプレーヤーは MiniMax と、Yang Zhilin によって新しく設立された Dark Side of the Moon です。参考リンク:[1][2][3]

強化学習の父が AGI に入社して起業!伝説的なプログラマー Carmack と協力して、大規模なモデルに依存しません

元のソース: 量子ビット

伝説的なプログラマー、ジョン カーマックは、強化学習の父であるリチャード サットンと協力して、All in AGI を作成しました。

また、主流の方法とは異なり、大規模なモデルのパラダイムに依存せず、リアルタイムのオンライン学習を追求します。

サットン氏はアルバータ州での教職を維持しながら、カーマック氏のAIスタートアップ、キーン・テクノロジーズに入社する。

両氏はイベントで、数百人、数千人の従業員を抱える大企業に比べ、キーン・テクノロジーズのチームは小規模であることを認めた。

まだ初期段階にあり、会社の技術チーム全員が現場にいます—

立っているのはこの 4 人だけです。

しかし彼らは、AGI の最終的なソース コードは 1 人で書ける程度のものになり、行数は数万行にとどまると考えています。

さらに、AI分野は現在、レバレッジ効果が最も高まる特別な時期にあり、小規模チームにも大きな貢献をするチャンスがあります。

伝説的なプログラマーであり強化学習の父

世界初の 3D ゲームの開発から、ロケット製造への移行、Oculus への入社、その後の Meta VR の中心人物になるまで、カーマック氏の伝説的な経験はよく知られています。

その後AIに関わるようになり、OpenAIとも関わりました。

彼はかつて別のインタビューで、サム・アルトマンから OpenAI への参加に誘われ、自分がシステム最適化において重要な役割を果たすことができると信じていたと明かしました。

しかし、カーマック氏は当時、機械学習パラダイムにおける現代の AI についてまったく理解していなかったので、同意しませんでした。

これが彼にとってAIを理解するきっかけとなった。

自由時間が少しあり、引き続きディープ ラーニングに参加する予定だったとき、1 週間のプログラミング チャレンジを思いつきました。

LeCun の古典的な論文をいくつか印刷し、ネットワークが切断されたときにバックプロパゲーションの公式から始めて練習してください。

1 週間が経過した後、彼は Python の最新の深層学習フレームワークの助けを借りずに、C++ で手作りした畳み込みニューラル ネットワークを使用してリトリートを終了しました。

私が言えるのは、偉大なマスターを尊敬しているということだけです。

しかし、その過程で徐々に経営陣との間に軋轢や意見の相違が生じ、社内の効率性が低いと考え、不満も公に表明した。

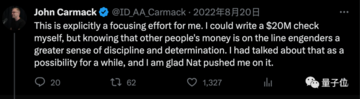

2022年8月には新興AIスタートアップのキーン・テクノロジーズが2,000万ドルの資金調達を発表、投資家にはセコイア・キャピタルや元GitHub CEOのナット・フリードマンなどが名を連ねると発表した。

その後、彼は実際にはわずか 2,000 万ドルでお金を稼ぐことができることも明らかにしました。

しかし、他人からお金を受け取ることは、彼に危機感と切迫感を与え、物事をやり遂げるというより強い決意を与える可能性があります。

当時の彼の 3D ゲームはグラフィックス コンピューティングの需要を刺激し、ゲーム分野での GPU の開発と拡大が始まりました。

現在、AI の爆発的な発展を支えているのは GPU の計算能力であり、彼は今でもこれについて語るときに自分の貢献を誇りに思っています。

……

今日のもう一人の主人公サットンも伝説です。

彼は強化学習の父として知られ、強化時間差学習やポリシー勾配などの手法に重要な貢献をしており、強化学習に関する標準教科書の共著者でもあります。

2017 年に、彼は優秀な科学者として DeepMind に入社し、AlphaGo シリーズの研究に参加し、彼の教え子である David Silver は AlphaGo の主要リーダーの 1 人です。

両者が正式にやりとりする前に、カーマック氏はこの記事に対する懸念と賛同を表明していた。

数か月前、カーマック氏がAGI Venturesへの資金提供を発表した後、サットン氏からメールを受け取った。

サットンは、彼の研究の道が純粋に学術的なものなのか、商業的なものなのか、それとも非営利的なものなのかを尋ねたいと考えていました。

しかし、その後のメールのやりとりの中で、両者はAI研究の方向性やコンセプトに驚くほど一致していることがわかり、徐々に協力関係を築いていきました。

具体的には、2 者は次の 4 つの合意に達しました。

大規模なモデルに依存するだけでなく、小規模なチームにもチャンスがあります

非常に大胆なゴールであり、観客もそう思った。

「小規模なチームがこのような野心的な目標を達成するにはどうすればよいでしょうか?」という疑問に直面したカーマック氏は、AGI を達成するために必要なデータとコンピューティング能力の量は想像されているほど大きくないかもしれないと考えました。

計算能力の需要についても、人間の脳の計算能力には限界があり、大規模な計算能力クラスターのレベルに達するのは程遠い、と彼はこの種の直観的思考を用いて考察している。

そして時間が経つにつれて、アルゴリズムはより効率的になり、必要な計算能力は減少し続けます。

これは、サム アルトマンが OpenAI への参加を誘ったときに求めていたものです。

彼が思い描いた AGI アーキテクチャは、巨大な集中型モデルではなく、モジュール式で分散型である必要があります。

また、学習は、ほとんどのパラメーターが更新されなくなっている現在の事前トレーニングではなく、継続的なオンライン学習である必要があります。

さらに、独自のCudaコードを記述してネットワーク通信を管理できる低レベルのシステムプログラマーとして、他の人がまったく考慮しないような仕事もできるかもしれないと述べました。

既存のディープラーニングフレームワークにさえ限定されず、より効率的なネットワークアーキテクチャとコンピューティング手法を試みます。

全体的な目標は、仮想環境で継続的に学習するための内発的動機と継続的学習能力を備えた仮想エージェントをシミュレートすることです。

ロボットではありません。ロケット製造の経験から、扱わなければならない物理的な物体は少ないほど良いと彼は考えたからです**。

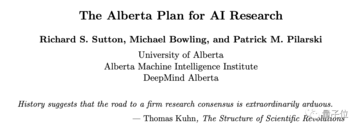

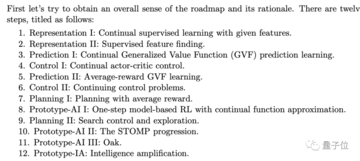

今回のイベントでは多くは語られなかったが、主要部分は「Project Alberta」という形でarXivの論文に書かれている。

12段階のロードマップも提案されている。

最初の 6 つのステップはモデルフリーの継続学習方法の設計に重点を置き、最後の 6 つのステップでは環境モデルと計画を導入します。

サットン氏は、この種の強化が人工知能の可能性を最大限に発揮するための重要な部分であると考えています。

このプロセスでは、AI の進歩を評価するための指標を決定することが非常に重要ですが、非常に難しく、チームはさまざまな開発を模索しています。

さらに、カーマック氏は常にオープンソースの支持者ですが、AGIの問題に関しては、ある程度のオープン性を維持するが、アルゴリズムの詳細をすべて公開するつもりはないと述べました**。

カーマックは、小規模なチームとして、開拓者精神を維持し、短期的な利益ではなく長期的な発展に焦点を当てる必要があると信じています。

商用化は時期尚早には考慮されず、ChatGPT のように一般に公開できる中間形式もありません。

2030年に何が達成できるかについて、カーマック氏は**「一般に実証できるAGIがある」と考えており、サットン氏の発言は「AIのプロトタイプは生命の兆候(サイン・オブ・ライフ)を示すことができる」**である。

2030 年が重要なノードになる

2030 年と AGI が同時に登場するのはこれが初めてではありません。

トップの AI チームは、2030 年頃が AGI を達成するための鍵となるノードであると満場一致で考えています。

たとえば、OpenAI は、総コンピューティング能力の 20% を超知能連携部門の設立に投入するという発表の中で、超知能はこの 10 年以内に到来すると信じていると述べています。

OpenAI の最大の競争相手である Anthropic は、40 億ドルの資金を調達したばかりですが、同社 CEO のダリオ・アモデイ氏は最近のインタビューで、AI は 2 ~ 3 年以内に十分な教育を受けた人間のように行動できるようになると述べました。

しかし、2人は今年初めに突然同社を去り、残るは共同創設者のデビッド・ルアン(右端)1人だけとなった。

また、AGI の目標を明確に表明している国内プレーヤーは多くありませんが、主なプレーヤーは MiniMax と、Yang Zhilin によって新しく設立された Dark Side of the Moon です。

参考リンク: [1] [2] [3]