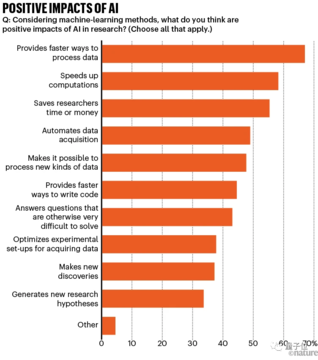

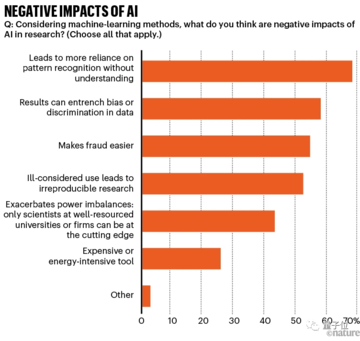

元のソース: 量子ビット 画像ソース:無制限のAIによって生成AI論文は急増し、本当に「必要」だと感じている研究者はわずか**4%**?! この結論は、Natureの最新の調査から得られたものです。より正確には、科学研究でAIツールを使用する研究者の調査結果。これらの個人は、2022年の最後の4か月間に、世界中でさまざまな主題分野から論文を発表した40,000人以上の研究者から選ばれました。また、AIツールを開発する「インサイダー」と、研究にAIツールを使用しない「アウトサイダー」も調査に含まれており、合計で**1600+**となっています。その成果は「AIと科学:1,600人の研究者が考えること」というタイトルで出版されました。 科学研究者はAIツールについて正確にどう思いますか? 先に進みましょう。 ## **1600人の研究者からのAIビュー** この調査では、機械学習と生成型AIに対する研究者の認識に焦点を当てました。調査結果の客観的妥当性を保証するために、前述のように、Natureは、2022年の最後の4か月間に論文を発表した世界中の40,000人以上の科学者に電子メールで連絡を取り、Natureニュースレターの読者に調査への参加を呼びかけました。最終的に、1659人の回答者が選ばれ、具体的なサンプル構成は次のとおりです。 回答者のほとんどは、アジア(28%)、ヨーロッパ(ほぼ1/3)、および北米(20%)から来ています。これらのうち、48%がAIを直接開発または研究し、30%が研究にAIを使用し、22%が研究にAIを使用しませんでした。詳細な結果を見てみましょう。調査によると、研究にAIを使用している人の1/4以上が、AIツールは今後10年以内に自分の分野で「必需品」になると考えています。しかし、AIツールが「必需品」になったと考えているのはわずか4%で、AIが将来「非常に役立つ」と考えているのは47%です。対照的に、AIを使わない研究者はあまり興味がありません。 それでも、9%はこれらのテクノロジーが今後10年以内に「不可欠」になると考えており、別の34%は「非常に役立つ」と述べています。 機械学習の認識に関する調査では、回答者にAIツールのプラスの効果を選択するように求められました。 回答者の3分の2は、AIがデータを処理するためのより高速な方法を提供すると信じており、58%はAIが以前は実現不可能だった計算を加速すると信じており、55%はAIが時間とお金を節約していると述べています。 回答者がAIがもたらす可能性があると考える主な悪影響は、深い理解よりもパターン認識への依存度を高める(69%)、データの偏見や差別を強化する(58%)、詐欺の可能性を高める(55%)、ブラインド使用により研究の再現性が高まる可能性がある(53%)です。 研究者が生成型AIツールについてどう考えているかを見てみましょう。ほとんどの人は、ジェネレーティブAIツールの大きな利点の1つは要約と翻訳であり、英語を母国語としない研究者が論文の文法とスタイルを改善するのに役立つと考えています。 第二に、コードを書く能力も認められています。 しかし、ジェネレーティブAIにもいくつかの問題があります。 研究者は、不正確な情報の流布(68%)、盗作の検出を容易にし、検出するのが難しくなる(68%)、論文/コードにエラーや不正確なコンテンツを導入する(66%)ことを最も懸念しています。 回答者は、医療診断用のAIツールが偏ったデータでトレーニングされている場合、改ざんされた研究、偽情報、および長年の偏見の可能性を懸念していると付け加えました。さらに、頻度統計によると、AIに関心のある研究者でさえ、研究に大規模な言語モデルを使用することがよくあります。 すべての回答者の中で、研究者がAIで行ったことのほとんどは、研究とは関係のない創造的な娯楽でした。 2つ目は、AIツールを使用してコードを記述し、研究アイデアを考案し、論文を書くのを助けることです。 大規模なモデルの出力に満足していない科学者もいます。 大規模なモデルで論文の編集を支援したある研究者は次のように書いています。>、ChatGPTが人類の悪い執筆習慣をすべて再現したように感じます。フィンランドのトゥルク大学の物理学者ヨハネス・ニスカネンは次のように述べています。> AIを使って記事を読み書きすれば、科学は「人間による人間のためのもの」から「機械による機械のためのもの」へと移行します。この調査では、NatureはAIの開発が直面しているジレンマに関する研究者の見解も掘り下げています。 ## **AI開発のジレンマ** 研究者の約半数は、AIの開発または使用に障害を経験していると述べました。AI開発に携わる研究者にとって最大の懸念は、コンピューティングリソースの不足、研究資金の不足、AIトレーニングのための高品質のデータの不足です。他の分野で働いているが研究にAIを使用している人々は、十分なスキルを持つ科学者やトレーニングリソースの不足、セキュリティとプライバシーをより懸念しています。AIを使用していない研究者は、AIは必要ない、AIは実用的ではないと思う、またはこれらのAIツールに取り組む経験が不足していると言います。 **ビジネスの巨人がAIコンピューティングリソースの所有権を支配しており、AIツール**も回答者の懸念事項であることに言及する価値があります。AIツール開発者の23%は、AIツールを開発する企業(GoogleとMicrosoftが最も一般的に言及されています)と協力または働いていると述べましたが、AIのみのユーザーの7%だけがこの経験を経験しています。全体として、回答者の半数以上が、AIを使用してこれらの企業の科学者と協力する研究者にとって「非常に」または「やや」重要であると評価しました。 開発に加えて、使用上の問題もあります。研究者は以前、科学研究でAIツールを盲目的に使用すると、誤った、誤った、再現不可能な研究結果につながる可能性があると述べていました。カンザス州立大学マンハッタンのコンピューター科学者であるLior Shamirは、次のように述べています。>機械学習は便利な場合もありますが、AIは提供できるよりも多くの疑問を投げかけます。 科学者が何をしているのかを知らずにAIを使用すると、誤った発見につながる可能性があります。ジャーナル編集者と査読者がAIを用いた論文を適切に査読できるかどうかを尋ねたところ、回答者は分かれました。研究にAIを使用したが直接開発しなかった研究者の約半数は、確信が持てないと述べ、1/4はレビューが適切であると述べ、1/4は不十分であると述べました。 AIを直接開発する研究者は、編集とレビューのプロセスをより肯定的に見る傾向があります。 さらに、Natureは回答者に、AIが社会に及ぼす7つの潜在的な影響についてどの程度懸念しているかを尋ねました。誤った情報の拡散は研究者にとって最大の懸念事項となり、3分の2が「非常に懸念している」または「非常に懸念している」と述べました。最も心配なのは、AIが人類に実存的な脅威をもたらす可能性があることです。 参考リンク:

自然調査:AIが「必需品」になったと考えている科学者はわずか4%

元のソース: 量子ビット

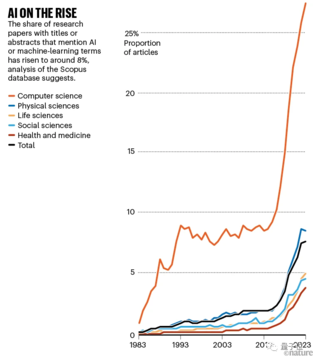

AI論文は急増し、本当に「必要」だと感じている研究者はわずか4%?!

より正確には、科学研究でAIツールを使用する研究者の調査結果。

これらの個人は、2022年の最後の4か月間に、世界中でさまざまな主題分野から論文を発表した40,000人以上の研究者から選ばれました。

また、AIツールを開発する「インサイダー」と、研究にAIツールを使用しない「アウトサイダー」も調査に含まれており、合計で**1600+**となっています。

その成果は「AIと科学:1,600人の研究者が考えること」というタイトルで出版されました。

1600人の研究者からのAIビュー

この調査では、機械学習と生成型AIに対する研究者の認識に焦点を当てました。

調査結果の客観的妥当性を保証するために、前述のように、Natureは、2022年の最後の4か月間に論文を発表した世界中の40,000人以上の科学者に電子メールで連絡を取り、Natureニュースレターの読者に調査への参加を呼びかけました。

最終的に、1659人の回答者が選ばれ、具体的なサンプル構成は次のとおりです。

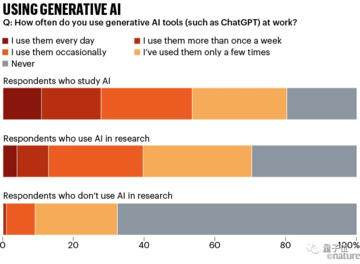

これらのうち、48%がAIを直接開発または研究し、30%が研究にAIを使用し、22%が研究にAIを使用しませんでした。

詳細な結果を見てみましょう。

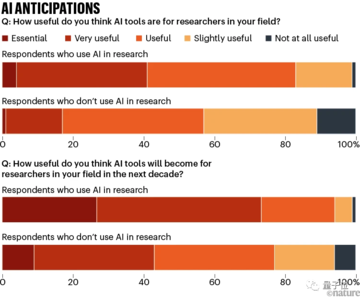

調査によると、研究にAIを使用している人の1/4以上が、AIツールは今後10年以内に自分の分野で「必需品」になると考えています。

しかし、AIツールが「必需品」になったと考えているのはわずか4%で、AIが将来「非常に役立つ」と考えているのは47%です。

対照的に、AIを使わない研究者はあまり興味がありません。 それでも、9%はこれらのテクノロジーが今後10年以内に「不可欠」になると考えており、別の34%は「非常に役立つ」と述べています。

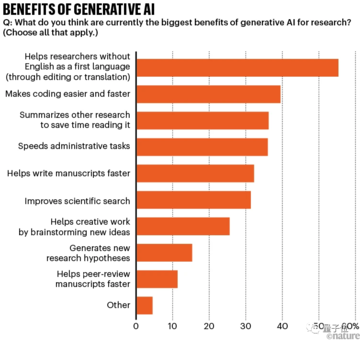

ほとんどの人は、ジェネレーティブAIツールの大きな利点の1つは要約と翻訳であり、英語を母国語としない研究者が論文の文法とスタイルを改善するのに役立つと考えています。 第二に、コードを書く能力も認められています。

さらに、頻度統計によると、AIに関心のある研究者でさえ、研究に大規模な言語モデルを使用することがよくあります。

フィンランドのトゥルク大学の物理学者ヨハネス・ニスカネンは次のように述べています。

この調査では、NatureはAIの開発が直面しているジレンマに関する研究者の見解も掘り下げています。

AI開発のジレンマ

研究者の約半数は、AIの開発または使用に障害を経験していると述べました。

AI開発に携わる研究者にとって最大の懸念は、コンピューティングリソースの不足、研究資金の不足、AIトレーニングのための高品質のデータの不足です。

他の分野で働いているが研究にAIを使用している人々は、十分なスキルを持つ科学者やトレーニングリソースの不足、セキュリティとプライバシーをより懸念しています。

AIを使用していない研究者は、AIは必要ない、AIは実用的ではないと思う、またはこれらのAIツールに取り組む経験が不足していると言います。

AIツール開発者の23%は、AIツールを開発する企業(GoogleとMicrosoftが最も一般的に言及されています)と協力または働いていると述べましたが、AIのみのユーザーの7%だけがこの経験を経験しています。

全体として、回答者の半数以上が、AIを使用してこれらの企業の科学者と協力する研究者にとって「非常に」または「やや」重要であると評価しました。

研究者は以前、科学研究でAIツールを盲目的に使用すると、誤った、誤った、再現不可能な研究結果につながる可能性があると述べていました。

カンザス州立大学マンハッタンのコンピューター科学者であるLior Shamirは、次のように述べています。

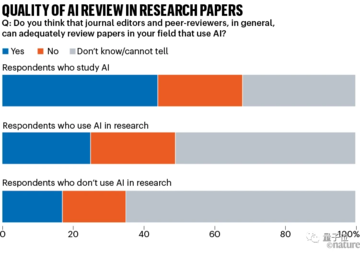

ジャーナル編集者と査読者がAIを用いた論文を適切に査読できるかどうかを尋ねたところ、回答者は分かれました。

研究にAIを使用したが直接開発しなかった研究者の約半数は、確信が持てないと述べ、1/4はレビューが適切であると述べ、1/4は不十分であると述べました。 AIを直接開発する研究者は、編集とレビューのプロセスをより肯定的に見る傾向があります。

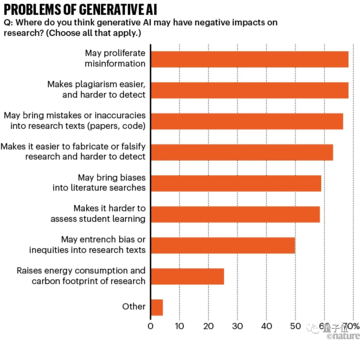

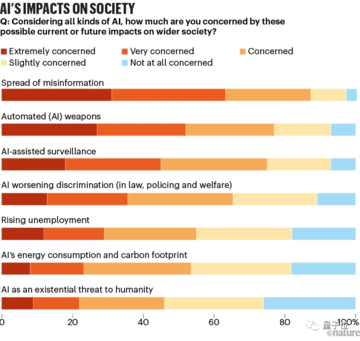

誤った情報の拡散は研究者にとって最大の懸念事項となり、3分の2が「非常に懸念している」または「非常に懸念している」と述べました。

最も心配なのは、AIが人類に実存的な脅威をもたらす可能性があることです。