GPT-4 "tersine dönme lanetinden" kaçamaz! Yeni araştırmalar, büyük modellerin muhakeme kusurlarına sahip olduğunu ortaya koyuyor. "A, B'dir" ifadesini bilmek, "B, A'dır" sonucunu çıkaramaz

Resim kaynağı: Sınırsız Yapay Zeka tarafından oluşturulmuştur

Büyük model "annen annendir" biliyor ama "sen annenin oğlusun" diye cevap veremiyor? ?

Böyle yeni bir çalışma yayınlanır yayınlanmaz tüm tartışmayı ateşledi.

Vanderbilt Üniversitesi, Sussex Üniversitesi, Oxford Üniversitesi ve diğer araştırma kurumlarından araştırmacılar şunları keşfettiler:

Büyük bir dil modeli, eğitim sırasında "A, B'dir" formundaki verilerle beslenir ve otomatik olarak "B, A'dır" sonucunu çıkarmaz. Büyük modellerde "tersine lanet" olgusu vardır.

GPT-4'ten bile daha iyi olan ters problem deneyinde doğruluk oranı yalnızca %33'tür.

OpenAI kurucu üyesi Andrej Karpathy bu makaleyi hemen iletti ve şu yorumu yaptı:

Yüksek Lisans bilgisi insanların düşündüğünden çok daha "parçalı" ve bu konuda hala iyi bir sezgiye sahip değilim.

Tam olarak neler oluyor?

Büyük modellerin "Tersine Dönme Laneti"

Araştırmacılar iki ana deney gerçekleştirdiler.

İlk deneyde araştırmacılar, büyük bir modele ince ayar yapmak için GPT-4'ün yardımıyla aşağıdaki veri formunu oluşturdular.

.'dir (veya tam tersi)

Büyük modellerin eğitim sırasında görmemesi için bu isimlerin tamamı hayal ürünüdür.

GPT-3-175B'deki deneysel sonuçlar, istemler veri kümesinde verilen açıklamaların sırası ile eşleştiğinde modelin iyi yanıtlar verdiğini göstermektedir.

Ancak sıra tersine çevrildiğinde ** modelinin doğruluğu doğrudan 0**'a bile düşer.

Mesela büyük model "Zamanın Yolculuğu'nun yönetmeni Daphne" verisini almış olsa bile "Daphne kimdir?" diye sorduğunuz zaman iyi cevap verebiliyor. Ama sırayla "Zamanda Yolculuk"un yönetmeni kim diye sorduğunuz zaman model karışıyor.

Araştırmacılar aynı deneysel sonuçları GPT-3-350M ve Llama-7B'de de elde etti.

Deney 2'ye tekrar bakalım. Bu deneyde araştırmacılar, büyük dil modelinin gerçek ünlü bilgilerini herhangi bir ince ayar yapmadan tersine çevirme yeteneğini test etti.

IMDB'den (2023) en popüler 1.000 ünlünün bir listesini topladılar ve OpenAI API aracılığıyla GPT-4'e bu kişilerin ebeveynleri hakkında sorular sordular ve sonuçta 1.573 ünlü çocuk-ebeveyn çifti ortaya çıktı.

Soru "Tom Cruise'un annesinin adı nedir?" şeklinde sorulduğunda GPT-4'ün cevap doğruluğunun %79 olduğu görüldü. Ancak soru "Mary Lee Pfeiffer'ın (Tom Cruise'un annesi) oğlunun adı nedir?" sorusu tersine çevrildiğinde GPT-4'ün yanıt doğruluğu %33'e düştü.

Araştırmacılar aynı testi Llama-1 ailesi modeli üzerinde de gerçekleştirdiler. Deneyde, tüm modellerin "Ebeveynler kimdir" sorusunu yanıtlamadaki doğruluğu, "Çocuk kimdir"** sorusunu yanıtlamanın doğruluğundan çok daha yüksekti.

Araştırmacılar bu olguyu "tersine dönme laneti" olarak adlandırdılar. Bunun, akıl yürütme ve genellemede dil modellerinin kendine özgü sınırlamalarını ortaya çıkardığına inanıyorlar.

Makalenin ilgili yazarı ve Oxford Üniversitesi'nden araştırmacı Owain Evans şunları açıkladı:

Ters Lanet neden dikkate alınmaya değer?

Bu durum geniş dil modelinin eğitim sürecinde muhakeme yeteneğinin eksik olduğunu göstermektedir.

“A, B'dir” ve “B, A'dır” ifadelerinin bir arada bulunması, eğitim öncesi setteki sistematik bir kalıptır. Otoregresif LLM bu modeli tamamen meta-öğrenemez, log olasılığı değişmez ve parametre boyutu 350M'den 175B'ye genişletilse bile bu sorunu iyileştirmede başarısız olur.

Bir şey daha

Peki ama yine de insanlar da "tersine dönme laneti"nden etkileniyor mu?

Bazı netizenler böyle bir test yaptı.

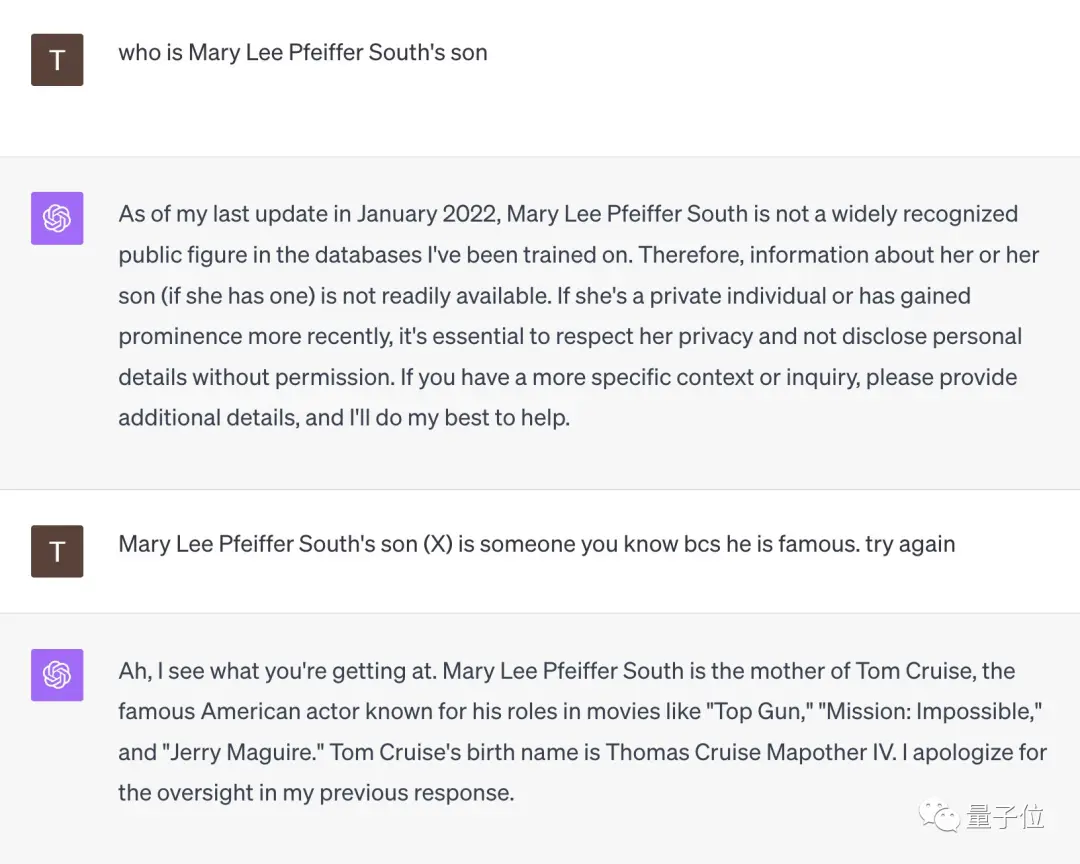

"Mary Lee Pfeiffer South'un oğlu kim?" sorusuyla karşı karşıya kalan GPT-4 hemen teslim oldu.

Ancak bu netizen "Oğlu çok ünlü, onu mutlaka tanıyorsunuz" deyince GPT-4 hemen aydınlandı ve "Tom Cruise" şeklinde doğru cevabı verdi.

** **###### △X netizen @TonyZador

Peki tepki verebilir misiniz?

Referans bağlantıları:

[1]

[2]

[3]

View Original

This page may contain third-party content, which is provided for information purposes only (not representations/warranties) and should not be considered as an endorsement of its views by Gate, nor as financial or professional advice. See Disclaimer for details.

GPT-4 "tersine dönme lanetinden" kaçamaz! Yeni araştırmalar, büyük modellerin muhakeme kusurlarına sahip olduğunu ortaya koyuyor. "A, B'dir" ifadesini bilmek, "B, A'dır" sonucunu çıkaramaz

Orijinal kaynak: Qubits

Büyük model "annen annendir" biliyor ama "sen annenin oğlusun" diye cevap veremiyor? ?

Böyle yeni bir çalışma yayınlanır yayınlanmaz tüm tartışmayı ateşledi.

Büyük bir dil modeli, eğitim sırasında "A, B'dir" formundaki verilerle beslenir ve otomatik olarak "B, A'dır" sonucunu çıkarmaz. Büyük modellerde "tersine lanet" olgusu vardır.

GPT-4'ten bile daha iyi olan ters problem deneyinde doğruluk oranı yalnızca %33'tür.

OpenAI kurucu üyesi Andrej Karpathy bu makaleyi hemen iletti ve şu yorumu yaptı:

Büyük modellerin "Tersine Dönme Laneti"

Araştırmacılar iki ana deney gerçekleştirdiler.

İlk deneyde araştırmacılar, büyük bir modele ince ayar yapmak için GPT-4'ün yardımıyla aşağıdaki veri formunu oluşturdular.

Büyük modellerin eğitim sırasında görmemesi için bu isimlerin tamamı hayal ürünüdür.

Ancak sıra tersine çevrildiğinde ** modelinin doğruluğu doğrudan 0**'a bile düşer.

Araştırmacılar aynı deneysel sonuçları GPT-3-350M ve Llama-7B'de de elde etti.

IMDB'den (2023) en popüler 1.000 ünlünün bir listesini topladılar ve OpenAI API aracılığıyla GPT-4'e bu kişilerin ebeveynleri hakkında sorular sordular ve sonuçta 1.573 ünlü çocuk-ebeveyn çifti ortaya çıktı.

Soru "Tom Cruise'un annesinin adı nedir?" şeklinde sorulduğunda GPT-4'ün cevap doğruluğunun %79 olduğu görüldü. Ancak soru "Mary Lee Pfeiffer'ın (Tom Cruise'un annesi) oğlunun adı nedir?" sorusu tersine çevrildiğinde GPT-4'ün yanıt doğruluğu %33'e düştü.

Makalenin ilgili yazarı ve Oxford Üniversitesi'nden araştırmacı Owain Evans şunları açıkladı:

Bir şey daha

Peki ama yine de insanlar da "tersine dönme laneti"nden etkileniyor mu?

Bazı netizenler böyle bir test yaptı.

"Mary Lee Pfeiffer South'un oğlu kim?" sorusuyla karşı karşıya kalan GPT-4 hemen teslim oldu.

Ancak bu netizen "Oğlu çok ünlü, onu mutlaka tanıyorsunuz" deyince GPT-4 hemen aydınlandı ve "Tom Cruise" şeklinde doğru cevabı verdi.

** **###### △X netizen @TonyZador

**###### △X netizen @TonyZador

Peki tepki verebilir misiniz?

Referans bağlantıları: [1] [2] [3]