Ця хвиля розвитку штучного інтелекту настільки швидко поширила свій вплив на різні сфери, що справді перевершила очікування більшості людей. Минулого тижня Sequoia (Sequoia America) вважала, що штучний інтелект відкрив свою другу главу, і намалювала нову карту штучного інтелекту та карту стека (стека) для розробників LLM з точки зору сценаріїв застосування.

Однак, судячи з напрямків фінансування, нинішній розвиток штучного інтелекту все ще перебуває на стадії боротьби між богами, і ця модель майже сформувалася. Після того як OpenAI отримав майже 11 мільярдів доларів США від Microsoft та інших і був оцінений майже в 29 мільярдів доларів США, його конкурент Anthropic вчора оголосив про альянс з Amazon. Amazon інвестує в нього до 4 мільярдів доларів США, що зробить Anthropic другим після OpenAI. з точки зору фінансування стартапів ШІ.

Після цього фінансування, за винятком Apple, індустрія штучного інтелекту в основному сформувала таку схему боротьби богів:

Microsoft + OpenAI

Google + DeepMind

Meta + MetaAI

Amazon + Anthropic

Tesla + xAI

Звичайно, як постачальника інфраструктури нижчого рівня, стратегія Nvidia полягає в тому, що, очевидно, всі хочуть цього, і немає дуже серйозної позиції щодо якоїсь конкретної компанії. Нижче наведено загальну ситуацію щодо 15 єдинорогів зі штучним інтелектом. З точки зору оцінки та фінансування, більшу частину складають великі моделі LLM, а 50% єдинорогів зі штучним інтелектом було створено після 2021 року:

Сьогодні a16z поділилися своїми розмовами із засновниками кількох провідних компаній штучного інтелекту, вважаючи, що ми перебуваємо в третій ері комп’ютерів, і обговорили 16 цікавих тем з точки зору сьогодення, майбутнього та відкритості штучного інтелекту. Серед учасників цієї розмови:

Партнер a16z Мартін Касадо

Технічний директор OpenAI Міра Мураті

Співзасновник і генеральний директор Roblox Девід Базукі

Співзасновник і генеральний директор Figma Ділан Філд

Співзасновник і генеральний директор Anthropic Даріо Амодей

Технічний директор і виконавчий віце-президент Microsoft Кевін Скотт

Insitro Засновник і генеральний директор Дафна Коллер

Співзасновник і генеральний директор Databricks Алі Годсі

Співзасновник і генеральний директор Character.AI Ноам Шазір

Оскільки стаття занадто довга, майже 10 000 слів, я використав штучний інтелект, щоб коротко зібрати її. Деякі терміни можуть бути неточними. Зацікавлені друзі можуть прочитати оригінальний текст англійською мовою:

1 Ми на початку третьої ери комп’ютерів

Мартін Касадо, a16z:

Я дійсно думаю, що ми вступаємо в третю еру комп’ютерів. Мікрочіпи знизили граничні витрати на обчислення до нуля, Інтернет знизив граничні витрати на розповсюдження до нуля, а тепер великі моделі фактично знизили граничні витрати на створення до нуля. Коли відбувалися попередні епохи, ви навіть не підозрювали, які нові компанії будуть створені. Ніхто не передбачив ні Amazon, ні Yahoo. Треба готуватися до нової хвилі знакових компаній. Ноам Шазір, AI персонажа:

Ми справді живемо в момент «першого літака братів Райт». У нас уже є те, що працює і тепер корисно для великої кількості прикладних сценаріїв. Схоже, він дуже добре масштабується і стане ще кращим. Але попереду ще більше проривів, тому що зараз усі вчені ШІ у світі наполегливо працюють, щоб покращити ці речі. Кевін Скотт, Microsoft:

Особливо за останні кілька років і, можливо, особливо за останні 12 місяців, із запуском ChatGPT і GPT-4, ви дійсно можете побачити потенціал цієї платформи, щоб бути таким же, як ПК або смартфон. Ряд технологій зробить можливим безліч нових речей, і багато людей створюватимуть щось на основі цих нових речей. ## 2 Ця хвиля генеративного штучного інтелекту має економічні принципи, які сприяють ринковій трансформації.

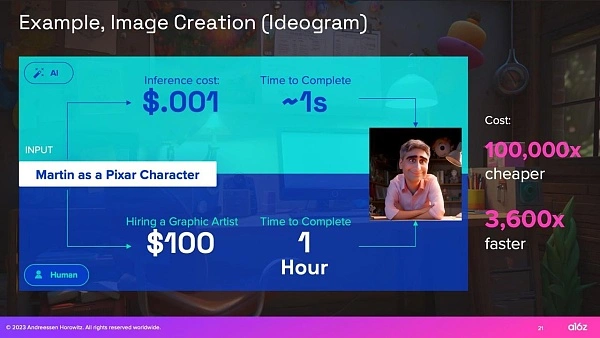

Щоб технологічні інновації спровокували ринкову трансформацію, економічні вигоди мають бути дуже привабливими. Хоча в попередніх циклах штучного інтелекту було досягнуто багато технологічних досягнень, їм бракувало трансформаційних економічних переваг. У поточній хвилі штучного інтелекту ми вже бачимо перші ознаки економічних покращень у 10 000 разів (або більше) у деяких випадках використання, і в результаті впровадження та розвиток штучного інтелекту, здається, відбувається набагато швидше, ніж будь-який попередній зсув.

Мартін Касадо, a16z:

Ринкова трансформація не відбувається через десятикратне економічне покращення. Вони створюються, коли стають у десять тисяч разів кращими, ніж раніше. Скажімо, я хочу створити зображення, яке перетворює мене на персонажа Pixar. Якщо я використовую одну з цих моделей зображення, вартість висновку становитиме десяту частину цента, і, скажімо, це займе 1 секунду. Якщо порівнювати з наймом художника-оформлювача, припустімо, що погодинна ставка становить 100 доларів. З точки зору вартості та часу, ви побачите величезну різницю на 4-5 порядків величини. Для економістів це той тип поворотного моменту, який вони шукають, коли фактично відбувається величезна дислокація ринку.

Якщо вам потрібен приклад того, наскільки божевільним це може бути, я не бачу причин, чому ви не можете створити повну гру - 3D-моделі, персонажів, звуки, музику, історію тощо. Усі ці речі зараз роблять стартапи, і якщо порівняти вартість сотень мільйонів доларів і років із вартістю кількох доларів, ми маємо асиметрію в економіці на рівні Інтернету та мікрочіпів.

3 Для деяких ранніх сценаріїв застосування: Креативність > Правильність

Галюцинації є загальновідомою проблемою сучасних великих моделей LLM, але для деяких програм здатність вигадувати речі є скоріше функцією, ніж помилкою. Порівняно з ранніми сценаріями використання машинного навчання, де правильність n-рівня є критичною (наприклад, безпілотні автомобілі), багато ранніх варіантів використання LLM (віртуальні друзі та компаньйони, концепції мозкового штурму або створення онлайн-ігор) характеризуються: фокус У сферах, де креативність важливіша за правильність.

Ноам Шазір, Character.AI:

Розваги – це індустрія, яка щорічно обробляє 2 трильйони доларів. І темний секрет полягає в тому, що розваги схожі на ваших неіснуючих віртуальних друзів. Це чудовий перший приклад використання загального штучного інтелекту. Наприклад, якби ви хотіли запустити лікаря, це було б набагато повільніше, тому що вам потрібно бути дуже, дуже, дуже обережними, щоб не надати неправильну інформацію. Але з друзями ви можете зробити це дуже швидко, це просто весело, і вигадування стає особливістю. Девід Базукі, Roblox:

З 65 мільйонів користувачів Roblox більшість не творять на тому рівні, на якому хотіли б. Довгий час ми уявляли гру-симулятор Project Runway, у якій можна було б використовувати швейну машину та тканину та моделювати все це в 3D, але навіть це було дещо складним для більшості з нас. Я думаю, що тепер, коли Project Runway вийде на Roblox, це буде текстова підказка, підказка із зображенням або голосова підказка. Якби я допомагав тобі шити цю сорочку, я б сказав: я хочу блакитну джинсову сорочку, кілька ґудзиків і тонший крій. Фактично, я думаю, що ми побачимо прискорення творення. Ділан Філд, Figma:

Наразі ми знаходимося на етапі, коли штучний інтелект може завершити першу чернетку, але перейти від цього до кінцевого продукту все ще дещо складно, і для цього часто потрібна команда. Але якщо ви зможете змусити штучний інтелект пропонувати людям елементи інтерфейсу та робити це у спосіб, який дійсно має сенс, я думаю, що це відкриє цілу нову еру дизайну, створюючи контекстні дизайни, які реагують на наміри користувача. Я вважаю, що це буде захоплююча ера для всіх дизайнерів у співпраці з цими системами штучного інтелекту. ## 4 Для інших прикладів, точність програмування «другого пілота» покращиться з використанням людини.

Хоча штучний інтелект має потенціал для покращення роботи людини в багатьох сферах, програмування «других пілотів» стало першим широко поширеним помічником ШІ з кількох причин:

По-перше, розробники часто першими впроваджують нові технології — аналіз порад ChatGPT у травні/червні 2023 року показав, що 30% порад ChatGPT стосувалися програмування. По-друге, найбільші магістратури навчаються на масивних наборах даних (таких як Інтернет), що робить їх особливо вправними у відповідях на запити, пов’язані з програмуванням. Нарешті, люди в циклі - це користувачі. Отже, хоча точність важлива, розробник-людина з другим пілотом зі штучним інтелектом може перевірити правильність швидше, ніж розробник-людина поодинці.

Мартін Касадо, a16z:

Якщо вам потрібно зробити це правильно, і є багато складних випадків використання, виконайте всю технічну роботу самостійно або найміть людей. Зазвичай ми наймаємо людей. Це змінні витрати. По-друге, оскільки хвіст рішень часто дуже довгий, як-от численні аномалії, які можуть виникнути під час автономного водіння, інвестиції, необхідні для випередження, збільшуються, а вартість зменшується. Це створює ефект зворотної економії масштабу.

Ця людина в циклі, яка раніше була в центральній компанії, тепер є користувачем, тому це більше не є змінними витратами для бізнесу та економічними витратами на роботу. Людину в циклі перемістили, тож ви можете робити те, де важлива правильність, наприклад, розробляти код, і оскільки це ітераційно, кількість накопичених помилок зменшено, оскільки ви постійно отримуєте відгуки та виправлення від користувачів. Коли розробники можуть запитувати чат-бота AI, щоб допомогти їм написати та усунути неполадки в коді, це змінює спосіб розробки двома суттєвими способами: 1) полегшує розробку для більшої кількості людей, співпрацює, оскільки це відбувається через інтерфейс природної мови, 2) люди-розробники виробляйте більше продуктів і зберігайте їх довше.

Міра Мураті, OpenAI:

Програмування стає все менш абстрактним. Ми фактично можемо розмовляти з комп’ютерами з високою пропускною здатністю природною мовою. Ми використовуємо цю технологію, і ця технологія допомагає нам зрозуміти, як із нею працювати, а не «програмувати». Кевін Скотт, Microsoft:

GitHub є першим прикладом цієї моделі другого пілота, яку ми намагаємося побудувати, а саме: як ви берете роботу зі знаннями, яку виконує хтось, і використовуєте штучний інтелект, щоб допомогти їм бути значно продуктивнішими у виконанні певних типів когнітивної роботи ? Найкраще те, що виходячи з того, що ми спостерігали з розробниками, штучний інтелект допомагає їм залишатися в стані потоку довше, ніж вони б це зробили в іншому випадку.

Не застрягайте, коли пишете шматок коду й думаєте: «Я не знаю, як зробити наступне. Мені потрібно піти переглянути документацію. Мені потрібно запитати іншого інженера, який, можливо, працює над щось." "Можливість звільнитися від потоку, перш ніж вийти зі стану потоку, надзвичайно цінна. Для тих, хто розглядає корисність генеративних інструментів штучного інтелекту, створених для цілей, відмінних від розробки програмного забезпечення, цю концепцію станів потоку корисно розглянути. Ділан Філд, Figma:

Найкращі дизайнери починають більше думати про код, а найкращі розробники починають більше думати про дизайн. Крім дизайнерів і розробників, наприклад, якщо ви думаєте про людей, які працюють із продуктами, вони, можливо, раніше працювали над специфікаціями, але тепер вони більше працюють над макетами, щоб ефективніше доносити свої ідеї. По суті, це дозволить будь-кому в організації швидше переходити від ідеї до розробки та, можливо, навіть виробництва. Але все одно потрібно відточувати кожен крок. Вам потрібен хтось, про кого можна по-справжньому подумати: «Добре, які ідеї ми збираємося дослідити? від першого проекту до кінцевого продукту. ## 5 Поєднання штучного інтелекту та біології може прискорити нові способи лікування хвороб і мати глибокий вплив на здоров’я людини

Біологія неймовірно складна — можливо, навіть за межами здатності людського розуму повністю зрозуміти. Однак взаємодія штучного інтелекту та біології може прискорити наше розуміння біології та призвести до деяких із найбільш захоплюючих і трансформаційних технологічних досягнень нашого часу. Біологічні платформи, керовані штучним інтелектом, мають потенціал розкрити раніше невідомі біологічні ідеї, що призведе до нових медичних проривів, нових методів діагностики та здатності раніше виявляти та лікувати хвороби, потенційно навіть запобігаючи їм до того, як вони виникнуть.

Дафна Коллер, insitro:

У певні періоди нашої історії певні наукові дисципліни досягли неймовірних успіхів за відносно короткий проміжок часу. У 1950-х роках дисципліною були обчислення, і ми використовували ці машини для виконання обчислень, які до того часу могли виконувати лише люди. Потім у 1990-х роках відбулося таке цікаве розходження. З одного боку, наука про дані та статистика принесли нам сучасне машинне навчання та штучний інтелект. Інша сторона — це те, що я вважаю кількісною біологією, тобто ми вперше починаємо вимірювати біологію в масштабі, окрім відстеження 3 генів у експерименті, який тривав 5 років.

Тепер, 2020 рік – останній раз, коли дві дисципліни по-справжньому об’єдналися, приносячи нам еру цифрової біології, можливості вимірювати біологію з безпрецедентною точністю та масштабом; інтерпретувати незрозуміле за допомогою машинного навчання та інструментів науки про дані Впевнено величезні обсяги даних, різних біологічні масштаби та різні системи, а потім використання таких інструментів, як редагування геному CRISPR, щоб повернути це розуміння в інженерну біологію, щоб ми могли змусити біологію робити те, для чого вона не призначена.

Тепер ми нарешті можемо виміряти біологію в масштабі, на клітинному (і іноді субклітинному) та організмовому рівнях. Це дає нам змогу вперше розгорнути машинне навчання справді значущим чином.

Ми побудували модель біологічної мови. Це як GPT, але для клітинок. У нас є мова клітин і те, як клітини виглядають. Ви вимірюєте сотні мільйонів клітин у різних станах, а потім, подібно до великої мовної моделі для природної мови, з невеликою кількістю даних ви можете почати запитувати: «Добре, як хвороба переміщує хвороботворний ген з одного «Яким чином лікування повертає вас із стану хвороби до стану здоров’я?» Це надзвичайно потужно. Як і в інших мовних моделях, чим більше даних ви подаєте, тим краще воно стає. ## 6 Передача моделі в руки користувачів допоможе нам відкрити нові сценарії застосування

У той час як попередні ітерації моделей штучного інтелекту мали на меті перевершити людей у певних завданнях, LLM на основі Transformer вирізняються загальними міркуваннями. Але те, що ми створили хорошу загальну модель, не означає, що ми зламали, як застосувати її до конкретного випадку використання. Подібно до того, як залучення людей до циклу у формі RLHF має вирішальне значення для покращення продуктивності сучасних моделей штучного інтелекту, отримання нових технологій у руках користувачів і розуміння того, як вони їх використовують, буде ключовим для визначення того, які програми створювати на основі цих основних моделі.топ.

Кевін Скотт, Microsoft:

Треба пам'ятати: модель - це не продукт. Як підприємець, ви розумієте: хто ваші користувачі? У чому їхня проблема? Чим ви можете їм допомогти? Потім визначте, чи справді штучний інтелект є корисною інфраструктурою для вирішення проблем користувачів – це постійне значення. Штучний інтелект схожий на нову, цікаву інфраструктуру, яка дозволяє вирішувати нові класи проблем або вирішувати старі класи проблем кращими способами. Міра Мураті, OpenAI:

Ми точно не знаємо, як виглядатиме майбутнє, тому ми намагаємося зробити ці інструменти та методи доступними для багатьох інших людей, щоб вони могли експериментувати, а ми могли бачити, що станеться. Це стратегія, яку ми використовуємо з самого початку. За тиждень до запуску ChatGPT ми хвилювалися, що він недостатньо хороший. Ми всі бачили, що відбувається: ми викладаємо це там, а потім люди кажуть нам, що це достатньо добре, щоб відкривати нові випадки використання, і ви бачите всі ці нові варіанти використання. ## 7 Пам'ять ваших друзів ШІ стане кращою

У той час як дані, обчислення та параметри моделі підтримують загальні міркування LLM, контекстні вікна підтримують їх короткочасну пам’ять. Контекстні вікна зазвичай вимірюються кількістю токенів, які вони можуть обробляти. Сьогодні більшість контекстних вікон мають приблизно 32 КБ, але з’являються більші контекстні вікна, а разом з ними з’являється можливість запускати більші документи з більшим контекстом через LLM.

Ноам Шазір, Character.AI :

Наразі моделі, які ми пропонуємо, використовують контекстні вікна з тисяч токенів, тобто ваші друзі на все життя пам’ятають, що сталося за останні півгодини. Якщо ви можете викинути багато інформації, все піде на краще. Він повинен мати можливість дізнатися про вас мільярд речей. Пропускна здатність HBM є. Даріо Амодей, Anthropic:

Єдине, що, на мою думку, все ще недооцінюється, це довший контекст і речі, які з ним пов’язані. Мені здається, у людей в голові виникає образ, що вони мають цього чат-бота. «Я поставив йому запитання, і він відповів на нього. Але ви можете завантажити юридичний договір і сказати: «Які п’ять найбільш незвичайних умов цього юридичного договору?» Або завантажте фінансовий звіт і скажіть: "Коротко про те, де знаходиться ця компанія. Що дивного порівняно з тим, що сказав цей аналітик два тижні тому? Усі ці знання маніпулюють величезними обсягами даних, які людям потрібно порахувати, і обробляють їх". години на читання. Я думаю, що це більш імовірно, ніж те, що роблять люди. Ми тільки починаємо". ## 8 Голосові чат-боти, боти та інші способи взаємодії зі штучним інтелектом є важливою областю досліджень

Сьогодні більшість людей взаємодіють зі штучним інтелектом у формі чат-ботів, але це тому, що чат-ботів часто легко створити, а не тому, що вони є найкращим інтерфейсом для будь-якого випадку використання.

Багато розробників зосереджені на розробці нових способів взаємодії користувачів із моделями ШІ за допомогою мультимодального ШІ. Користувачі зможуть взаємодіяти з мультимодальними моделями так само, як вони взаємодіють з рештою світу: за допомогою зображень, тексту, голосу та інших медіа. Ідучи далі: Embodied AI зосереджується на штучному інтелекті, який може взаємодіяти з фізичним світом, таким як безпілотні автомобілі.

Міра Мураті, OpenAI:

Я думаю, що сьогоднішня базова модель добре представляє світ у тексті. Ми додаємо інші модальності, наприклад зображення та відео, щоб ці моделі могли отримати більш повну картину світу, подібну до того, як ми розуміємо та спостерігаємо світ. Ноам Шазір, Character.AI :

Можливо, ви хочете почути голос, побачити обличчя або просто мати можливість спілкуватися з кількома людьми. Це як якщо б вас обрали президентом, ви отримали навушники та цілу команду друзів чи радників. Або як ви заходите у «веселий бар», і всі знають ваше ім’я та раді, що ви прийшли. Дафна Коллер, insitro:

Наступний можливий рубіж впливу штучного інтелекту – це коли штучний інтелект починає взаємодіяти з фізичним світом. Ми всі бачимо, як це важко. Ми всі бачили, як важко побудувати самокерований автомобіль порівняно зі створенням чат-бота, чи не так? Ми робимо великий прогрес у створенні чат-ботів, і безпілотні автомобілі досі блокують пожежні машини в Сан-Франциско. Важливо розуміти цю складність, але також і масштаб впливу ## 9 Чи будемо мати загальні моделі, купу спеціалізованих моделей чи поєднання обох?

Які варіанти використання найкраще підходять для більших базових моделей із «вищим інтелектом» чи менших спеціалізованих моделей і наборів даних? Подібно до дискусії «хмара» проти «крайньої» архітектури, яка тривала десять років тому, відповідь залежить від того, скільки ви готові платити, наскільки точним вам повинен бути результат і яку затримку ви можете витримати. Відповіді на ці запитання можуть змінюватися з часом, оскільки дослідники розробляють більш ефективні з обчислювальної точки зору методи для точного налаштування великих базових моделей для конкретних випадків використання.

У довгостроковій перспективі ми можемо надмірно змінювати моделі, які використовуються для яких варіантів використання, оскільки ми все ще перебуваємо на ранніх стадіях побудови інфраструктури та архітектури для підтримки майбутньої хвилі додатків ШІ.

Алі Годсі, Databricks:

Це трохи схоже на 2000 рік, Інтернет ось-ось домінуватиме над усім, і все, що має значення, це те, хто може створити найкращий маршрутизатор. Ринкова капіталізація Cisco досягла максимуму в 5 трильйонів доларів США в 2000 році, перевершивши на той час Microsoft. Отже, хто має найбільшу LLM (мовну модель)? Зрозуміло, що той, хто зможе створити найбільший і повністю його навчити, матиме контроль над усім ШІ та майбутніми людьми. Але, як і в Інтернеті, хтось інший придумає такі ідеї, як Uber і водіння таксі пізніше. Інші люди будуть думати: «Гей, я хочу подивитися, що роблять мої друзі на Facebook». Це можуть бути величезні можливості для бізнесу, і не тільки такі компанії, як OpenAI, Databricks або Anthropic, можуть створити модель. Домінуйте над усіма програмами сценарії. Щоб створити лікаря, якому довіряють, потрібно докласти багато зусиль. Даріо Амодей, Anthropic:

Найбільшим фактором є інвестування більше грошей. Найдорожчі моделі, що випускаються сьогодні, коштують близько 100 мільйонів доларів, плюс-мінус порядок величини. Наступного року ми можемо побачити моделі від багатьох гравців вартістю близько 1 мільярда доларів, а до 2025 року ми побачимо моделі на мільярди або навіть 10 мільярдів доларів. Ця 100-кратна різниця поєднується з тим, що самі обчислення H100s стають швидшими - особливо великий стрибок через зниження точності. Поєднайте всі ці фактори разом, і якщо закони масштабування й надалі будуть застосовуватися, можливостей буде значно більше. Міра Мураті, OpenAI:

Це залежить від того, що ви хочете зробити. Зрозуміло, що системи штучного інтелекту дедалі більше братимуть на себе нашу роботу. Що стосується платформи OpenAI, ви бачите, що навіть сьогодні ми надаємо багато моделей через API, від дуже маленьких до найсучасніших моделей. Не завжди потрібно використовувати найпотужнішу або найкомпетентнішу модель. Іноді їм просто потрібна модель, яка відповідає їх конкретному випадку використання та є економічно ефективнішою. Ми хочемо, щоб люди створювали нашу модель і давали їм інструменти, щоб полегшити цей процес. Ми хочемо надати їм все більше і більше доступу та контролю, щоб ви могли передавати власні дані та налаштовувати ці моделі. Вам дійсно потрібно зосередитися на речах, які виходять за рамки моделі та визначають продукт. Девід Базукі, Roblox:

У будь-якій компанії на кшталт Roblox є, ймовірно, 20 або 30 вертикальних додатків для кінцевих користувачів, які дуже налаштовані – фільтрація природної мови дуже відрізняється від генерування 3D – і для кінцевого користувача ми хочемо, щоб усі ці додатки запускалися. Коли ми знижуємося [стек], у такій компанії, як наша, може виникнути природне об’єднання 2-3 моделей більшого та товстішого типу. Ми дуже точно налаштували дисципліни, які хочемо навчати, і зробили багато висновків для цих дисциплін. ## 10 Коли штучний інтелект набуває достатнього поширення на підприємстві, що відбувається з цими наборами даних?

Вплив генеративного штучного інтелекту на підприємства все ще знаходиться в зародковому стані – частково тому, що підприємства зазвичай повільніше рухаються, а частково тому, що вони усвідомили цінність своїх власних наборів даних і не обов’язково хочуть передавати дані іншій компанії, Якою б потужною не була їхня модель. Більшість корпоративних випадків використання вимагають високого ступеня точності, і підприємства мають 3 варіанти вибору LLM: створити власний LLM, скористатися постачальником послуг LLM, щоб створити його для них, або точно налаштувати основну модель – створення власного LLM не є легко.

Алі Госді, Databricks:

Одна річ, яка відбувається в мізках генеральних директорів і рад директорів, полягає в тому, що вони усвідомлюють: можливо, я зможу перемогти своїх конкурентів. Можливо, це криптоніт, який вбиває ваших ворогів. У мене є дані для генеративного штучного інтелекту, тому вони думають: «Я повинен створити це сам». Я повинен володіти інтелектуальною власністю. Ви хочете створити свій власний LLM з нуля? Це не тривіально, все одно вимагає багато графічних процесорів, коштує багато грошей і залежить від вашого набору даних і сценарію використання.

У нас є багато клієнтів, які хочуть дешевшу, меншу, спеціально виготовлену модель із дуже високою точністю та продуктивністю. Вони кажуть: "Привіт, це те, що я хочу зробити. Я хочу отримати хорошу класифікацію з цих зображень цього конкретного дефекту у виробничому процесі. "Тут важлива точність. Кожна унція точності, яку ви можете мені дати, має значення. Тут вам буде краще, якщо ви матимете хороший набір даних для навчання та зможете навчити меншу модель. Затримка буде швидшою, дешевшою, і так, ви точно зможете мати точність, яка перевершить справді великі моделі. Але модель, яку ви побудуєте, не розважатиме вас у вихідні та не допоможе вашим дітям робити уроки. ## 11 Закон масштабування приведе нас аж до AGI?

Наразі LLM дотримується закону масштабування: продуктивність моделі покращується, коли ви додаєте більше даних і обчислень, навіть якщо архітектура та алгоритми залишаються незмінними. Але як довго може тривати це правило? Чи триватиме це нескінченно довго, чи досягне своїх природних меж до того, як ми розробимо AGI?

Міра Мураті, OpenAI:

Немає доказів того, що ми не отримаємо кращі, потужніші моделі, оскільки ми продовжуємо розширювати доступ до даних і обчислень. Інше питання, чи приведе вас це до AGI. Можливо, на цьому шляху знадобляться деякі інші прориви та вдосконалення, але я думаю, що попереду ще довгий шлях щодо законів масштабування та справжнього отримання значних переваг від цих більших моделей. Даріо Амодей, Anthropic:

Навіть якщо тут не буде жодних алгоритмічних удосконалень і ми просто збільшимо масштаб до того рівня, який був досі, закон масштабування діятиме. Ноам Шазір, Character.AI:

Наша мета — бути компанією AGI та першочерговою компанією, яка займається продуктом, і це можна зробити, вибираючи правильні продукти, змушуючи нас робити те, що є узагальненим, роблячи моделі розумнішими, роблячи їх тим, чого хочуть люди, і доставляти послуги дешево та в масштабі. Закон масштабування заведе нас далеко. По суті, обчислення не такі вже й дорогі. Сьогодні експлуатаційні витрати становлять близько 10-18 доларів. Якщо ви можете робити ці речі ефективно, вартість буде набагато меншою за цінність вашого часу. Існує можливість масштабувати ці речі на порядки величини. ## 12 Які з’являються можливості?

Хоча деякі люди поспішають списувати з рахунків здатність створювати штучний інтелект, штучний інтелект вже набагато кращий за людей у виконанні певних завдань і буде продовжувати вдосконалюватися. Найкращі розробники змогли визначити найперспективніші нові можливості штучного інтелекту та створити моделі та компанії, які масштабують ці можливості до надійних можливостей. Вони визнають, що масштаб має тенденцію до підвищення надійності нових можливостей.

Міра Мураті, OpenAI:

Важливо звертати увагу на ці нові функції, навіть якщо вони дуже ненадійні. Особливо для людей, які сьогодні будують компанії, вам дійсно хочеться подумати: «Добре, що можливо сьогодні? Що ви бачите сьогодні?» Тому що дуже швидко ці моделі стануть надійними. Даріо Амодей, Anthropic:

Коли ми випустили GPT-2, найбільш вражаючим на той час було те, що: «Ви подаєте ці п’ять прикладів перекладу з англійської на французьку безпосередньо в мовну модель, а потім подаєте шосте англійське речення, і воно насправді буде перекладено французькою мовою. «Боже мій, він розуміє цей шаблон». Для нас це було божевіллям, хоча це був поганий переклад. Але наша думка така: «Дивіться, це лише початок дивовижної подорожі, тому що немає обмежень і вона може продовжувати масштабуватися.» Чому ті моделі, які ми бачили раніше, не можуть продовжувати існувати? Є стільки цілей для передбачення наступного слова, і є стільки всього, з чим ви можете їх випробувати, що це точно працює. А потім деякі люди подивилися на це і сказали: «Ви зробили дуже поганий інструмент перекладу роботів.» ## 13 Чи знизиться вартість обслуговування цих моделей?

Витрати на обчислення є одним із основних обмежень для масштабування цих моделей, а поточний дефіцит чіпів підвищує витрати через обмеження пропозиції. Однак, якщо наступного року Nvidia випустить більше H100, це має зменшити дефіцит GPU та потенційно знизити витрати на обчислення.

Ноам Шазір, Character.AI:

Минулого року на навчання моделі, яку ми зараз пропонуємо, було витрачено приблизно 2 мільйони доларів на обчислювальні цикли, і ми, ймовірно, збираємося зробити це знову за півмільйона доларів. Тож до кінця року ми збираємося розгорнути десятки балів IQ розумніших речей. Я бачу, що ці речі масово збільшуються. Тільки не так дорого. Здається, я вчора бачив статтю про те, що наступного року Nvidia збирається зробити ще один 1,5M H100, який буде 2M H100.

Це приблизно чверть трильйона операцій за секунду на людину. Це означає, що для кожної людини на планеті, на моделі зі 100 мільярдами параметрів, вона може обробляти 1 слово в секунду. Але не всі насправді мають доступ до нього, тому це не так вже й дорого. Ця річ дуже масштабована, якщо ви робите це правильно, і ми наполегливо працюємо, щоб це сталося. Даріо Амодей, Anthropic:

Моя основна думка полягає в тому, що висновок не коштуватиме так дорого. Основна логіка закону Скейлінга полягає в тому, що якщо ви збільшуєте обчислення на коефіцієнт n, вам потрібно збільшити дані на коефіцієнт квадратного кореня з n, а розмір моделі – на коефіцієнт квадратний корінь з n. Цей квадратний корінь в основному означає, що сама модель не збільшиться, а апаратне забезпечення працюватиме швидше, коли ви це робите. Я думаю, що ці речі залишаться актуальними протягом наступних 3-4 років. Без архітектурних інновацій вони стають трохи дорожчими. Якщо будуть архітектурні інновації, а я сподіваюся, вони будуть дешевшими. Але навіть якщо витрати на обчислення залишаться незмінними, підвищення ефективності на рівні моделі здається неминучим, особливо з огляду на те, що в цю сферу вливається стільки талантів, і сам штучний інтелект може бути нашим найпотужнішим інструментом для покращення роботи ШІ.

Даріо Амодей, Anthropic:

Коли штучний інтелект стає потужнішим, він краще виконує більшість когнітивних завдань. Одне пов’язане з цим когнітивне завдання полягає в тому, щоб оцінити безпеку систем штучного інтелекту та, зрештою, провести дослідження безпеки. У цьому є самопосилальний компонент. Ми можемо побачити це, читаючи всередині нейронних мереж, наприклад, сферу інтерпретації. Потужні системи ШІ можуть допомогти нам інтерпретувати активність нейронів у слабших системах ШІ. І ця інтерпретаційна інформація часто говорить нам, як працює модель. Коли вони розповідають нам, як працює модель, вони часто пропонують шляхи її вдосконалення або підвищення ефективності. Одним із найперспективніших напрямів дослідження є тонке налаштування великих моделей для конкретних випадків використання без запуску всієї моделі.

Алі Годсі, Databricks:

Якби ви створили тисячу версій LLM, які добре справлялися з тисячею різних речей, і вам довелося завантажити кожну з них на графічний процесор і обслуговувати його, це обійдеться дуже дорого. Найважливіше, що всі зараз шукають: чи існує техніка, яка може отримати дуже хороші результати лише з незначними модифікаціями? Існує багато технологій, таких як налаштування префіксів, LoRA, CUBE LoRA тощо. Але жодне справді бездоганне рішення не доведено. Але хтось знайде. ## 14 Як ми вимірюємо прогрес у розвитку загального штучного інтелекту?

Коли ми розширюємо ці моделі, як ми дізнаємося, коли штучний інтелект стане загальним штучним інтелектом? Коли ми часто чуємо термін AGI, це може бути важко визначити, можливо, частково через те, що його важко виміряти.

Кількісні тести, такі як GLUE і SUPERGLUE, давно використовуються як стандартизовані показники для вимірювання продуктивності моделі ШІ. Але, як і стандартизовані тести, які ми проводимо для людей, контрольні показники штучного інтелекту викликають запитання: якою мірою ви вимірюєте здатність LLM міркувати та якою мірою ви вимірюєте його здатність пройти тест?

Алі Годсі, Databricks:

Мені здається, що всі тести — дурниця. Уявіть собі, якби всі наші університети сказали: «Ми дамо вам відповіді, які ви можете переглянути ввечері перед іспитом. А наступного дня ми змусимо вас відповісти на запитання й поставити їм оцінку». , кожен міг легко склав іспит.

Наприклад, MMLU є еталоном, який багато людей використовують для оцінки цих моделей. MMLU – це лише запитання з кількома варіантами відповідей в Інтернеті. Задайте запитання, це відповідь A, B, C, D чи E? Тоді він підкаже вам правильну відповідь. Його можна навчати онлайн і створити модель LLM, здатну перемогти його. Початковим якісним тестом для AGI був тест Тюрінга, але переконати людей у тому, що ШІ є людиною, неважко. Змусити штучний інтелект робити те, що люди роблять у реальному світі, є складною проблемою. Отже, які тести ми можемо використовувати, щоб зрозуміти функціональність цих систем?

Ділан Філд, Figma:

Те, що ми зараз бачимо з цих систем, полягає в тому, що легко змусити людей повірити, що ти людина, але важко насправді робити хороші речі. Я можу попросити GPT-4 розробити бізнес-план і продати його вам, але це не означає, що ви будете інвестувати. Коли у вас фактично є два конкуруючих підприємства – одним керує штучний інтелект, а іншим керують люди – і ви вирішуєте інвестувати в бізнес штучного інтелекту, це мене хвилює. Девід Базукі, Roblox:

У мене є запитання тесту Тьюринга для штучного інтелекту: якщо ми помістимо штучний інтелект у 1633 рік і дамо йому потренуватися на всій інформації, доступній на той час, чи зможе він передбачити, чи буде Земля чи Сонце центром Сонячної системи – навіть хоча 99,9% інформації Скажіть, що Земля є центром Сонячної системи? Я думаю, що 5 років — це вже на межі, але якби ми провели цей тест AI Turing за 10 років, він, ймовірно, сказав би сонце. ## 15 Чи потрібно людям брати участь?

Нові технології часто замінюють деякі людські професії та робочі місця, але вони також відкривають абсолютно нові сфери, підвищують продуктивність і роблять більше типів робочих місць доступними для більшої кількості людей. Хоча легко уявити, що штучний інтелект автоматизує існуючі робочі місця, набагато важче уявити наступні проблеми та можливості, які принесе ШІ.

Мартін Касадо, a16z:

Простіше кажучи, парадокс Джевонса стверджує: якщо попит еластичний і ціна падає, попит перевищить компенсацію. Часто це набагато більше, ніж компенсується. Це безумовно стосується Інтернету. Ви отримуєте більшу цінність і більшу продуктивність. Я особисто вважаю, що попит еластичний, коли мова заходить про автоматизацію будь-якого творчого активу чи роботи. Чим більше ми робимо, тим більше люди споживають. Ми з нетерпінням чекаємо значного зростання продуктивності, безлічі нових робочих місць і багатьох нових речей, як ми бачили в еру мікрочіпів та Інтернету. Кевін Скотт, Microsoft:

Я виріс у сільській місцевості центральної Вірджинії, де економіка базувалася переважно на вирощуванні тютюну, виробництві меблів і текстильній промисловості. Коли я закінчив середню школу, усі три галузі просто зазнали краху. Коли люди в цих спільнотах мають доступ до неймовірно потужних інструментів, вони часто роблять надзвичайні речі, створюючи економічні можливості для себе, своїх сімей і громад. Вони вирішують проблеми, які ви чи я не можемо, тому що ми не бачимо всього світу проблем. Ми не маємо їхньої точки зору. Користуватися цими інструментами штучного інтелекту стало простіше, ніж будь-коли раніше. Ви можете робити цікаві речі за допомогою цих інструментів зараз і стати підприємцем у маленькому містечку Вірджинії, не маючи докторського ступеня з комп’ютерних наук або досвіду в класичному штучному інтелекті. Вам просто потрібно залишатися цікавими та підприємливими. Ділан Філд, Figma:

Якщо ви подивіться на кожну зміну технології чи платформи на сьогоднішній день, це призвело до появи нових речей для проектування. Є друкарський верстат, а потім треба придумати, що помістити на сторінку. Нещодавно з мобільним Інтернетом ви можете подумати: «Ну, стало менше пікселів, стало менше дизайнерів.» Але це не так, саме тоді ми спостерігали найбільший вибух у кількості дизайнерів. ## 16 Ніколи не було більш захоплюючого часу для створення стартапу зі штучним інтелектом (особливо якщо ви фізик або математик)

Це унікальний і захоплюючий час для створення штучного інтелекту: моделі, що лежать в основі, швидко масштабуються, економіка нарешті схиляється на користь стартапів, і є багато проблем, які потрібно вирішити. Для вирішення цих проблем потрібні велике терпіння та наполегливість, і досі фізики та математики особливо добре підходили для їх вирішення. Але як молода галузь, яка швидко розвивається, штучний інтелект широко відкритий, і зараз ідеальний час для його створення.

Даріо Амодей, Anthropic:

У будь-який момент існує два типи сфер. Одна з них – сфера, де досвід і накопичені знання дуже багаті, і для того, щоб стати експертом, потрібні багато років. Біологія є класичним прикладом: якщо ви працюєте в біології лише 6 місяців, дуже важко зробити новаторську роботу або роботу рівня Нобелівської премії... Інша сфера є дуже молодою або розвивається дуже швидко. Штучний інтелект був і певною мірою залишається однією з цих категорій. Справді талановиті спеціалісти широкого профілю часто можуть перевершити людей, які працюють у цій сфері протягом тривалого часу, тому що все змінюється дуже швидко. У будь-якому випадку наявність великої кількості попередніх знань може бути недоліком. Міра Мураті, OpenAI:

Один висновок із теоретичного простору математики полягає в тому, що вам потрібно довго розмірковувати над проблемами. Іноді ви засинаєте і прокидаєтеся з новими ідеями, поступово знаходячи своє остаточне рішення протягом днів або тижнів. Це не процес із швидким поверненням, а іноді це не повторювана річ. Це майже інший спосіб мислення, коли ви розвиваєте інтуїцію та дисципліну, щоб зіткнутися з проблемою та довіряти собі її вирішення. З часом ви розвинете інтуїцію щодо того, над якими проблемами справді варто працювати. Дафна Коллер, insitro:

З часом вдосконалюється не тільки машинне навчання, але й біологічні інструменти, на які ми покладаємося. У минулому не було технології CRISPR, тільки siRNA. Потім з’явилася технологія редагування генів CRISPR, а тепер є технологія CRISPR Prime, яка може замінити цілі геномні регіони. Як наслідок, інструменти, які ми створюємо, стають все кращими й кращими, відкриваючи нам можливість боротися з більшою кількістю захворювань більш значущими способами. Багато можливостей існує на перетині штучного інтелекту/машинного навчання з галузями біології та медицини. Ця конвергенція є моментом, який дозволяє нам зробити величезний вплив на світ, у якому ми живемо, використовуючи інструменти, які існують сьогодні, але не існували п’ять років тому. Кевін Скотт, Microsoft:

Якщо ви подумаєте про деякі великі зміни платформи, які відбулися в минулому, найціннішими речами на цих платформах були не речі, які були розгорнуті в перші два роки зміни платформи. Якщо ви думаєте про те, де ви проводите найбільше часу на своєму смартфоні, це не додаток для обміну повідомленнями, веб-браузер чи поштовий клієнт. Скоріше це щось нове, створене протягом кількох років після того, як платформа стала доступною.

Які речі, які раніше були неможливі, тепер можливі? Ось про що люди повинні думати. Не женіться за дрібницями.

Переглянути оригінал

Ця сторінка може містити контент третіх осіб, який надається виключно в інформаційних цілях (не в якості запевнень/гарантій) і не повинен розглядатися як схвалення його поглядів компанією Gate, а також як фінансова або професійна консультація. Див. Застереження для отримання детальної інформації.

a16z Стаття на 10 000 слів: Ми вступаємо в третю еру комп’ютерів

Ця хвиля розвитку штучного інтелекту настільки швидко поширила свій вплив на різні сфери, що справді перевершила очікування більшості людей. Минулого тижня Sequoia (Sequoia America) вважала, що штучний інтелект відкрив свою другу главу, і намалювала нову карту штучного інтелекту та карту стека (стека) для розробників LLM з точки зору сценаріїв застосування.

Однак, судячи з напрямків фінансування, нинішній розвиток штучного інтелекту все ще перебуває на стадії боротьби між богами, і ця модель майже сформувалася. Після того як OpenAI отримав майже 11 мільярдів доларів США від Microsoft та інших і був оцінений майже в 29 мільярдів доларів США, його конкурент Anthropic вчора оголосив про альянс з Amazon. Amazon інвестує в нього до 4 мільярдів доларів США, що зробить Anthropic другим після OpenAI. з точки зору фінансування стартапів ШІ.

Після цього фінансування, за винятком Apple, індустрія штучного інтелекту в основному сформувала таку схему боротьби богів:

Звичайно, як постачальника інфраструктури нижчого рівня, стратегія Nvidia полягає в тому, що, очевидно, всі хочуть цього, і немає дуже серйозної позиції щодо якоїсь конкретної компанії. Нижче наведено загальну ситуацію щодо 15 єдинорогів зі штучним інтелектом. З точки зору оцінки та фінансування, більшу частину складають великі моделі LLM, а 50% єдинорогів зі штучним інтелектом було створено після 2021 року:

Сьогодні a16z поділилися своїми розмовами із засновниками кількох провідних компаній штучного інтелекту, вважаючи, що ми перебуваємо в третій ері комп’ютерів, і обговорили 16 цікавих тем з точки зору сьогодення, майбутнього та відкритості штучного інтелекту. Серед учасників цієї розмови:

Оскільки стаття занадто довга, майже 10 000 слів, я використав штучний інтелект, щоб коротко зібрати її. Деякі терміни можуть бути неточними. Зацікавлені друзі можуть прочитати оригінальний текст англійською мовою:

1 Ми на початку третьої ери комп’ютерів

Мартін Касадо, a16z:

Я дійсно думаю, що ми вступаємо в третю еру комп’ютерів. Мікрочіпи знизили граничні витрати на обчислення до нуля, Інтернет знизив граничні витрати на розповсюдження до нуля, а тепер великі моделі фактично знизили граничні витрати на створення до нуля. Коли відбувалися попередні епохи, ви навіть не підозрювали, які нові компанії будуть створені. Ніхто не передбачив ні Amazon, ні Yahoo. Треба готуватися до нової хвилі знакових компаній. Ноам Шазір, AI персонажа:

Ми справді живемо в момент «першого літака братів Райт». У нас уже є те, що працює і тепер корисно для великої кількості прикладних сценаріїв. Схоже, він дуже добре масштабується і стане ще кращим. Але попереду ще більше проривів, тому що зараз усі вчені ШІ у світі наполегливо працюють, щоб покращити ці речі. Кевін Скотт, Microsoft:

Особливо за останні кілька років і, можливо, особливо за останні 12 місяців, із запуском ChatGPT і GPT-4, ви дійсно можете побачити потенціал цієї платформи, щоб бути таким же, як ПК або смартфон. Ряд технологій зробить можливим безліч нових речей, і багато людей створюватимуть щось на основі цих нових речей. ## 2 Ця хвиля генеративного штучного інтелекту має економічні принципи, які сприяють ринковій трансформації.

Щоб технологічні інновації спровокували ринкову трансформацію, економічні вигоди мають бути дуже привабливими. Хоча в попередніх циклах штучного інтелекту було досягнуто багато технологічних досягнень, їм бракувало трансформаційних економічних переваг. У поточній хвилі штучного інтелекту ми вже бачимо перші ознаки економічних покращень у 10 000 разів (або більше) у деяких випадках використання, і в результаті впровадження та розвиток штучного інтелекту, здається, відбувається набагато швидше, ніж будь-який попередній зсув.

Мартін Касадо, a16z:

Ринкова трансформація не відбувається через десятикратне економічне покращення. Вони створюються, коли стають у десять тисяч разів кращими, ніж раніше. Скажімо, я хочу створити зображення, яке перетворює мене на персонажа Pixar. Якщо я використовую одну з цих моделей зображення, вартість висновку становитиме десяту частину цента, і, скажімо, це займе 1 секунду. Якщо порівнювати з наймом художника-оформлювача, припустімо, що погодинна ставка становить 100 доларів. З точки зору вартості та часу, ви побачите величезну різницю на 4-5 порядків величини. Для економістів це той тип поворотного моменту, який вони шукають, коли фактично відбувається величезна дислокація ринку. Якщо вам потрібен приклад того, наскільки божевільним це може бути, я не бачу причин, чому ви не можете створити повну гру - 3D-моделі, персонажів, звуки, музику, історію тощо. Усі ці речі зараз роблять стартапи, і якщо порівняти вартість сотень мільйонів доларів і років із вартістю кількох доларів, ми маємо асиметрію в економіці на рівні Інтернету та мікрочіпів.

3 Для деяких ранніх сценаріїв застосування: Креативність > Правильність

Галюцинації є загальновідомою проблемою сучасних великих моделей LLM, але для деяких програм здатність вигадувати речі є скоріше функцією, ніж помилкою. Порівняно з ранніми сценаріями використання машинного навчання, де правильність n-рівня є критичною (наприклад, безпілотні автомобілі), багато ранніх варіантів використання LLM (віртуальні друзі та компаньйони, концепції мозкового штурму або створення онлайн-ігор) характеризуються: фокус У сферах, де креативність важливіша за правильність.

Ноам Шазір, Character.AI:

Розваги – це індустрія, яка щорічно обробляє 2 трильйони доларів. І темний секрет полягає в тому, що розваги схожі на ваших неіснуючих віртуальних друзів. Це чудовий перший приклад використання загального штучного інтелекту. Наприклад, якби ви хотіли запустити лікаря, це було б набагато повільніше, тому що вам потрібно бути дуже, дуже, дуже обережними, щоб не надати неправильну інформацію. Але з друзями ви можете зробити це дуже швидко, це просто весело, і вигадування стає особливістю. Девід Базукі, Roblox:

З 65 мільйонів користувачів Roblox більшість не творять на тому рівні, на якому хотіли б. Довгий час ми уявляли гру-симулятор Project Runway, у якій можна було б використовувати швейну машину та тканину та моделювати все це в 3D, але навіть це було дещо складним для більшості з нас. Я думаю, що тепер, коли Project Runway вийде на Roblox, це буде текстова підказка, підказка із зображенням або голосова підказка. Якби я допомагав тобі шити цю сорочку, я б сказав: я хочу блакитну джинсову сорочку, кілька ґудзиків і тонший крій. Фактично, я думаю, що ми побачимо прискорення творення. Ділан Філд, Figma:

Наразі ми знаходимося на етапі, коли штучний інтелект може завершити першу чернетку, але перейти від цього до кінцевого продукту все ще дещо складно, і для цього часто потрібна команда. Але якщо ви зможете змусити штучний інтелект пропонувати людям елементи інтерфейсу та робити це у спосіб, який дійсно має сенс, я думаю, що це відкриє цілу нову еру дизайну, створюючи контекстні дизайни, які реагують на наміри користувача. Я вважаю, що це буде захоплююча ера для всіх дизайнерів у співпраці з цими системами штучного інтелекту. ## 4 Для інших прикладів, точність програмування «другого пілота» покращиться з використанням людини.

Хоча штучний інтелект має потенціал для покращення роботи людини в багатьох сферах, програмування «других пілотів» стало першим широко поширеним помічником ШІ з кількох причин:

По-перше, розробники часто першими впроваджують нові технології — аналіз порад ChatGPT у травні/червні 2023 року показав, що 30% порад ChatGPT стосувалися програмування. По-друге, найбільші магістратури навчаються на масивних наборах даних (таких як Інтернет), що робить їх особливо вправними у відповідях на запити, пов’язані з програмуванням. Нарешті, люди в циклі - це користувачі. Отже, хоча точність важлива, розробник-людина з другим пілотом зі штучним інтелектом може перевірити правильність швидше, ніж розробник-людина поодинці.

Мартін Касадо, a16z:

Якщо вам потрібно зробити це правильно, і є багато складних випадків використання, виконайте всю технічну роботу самостійно або найміть людей. Зазвичай ми наймаємо людей. Це змінні витрати. По-друге, оскільки хвіст рішень часто дуже довгий, як-от численні аномалії, які можуть виникнути під час автономного водіння, інвестиції, необхідні для випередження, збільшуються, а вартість зменшується. Це створює ефект зворотної економії масштабу. Ця людина в циклі, яка раніше була в центральній компанії, тепер є користувачем, тому це більше не є змінними витратами для бізнесу та економічними витратами на роботу. Людину в циклі перемістили, тож ви можете робити те, де важлива правильність, наприклад, розробляти код, і оскільки це ітераційно, кількість накопичених помилок зменшено, оскільки ви постійно отримуєте відгуки та виправлення від користувачів. Коли розробники можуть запитувати чат-бота AI, щоб допомогти їм написати та усунути неполадки в коді, це змінює спосіб розробки двома суттєвими способами: 1) полегшує розробку для більшої кількості людей, співпрацює, оскільки це відбувається через інтерфейс природної мови, 2) люди-розробники виробляйте більше продуктів і зберігайте їх довше.

Міра Мураті, OpenAI:

Програмування стає все менш абстрактним. Ми фактично можемо розмовляти з комп’ютерами з високою пропускною здатністю природною мовою. Ми використовуємо цю технологію, і ця технологія допомагає нам зрозуміти, як із нею працювати, а не «програмувати». Кевін Скотт, Microsoft:

GitHub є першим прикладом цієї моделі другого пілота, яку ми намагаємося побудувати, а саме: як ви берете роботу зі знаннями, яку виконує хтось, і використовуєте штучний інтелект, щоб допомогти їм бути значно продуктивнішими у виконанні певних типів когнітивної роботи ? Найкраще те, що виходячи з того, що ми спостерігали з розробниками, штучний інтелект допомагає їм залишатися в стані потоку довше, ніж вони б це зробили в іншому випадку. Не застрягайте, коли пишете шматок коду й думаєте: «Я не знаю, як зробити наступне. Мені потрібно піти переглянути документацію. Мені потрібно запитати іншого інженера, який, можливо, працює над щось." "Можливість звільнитися від потоку, перш ніж вийти зі стану потоку, надзвичайно цінна. Для тих, хто розглядає корисність генеративних інструментів штучного інтелекту, створених для цілей, відмінних від розробки програмного забезпечення, цю концепцію станів потоку корисно розглянути. Ділан Філд, Figma:

Найкращі дизайнери починають більше думати про код, а найкращі розробники починають більше думати про дизайн. Крім дизайнерів і розробників, наприклад, якщо ви думаєте про людей, які працюють із продуктами, вони, можливо, раніше працювали над специфікаціями, але тепер вони більше працюють над макетами, щоб ефективніше доносити свої ідеї. По суті, це дозволить будь-кому в організації швидше переходити від ідеї до розробки та, можливо, навіть виробництва. Але все одно потрібно відточувати кожен крок. Вам потрібен хтось, про кого можна по-справжньому подумати: «Добре, які ідеї ми збираємося дослідити? від першого проекту до кінцевого продукту. ## 5 Поєднання штучного інтелекту та біології може прискорити нові способи лікування хвороб і мати глибокий вплив на здоров’я людини

Біологія неймовірно складна — можливо, навіть за межами здатності людського розуму повністю зрозуміти. Однак взаємодія штучного інтелекту та біології може прискорити наше розуміння біології та призвести до деяких із найбільш захоплюючих і трансформаційних технологічних досягнень нашого часу. Біологічні платформи, керовані штучним інтелектом, мають потенціал розкрити раніше невідомі біологічні ідеї, що призведе до нових медичних проривів, нових методів діагностики та здатності раніше виявляти та лікувати хвороби, потенційно навіть запобігаючи їм до того, як вони виникнуть.

Дафна Коллер, insitro:

У певні періоди нашої історії певні наукові дисципліни досягли неймовірних успіхів за відносно короткий проміжок часу. У 1950-х роках дисципліною були обчислення, і ми використовували ці машини для виконання обчислень, які до того часу могли виконувати лише люди. Потім у 1990-х роках відбулося таке цікаве розходження. З одного боку, наука про дані та статистика принесли нам сучасне машинне навчання та штучний інтелект. Інша сторона — це те, що я вважаю кількісною біологією, тобто ми вперше починаємо вимірювати біологію в масштабі, окрім відстеження 3 генів у експерименті, який тривав 5 років. Тепер, 2020 рік – останній раз, коли дві дисципліни по-справжньому об’єдналися, приносячи нам еру цифрової біології, можливості вимірювати біологію з безпрецедентною точністю та масштабом; інтерпретувати незрозуміле за допомогою машинного навчання та інструментів науки про дані Впевнено величезні обсяги даних, різних біологічні масштаби та різні системи, а потім використання таких інструментів, як редагування геному CRISPR, щоб повернути це розуміння в інженерну біологію, щоб ми могли змусити біологію робити те, для чого вона не призначена. Тепер ми нарешті можемо виміряти біологію в масштабі, на клітинному (і іноді субклітинному) та організмовому рівнях. Це дає нам змогу вперше розгорнути машинне навчання справді значущим чином. Ми побудували модель біологічної мови. Це як GPT, але для клітинок. У нас є мова клітин і те, як клітини виглядають. Ви вимірюєте сотні мільйонів клітин у різних станах, а потім, подібно до великої мовної моделі для природної мови, з невеликою кількістю даних ви можете почати запитувати: «Добре, як хвороба переміщує хвороботворний ген з одного «Яким чином лікування повертає вас із стану хвороби до стану здоров’я?» Це надзвичайно потужно. Як і в інших мовних моделях, чим більше даних ви подаєте, тим краще воно стає. ## 6 Передача моделі в руки користувачів допоможе нам відкрити нові сценарії застосування

У той час як попередні ітерації моделей штучного інтелекту мали на меті перевершити людей у певних завданнях, LLM на основі Transformer вирізняються загальними міркуваннями. Але те, що ми створили хорошу загальну модель, не означає, що ми зламали, як застосувати її до конкретного випадку використання. Подібно до того, як залучення людей до циклу у формі RLHF має вирішальне значення для покращення продуктивності сучасних моделей штучного інтелекту, отримання нових технологій у руках користувачів і розуміння того, як вони їх використовують, буде ключовим для визначення того, які програми створювати на основі цих основних моделі.топ.

Кевін Скотт, Microsoft:

Треба пам'ятати: модель - це не продукт. Як підприємець, ви розумієте: хто ваші користувачі? У чому їхня проблема? Чим ви можете їм допомогти? Потім визначте, чи справді штучний інтелект є корисною інфраструктурою для вирішення проблем користувачів – це постійне значення. Штучний інтелект схожий на нову, цікаву інфраструктуру, яка дозволяє вирішувати нові класи проблем або вирішувати старі класи проблем кращими способами. Міра Мураті, OpenAI:

Ми точно не знаємо, як виглядатиме майбутнє, тому ми намагаємося зробити ці інструменти та методи доступними для багатьох інших людей, щоб вони могли експериментувати, а ми могли бачити, що станеться. Це стратегія, яку ми використовуємо з самого початку. За тиждень до запуску ChatGPT ми хвилювалися, що він недостатньо хороший. Ми всі бачили, що відбувається: ми викладаємо це там, а потім люди кажуть нам, що це достатньо добре, щоб відкривати нові випадки використання, і ви бачите всі ці нові варіанти використання. ## 7 Пам'ять ваших друзів ШІ стане кращою

У той час як дані, обчислення та параметри моделі підтримують загальні міркування LLM, контекстні вікна підтримують їх короткочасну пам’ять. Контекстні вікна зазвичай вимірюються кількістю токенів, які вони можуть обробляти. Сьогодні більшість контекстних вікон мають приблизно 32 КБ, але з’являються більші контекстні вікна, а разом з ними з’являється можливість запускати більші документи з більшим контекстом через LLM.

Ноам Шазір, Character.AI :

Наразі моделі, які ми пропонуємо, використовують контекстні вікна з тисяч токенів, тобто ваші друзі на все життя пам’ятають, що сталося за останні півгодини. Якщо ви можете викинути багато інформації, все піде на краще. Він повинен мати можливість дізнатися про вас мільярд речей. Пропускна здатність HBM є. Даріо Амодей, Anthropic:

Єдине, що, на мою думку, все ще недооцінюється, це довший контекст і речі, які з ним пов’язані. Мені здається, у людей в голові виникає образ, що вони мають цього чат-бота. «Я поставив йому запитання, і він відповів на нього. Але ви можете завантажити юридичний договір і сказати: «Які п’ять найбільш незвичайних умов цього юридичного договору?» Або завантажте фінансовий звіт і скажіть: "Коротко про те, де знаходиться ця компанія. Що дивного порівняно з тим, що сказав цей аналітик два тижні тому? Усі ці знання маніпулюють величезними обсягами даних, які людям потрібно порахувати, і обробляють їх". години на читання. Я думаю, що це більш імовірно, ніж те, що роблять люди. Ми тільки починаємо". ## 8 Голосові чат-боти, боти та інші способи взаємодії зі штучним інтелектом є важливою областю досліджень

Сьогодні більшість людей взаємодіють зі штучним інтелектом у формі чат-ботів, але це тому, що чат-ботів часто легко створити, а не тому, що вони є найкращим інтерфейсом для будь-якого випадку використання.

Багато розробників зосереджені на розробці нових способів взаємодії користувачів із моделями ШІ за допомогою мультимодального ШІ. Користувачі зможуть взаємодіяти з мультимодальними моделями так само, як вони взаємодіють з рештою світу: за допомогою зображень, тексту, голосу та інших медіа. Ідучи далі: Embodied AI зосереджується на штучному інтелекті, який може взаємодіяти з фізичним світом, таким як безпілотні автомобілі.

Міра Мураті, OpenAI:

Я думаю, що сьогоднішня базова модель добре представляє світ у тексті. Ми додаємо інші модальності, наприклад зображення та відео, щоб ці моделі могли отримати більш повну картину світу, подібну до того, як ми розуміємо та спостерігаємо світ. Ноам Шазір, Character.AI :

Можливо, ви хочете почути голос, побачити обличчя або просто мати можливість спілкуватися з кількома людьми. Це як якщо б вас обрали президентом, ви отримали навушники та цілу команду друзів чи радників. Або як ви заходите у «веселий бар», і всі знають ваше ім’я та раді, що ви прийшли. Дафна Коллер, insitro:

Наступний можливий рубіж впливу штучного інтелекту – це коли штучний інтелект починає взаємодіяти з фізичним світом. Ми всі бачимо, як це важко. Ми всі бачили, як важко побудувати самокерований автомобіль порівняно зі створенням чат-бота, чи не так? Ми робимо великий прогрес у створенні чат-ботів, і безпілотні автомобілі досі блокують пожежні машини в Сан-Франциско. Важливо розуміти цю складність, але також і масштаб впливу ## 9 Чи будемо мати загальні моделі, купу спеціалізованих моделей чи поєднання обох?

Які варіанти використання найкраще підходять для більших базових моделей із «вищим інтелектом» чи менших спеціалізованих моделей і наборів даних? Подібно до дискусії «хмара» проти «крайньої» архітектури, яка тривала десять років тому, відповідь залежить від того, скільки ви готові платити, наскільки точним вам повинен бути результат і яку затримку ви можете витримати. Відповіді на ці запитання можуть змінюватися з часом, оскільки дослідники розробляють більш ефективні з обчислювальної точки зору методи для точного налаштування великих базових моделей для конкретних випадків використання.

У довгостроковій перспективі ми можемо надмірно змінювати моделі, які використовуються для яких варіантів використання, оскільки ми все ще перебуваємо на ранніх стадіях побудови інфраструктури та архітектури для підтримки майбутньої хвилі додатків ШІ.

Алі Годсі, Databricks:

Це трохи схоже на 2000 рік, Інтернет ось-ось домінуватиме над усім, і все, що має значення, це те, хто може створити найкращий маршрутизатор. Ринкова капіталізація Cisco досягла максимуму в 5 трильйонів доларів США в 2000 році, перевершивши на той час Microsoft. Отже, хто має найбільшу LLM (мовну модель)? Зрозуміло, що той, хто зможе створити найбільший і повністю його навчити, матиме контроль над усім ШІ та майбутніми людьми. Але, як і в Інтернеті, хтось інший придумає такі ідеї, як Uber і водіння таксі пізніше. Інші люди будуть думати: «Гей, я хочу подивитися, що роблять мої друзі на Facebook». Це можуть бути величезні можливості для бізнесу, і не тільки такі компанії, як OpenAI, Databricks або Anthropic, можуть створити модель. Домінуйте над усіма програмами сценарії. Щоб створити лікаря, якому довіряють, потрібно докласти багато зусиль. Даріо Амодей, Anthropic:

Найбільшим фактором є інвестування більше грошей. Найдорожчі моделі, що випускаються сьогодні, коштують близько 100 мільйонів доларів, плюс-мінус порядок величини. Наступного року ми можемо побачити моделі від багатьох гравців вартістю близько 1 мільярда доларів, а до 2025 року ми побачимо моделі на мільярди або навіть 10 мільярдів доларів. Ця 100-кратна різниця поєднується з тим, що самі обчислення H100s стають швидшими - особливо великий стрибок через зниження точності. Поєднайте всі ці фактори разом, і якщо закони масштабування й надалі будуть застосовуватися, можливостей буде значно більше. Міра Мураті, OpenAI:

Це залежить від того, що ви хочете зробити. Зрозуміло, що системи штучного інтелекту дедалі більше братимуть на себе нашу роботу. Що стосується платформи OpenAI, ви бачите, що навіть сьогодні ми надаємо багато моделей через API, від дуже маленьких до найсучасніших моделей. Не завжди потрібно використовувати найпотужнішу або найкомпетентнішу модель. Іноді їм просто потрібна модель, яка відповідає їх конкретному випадку використання та є економічно ефективнішою. Ми хочемо, щоб люди створювали нашу модель і давали їм інструменти, щоб полегшити цей процес. Ми хочемо надати їм все більше і більше доступу та контролю, щоб ви могли передавати власні дані та налаштовувати ці моделі. Вам дійсно потрібно зосередитися на речах, які виходять за рамки моделі та визначають продукт. Девід Базукі, Roblox:

У будь-якій компанії на кшталт Roblox є, ймовірно, 20 або 30 вертикальних додатків для кінцевих користувачів, які дуже налаштовані – фільтрація природної мови дуже відрізняється від генерування 3D – і для кінцевого користувача ми хочемо, щоб усі ці додатки запускалися. Коли ми знижуємося [стек], у такій компанії, як наша, може виникнути природне об’єднання 2-3 моделей більшого та товстішого типу. Ми дуже точно налаштували дисципліни, які хочемо навчати, і зробили багато висновків для цих дисциплін. ## 10 Коли штучний інтелект набуває достатнього поширення на підприємстві, що відбувається з цими наборами даних?

Вплив генеративного штучного інтелекту на підприємства все ще знаходиться в зародковому стані – частково тому, що підприємства зазвичай повільніше рухаються, а частково тому, що вони усвідомили цінність своїх власних наборів даних і не обов’язково хочуть передавати дані іншій компанії, Якою б потужною не була їхня модель. Більшість корпоративних випадків використання вимагають високого ступеня точності, і підприємства мають 3 варіанти вибору LLM: створити власний LLM, скористатися постачальником послуг LLM, щоб створити його для них, або точно налаштувати основну модель – створення власного LLM не є легко.

Алі Госді, Databricks:

Одна річ, яка відбувається в мізках генеральних директорів і рад директорів, полягає в тому, що вони усвідомлюють: можливо, я зможу перемогти своїх конкурентів. Можливо, це криптоніт, який вбиває ваших ворогів. У мене є дані для генеративного штучного інтелекту, тому вони думають: «Я повинен створити це сам». Я повинен володіти інтелектуальною власністю. Ви хочете створити свій власний LLM з нуля? Це не тривіально, все одно вимагає багато графічних процесорів, коштує багато грошей і залежить від вашого набору даних і сценарію використання. У нас є багато клієнтів, які хочуть дешевшу, меншу, спеціально виготовлену модель із дуже високою точністю та продуктивністю. Вони кажуть: "Привіт, це те, що я хочу зробити. Я хочу отримати хорошу класифікацію з цих зображень цього конкретного дефекту у виробничому процесі. "Тут важлива точність. Кожна унція точності, яку ви можете мені дати, має значення. Тут вам буде краще, якщо ви матимете хороший набір даних для навчання та зможете навчити меншу модель. Затримка буде швидшою, дешевшою, і так, ви точно зможете мати точність, яка перевершить справді великі моделі. Але модель, яку ви побудуєте, не розважатиме вас у вихідні та не допоможе вашим дітям робити уроки. ## 11 Закон масштабування приведе нас аж до AGI?

Наразі LLM дотримується закону масштабування: продуктивність моделі покращується, коли ви додаєте більше даних і обчислень, навіть якщо архітектура та алгоритми залишаються незмінними. Але як довго може тривати це правило? Чи триватиме це нескінченно довго, чи досягне своїх природних меж до того, як ми розробимо AGI?

Міра Мураті, OpenAI:

Немає доказів того, що ми не отримаємо кращі, потужніші моделі, оскільки ми продовжуємо розширювати доступ до даних і обчислень. Інше питання, чи приведе вас це до AGI. Можливо, на цьому шляху знадобляться деякі інші прориви та вдосконалення, але я думаю, що попереду ще довгий шлях щодо законів масштабування та справжнього отримання значних переваг від цих більших моделей. Даріо Амодей, Anthropic:

Навіть якщо тут не буде жодних алгоритмічних удосконалень і ми просто збільшимо масштаб до того рівня, який був досі, закон масштабування діятиме. Ноам Шазір, Character.AI:

Наша мета — бути компанією AGI та першочерговою компанією, яка займається продуктом, і це можна зробити, вибираючи правильні продукти, змушуючи нас робити те, що є узагальненим, роблячи моделі розумнішими, роблячи їх тим, чого хочуть люди, і доставляти послуги дешево та в масштабі. Закон масштабування заведе нас далеко. По суті, обчислення не такі вже й дорогі. Сьогодні експлуатаційні витрати становлять близько 10-18 доларів. Якщо ви можете робити ці речі ефективно, вартість буде набагато меншою за цінність вашого часу. Існує можливість масштабувати ці речі на порядки величини. ## 12 Які з’являються можливості?

Хоча деякі люди поспішають списувати з рахунків здатність створювати штучний інтелект, штучний інтелект вже набагато кращий за людей у виконанні певних завдань і буде продовжувати вдосконалюватися. Найкращі розробники змогли визначити найперспективніші нові можливості штучного інтелекту та створити моделі та компанії, які масштабують ці можливості до надійних можливостей. Вони визнають, що масштаб має тенденцію до підвищення надійності нових можливостей.

Міра Мураті, OpenAI:

Важливо звертати увагу на ці нові функції, навіть якщо вони дуже ненадійні. Особливо для людей, які сьогодні будують компанії, вам дійсно хочеться подумати: «Добре, що можливо сьогодні? Що ви бачите сьогодні?» Тому що дуже швидко ці моделі стануть надійними. Даріо Амодей, Anthropic:

Коли ми випустили GPT-2, найбільш вражаючим на той час було те, що: «Ви подаєте ці п’ять прикладів перекладу з англійської на французьку безпосередньо в мовну модель, а потім подаєте шосте англійське речення, і воно насправді буде перекладено французькою мовою. «Боже мій, він розуміє цей шаблон». Для нас це було божевіллям, хоча це був поганий переклад. Але наша думка така: «Дивіться, це лише початок дивовижної подорожі, тому що немає обмежень і вона може продовжувати масштабуватися.» Чому ті моделі, які ми бачили раніше, не можуть продовжувати існувати? Є стільки цілей для передбачення наступного слова, і є стільки всього, з чим ви можете їх випробувати, що це точно працює. А потім деякі люди подивилися на це і сказали: «Ви зробили дуже поганий інструмент перекладу роботів.» ## 13 Чи знизиться вартість обслуговування цих моделей?

Витрати на обчислення є одним із основних обмежень для масштабування цих моделей, а поточний дефіцит чіпів підвищує витрати через обмеження пропозиції. Однак, якщо наступного року Nvidia випустить більше H100, це має зменшити дефіцит GPU та потенційно знизити витрати на обчислення.

Ноам Шазір, Character.AI:

Минулого року на навчання моделі, яку ми зараз пропонуємо, було витрачено приблизно 2 мільйони доларів на обчислювальні цикли, і ми, ймовірно, збираємося зробити це знову за півмільйона доларів. Тож до кінця року ми збираємося розгорнути десятки балів IQ розумніших речей. Я бачу, що ці речі масово збільшуються. Тільки не так дорого. Здається, я вчора бачив статтю про те, що наступного року Nvidia збирається зробити ще один 1,5M H100, який буде 2M H100. Це приблизно чверть трильйона операцій за секунду на людину. Це означає, що для кожної людини на планеті, на моделі зі 100 мільярдами параметрів, вона може обробляти 1 слово в секунду. Але не всі насправді мають доступ до нього, тому це не так вже й дорого. Ця річ дуже масштабована, якщо ви робите це правильно, і ми наполегливо працюємо, щоб це сталося. Даріо Амодей, Anthropic:

Моя основна думка полягає в тому, що висновок не коштуватиме так дорого. Основна логіка закону Скейлінга полягає в тому, що якщо ви збільшуєте обчислення на коефіцієнт n, вам потрібно збільшити дані на коефіцієнт квадратного кореня з n, а розмір моделі – на коефіцієнт квадратний корінь з n. Цей квадратний корінь в основному означає, що сама модель не збільшиться, а апаратне забезпечення працюватиме швидше, коли ви це робите. Я думаю, що ці речі залишаться актуальними протягом наступних 3-4 років. Без архітектурних інновацій вони стають трохи дорожчими. Якщо будуть архітектурні інновації, а я сподіваюся, вони будуть дешевшими. Але навіть якщо витрати на обчислення залишаться незмінними, підвищення ефективності на рівні моделі здається неминучим, особливо з огляду на те, що в цю сферу вливається стільки талантів, і сам штучний інтелект може бути нашим найпотужнішим інструментом для покращення роботи ШІ.

Даріо Амодей, Anthropic:

Коли штучний інтелект стає потужнішим, він краще виконує більшість когнітивних завдань. Одне пов’язане з цим когнітивне завдання полягає в тому, щоб оцінити безпеку систем штучного інтелекту та, зрештою, провести дослідження безпеки. У цьому є самопосилальний компонент. Ми можемо побачити це, читаючи всередині нейронних мереж, наприклад, сферу інтерпретації. Потужні системи ШІ можуть допомогти нам інтерпретувати активність нейронів у слабших системах ШІ. І ця інтерпретаційна інформація часто говорить нам, як працює модель. Коли вони розповідають нам, як працює модель, вони часто пропонують шляхи її вдосконалення або підвищення ефективності. Одним із найперспективніших напрямів дослідження є тонке налаштування великих моделей для конкретних випадків використання без запуску всієї моделі.

Алі Годсі, Databricks:

Якби ви створили тисячу версій LLM, які добре справлялися з тисячею різних речей, і вам довелося завантажити кожну з них на графічний процесор і обслуговувати його, це обійдеться дуже дорого. Найважливіше, що всі зараз шукають: чи існує техніка, яка може отримати дуже хороші результати лише з незначними модифікаціями? Існує багато технологій, таких як налаштування префіксів, LoRA, CUBE LoRA тощо. Але жодне справді бездоганне рішення не доведено. Але хтось знайде. ## 14 Як ми вимірюємо прогрес у розвитку загального штучного інтелекту?

Коли ми розширюємо ці моделі, як ми дізнаємося, коли штучний інтелект стане загальним штучним інтелектом? Коли ми часто чуємо термін AGI, це може бути важко визначити, можливо, частково через те, що його важко виміряти.

Кількісні тести, такі як GLUE і SUPERGLUE, давно використовуються як стандартизовані показники для вимірювання продуктивності моделі ШІ. Але, як і стандартизовані тести, які ми проводимо для людей, контрольні показники штучного інтелекту викликають запитання: якою мірою ви вимірюєте здатність LLM міркувати та якою мірою ви вимірюєте його здатність пройти тест?

Алі Годсі, Databricks:

Мені здається, що всі тести — дурниця. Уявіть собі, якби всі наші університети сказали: «Ми дамо вам відповіді, які ви можете переглянути ввечері перед іспитом. А наступного дня ми змусимо вас відповісти на запитання й поставити їм оцінку». , кожен міг легко склав іспит. Наприклад, MMLU є еталоном, який багато людей використовують для оцінки цих моделей. MMLU – це лише запитання з кількома варіантами відповідей в Інтернеті. Задайте запитання, це відповідь A, B, C, D чи E? Тоді він підкаже вам правильну відповідь. Його можна навчати онлайн і створити модель LLM, здатну перемогти його. Початковим якісним тестом для AGI був тест Тюрінга, але переконати людей у тому, що ШІ є людиною, неважко. Змусити штучний інтелект робити те, що люди роблять у реальному світі, є складною проблемою. Отже, які тести ми можемо використовувати, щоб зрозуміти функціональність цих систем?

Ділан Філд, Figma:

Те, що ми зараз бачимо з цих систем, полягає в тому, що легко змусити людей повірити, що ти людина, але важко насправді робити хороші речі. Я можу попросити GPT-4 розробити бізнес-план і продати його вам, але це не означає, що ви будете інвестувати. Коли у вас фактично є два конкуруючих підприємства – одним керує штучний інтелект, а іншим керують люди – і ви вирішуєте інвестувати в бізнес штучного інтелекту, це мене хвилює. Девід Базукі, Roblox:

У мене є запитання тесту Тьюринга для штучного інтелекту: якщо ми помістимо штучний інтелект у 1633 рік і дамо йому потренуватися на всій інформації, доступній на той час, чи зможе він передбачити, чи буде Земля чи Сонце центром Сонячної системи – навіть хоча 99,9% інформації Скажіть, що Земля є центром Сонячної системи? Я думаю, що 5 років — це вже на межі, але якби ми провели цей тест AI Turing за 10 років, він, ймовірно, сказав би сонце. ## 15 Чи потрібно людям брати участь?

Нові технології часто замінюють деякі людські професії та робочі місця, але вони також відкривають абсолютно нові сфери, підвищують продуктивність і роблять більше типів робочих місць доступними для більшої кількості людей. Хоча легко уявити, що штучний інтелект автоматизує існуючі робочі місця, набагато важче уявити наступні проблеми та можливості, які принесе ШІ.

Мартін Касадо, a16z:

Простіше кажучи, парадокс Джевонса стверджує: якщо попит еластичний і ціна падає, попит перевищить компенсацію. Часто це набагато більше, ніж компенсується. Це безумовно стосується Інтернету. Ви отримуєте більшу цінність і більшу продуктивність. Я особисто вважаю, що попит еластичний, коли мова заходить про автоматизацію будь-якого творчого активу чи роботи. Чим більше ми робимо, тим більше люди споживають. Ми з нетерпінням чекаємо значного зростання продуктивності, безлічі нових робочих місць і багатьох нових речей, як ми бачили в еру мікрочіпів та Інтернету. Кевін Скотт, Microsoft:

Я виріс у сільській місцевості центральної Вірджинії, де економіка базувалася переважно на вирощуванні тютюну, виробництві меблів і текстильній промисловості. Коли я закінчив середню школу, усі три галузі просто зазнали краху. Коли люди в цих спільнотах мають доступ до неймовірно потужних інструментів, вони часто роблять надзвичайні речі, створюючи економічні можливості для себе, своїх сімей і громад. Вони вирішують проблеми, які ви чи я не можемо, тому що ми не бачимо всього світу проблем. Ми не маємо їхньої точки зору. Користуватися цими інструментами штучного інтелекту стало простіше, ніж будь-коли раніше. Ви можете робити цікаві речі за допомогою цих інструментів зараз і стати підприємцем у маленькому містечку Вірджинії, не маючи докторського ступеня з комп’ютерних наук або досвіду в класичному штучному інтелекті. Вам просто потрібно залишатися цікавими та підприємливими. Ділан Філд, Figma:

Якщо ви подивіться на кожну зміну технології чи платформи на сьогоднішній день, це призвело до появи нових речей для проектування. Є друкарський верстат, а потім треба придумати, що помістити на сторінку. Нещодавно з мобільним Інтернетом ви можете подумати: «Ну, стало менше пікселів, стало менше дизайнерів.» Але це не так, саме тоді ми спостерігали найбільший вибух у кількості дизайнерів. ## 16 Ніколи не було більш захоплюючого часу для створення стартапу зі штучним інтелектом (особливо якщо ви фізик або математик)

Це унікальний і захоплюючий час для створення штучного інтелекту: моделі, що лежать в основі, швидко масштабуються, економіка нарешті схиляється на користь стартапів, і є багато проблем, які потрібно вирішити. Для вирішення цих проблем потрібні велике терпіння та наполегливість, і досі фізики та математики особливо добре підходили для їх вирішення. Але як молода галузь, яка швидко розвивається, штучний інтелект широко відкритий, і зараз ідеальний час для його створення.

Даріо Амодей, Anthropic:

У будь-який момент існує два типи сфер. Одна з них – сфера, де досвід і накопичені знання дуже багаті, і для того, щоб стати експертом, потрібні багато років. Біологія є класичним прикладом: якщо ви працюєте в біології лише 6 місяців, дуже важко зробити новаторську роботу або роботу рівня Нобелівської премії... Інша сфера є дуже молодою або розвивається дуже швидко. Штучний інтелект був і певною мірою залишається однією з цих категорій. Справді талановиті спеціалісти широкого профілю часто можуть перевершити людей, які працюють у цій сфері протягом тривалого часу, тому що все змінюється дуже швидко. У будь-якому випадку наявність великої кількості попередніх знань може бути недоліком. Міра Мураті, OpenAI:

Один висновок із теоретичного простору математики полягає в тому, що вам потрібно довго розмірковувати над проблемами. Іноді ви засинаєте і прокидаєтеся з новими ідеями, поступово знаходячи своє остаточне рішення протягом днів або тижнів. Це не процес із швидким поверненням, а іноді це не повторювана річ. Це майже інший спосіб мислення, коли ви розвиваєте інтуїцію та дисципліну, щоб зіткнутися з проблемою та довіряти собі її вирішення. З часом ви розвинете інтуїцію щодо того, над якими проблемами справді варто працювати. Дафна Коллер, insitro:

З часом вдосконалюється не тільки машинне навчання, але й біологічні інструменти, на які ми покладаємося. У минулому не було технології CRISPR, тільки siRNA. Потім з’явилася технологія редагування генів CRISPR, а тепер є технологія CRISPR Prime, яка може замінити цілі геномні регіони. Як наслідок, інструменти, які ми створюємо, стають все кращими й кращими, відкриваючи нам можливість боротися з більшою кількістю захворювань більш значущими способами. Багато можливостей існує на перетині штучного інтелекту/машинного навчання з галузями біології та медицини. Ця конвергенція є моментом, який дозволяє нам зробити величезний вплив на світ, у якому ми живемо, використовуючи інструменти, які існують сьогодні, але не існували п’ять років тому. Кевін Скотт, Microsoft:

Якщо ви подумаєте про деякі великі зміни платформи, які відбулися в минулому, найціннішими речами на цих платформах були не речі, які були розгорнуті в перші два роки зміни платформи. Якщо ви думаєте про те, де ви проводите найбільше часу на своєму смартфоні, це не додаток для обміну повідомленнями, веб-браузер чи поштовий клієнт. Скоріше це щось нове, створене протягом кількох років після того, як платформа стала доступною. Які речі, які раніше були неможливі, тепер можливі? Ось про що люди повинні думати. Не женіться за дрібницями.