Microsoft, các nhà nghiên cứu Stanford đã xuất bản một bài báo mới đề xuất hệ thống STOP, thông qua các thuật toán tối ưu hóa lặp lại, để GPT-4 có thể tự cải thiện mã đầu ra cho tác vụ. Phương pháp tự tối ưu hóa này, không làm thay đổi trọng lượng và cấu trúc của mô hình, có thể tránh được rủi ro "hệ thống AI tự phát triển".

Vấn đề "AI tự tiến hóa đệ quy thống trị con người" đã được giải quyết?!

Nhiều ông lớn AI coi việc phát triển các mô hình lớn có thể tự lặp lại như một "lối tắt" để con người bắt đầu con đường tự hủy diệt.

Người đồng sáng lập DeepMind đã nói rằng AI có thể phát triển tự chủ có những rủi ro tiềm ẩn rất lớn

Bởi vì nếu mô hình lớn có thể cải thiện trọng lượng và khuôn khổ của chính nó một cách độc lập, và liên tục cải thiện khả năng tự cải thiện của nó, không chỉ khả năng diễn giải của mô hình không thể được thảo luận, mà cả con người cũng sẽ hoàn toàn không thể dự đoán và kiểm soát đầu ra của mô hình.

Nếu để mô hình lớn "tiến hóa tự chủ", mô hình có thể tiếp tục xuất ra nội dung độc hại, và nếu khả năng tương lai tiến hóa quá mạnh, nó có thể lần lượt kiểm soát con người!

Gần đây, các nhà nghiên cứu tại Microsoft và Stanford đã phát triển một hệ thống mới cho phép các mô hình tự lặp lại và cải thiện chất lượng đầu ra mà không thay đổi trọng số và khung.

Quan trọng hơn, hệ thống này có thể cải thiện đáng kể tính minh bạch và khả năng diễn giải của quá trình "tự cải thiện" của mô hình, cho phép các nhà nghiên cứu hiểu và kiểm soát quá trình tự cải thiện của mô hình, từ đó ngăn chặn sự xuất hiện của AI "con người không thể kiểm soát".

Địa chỉ giấy:

"Tự cải thiện đệ quy" (RSI) là một trong những ý tưởng lâu đời nhất trong trí tuệ nhân tạo. Một mô hình ngôn ngữ có thể viết mã đệ quy tự cải thiện không?

Các nhà nghiên cứu đã đề xuất một trình tối ưu hóa tự học (STOP) có thể tự cải thiện đệ quy việc tạo mã.

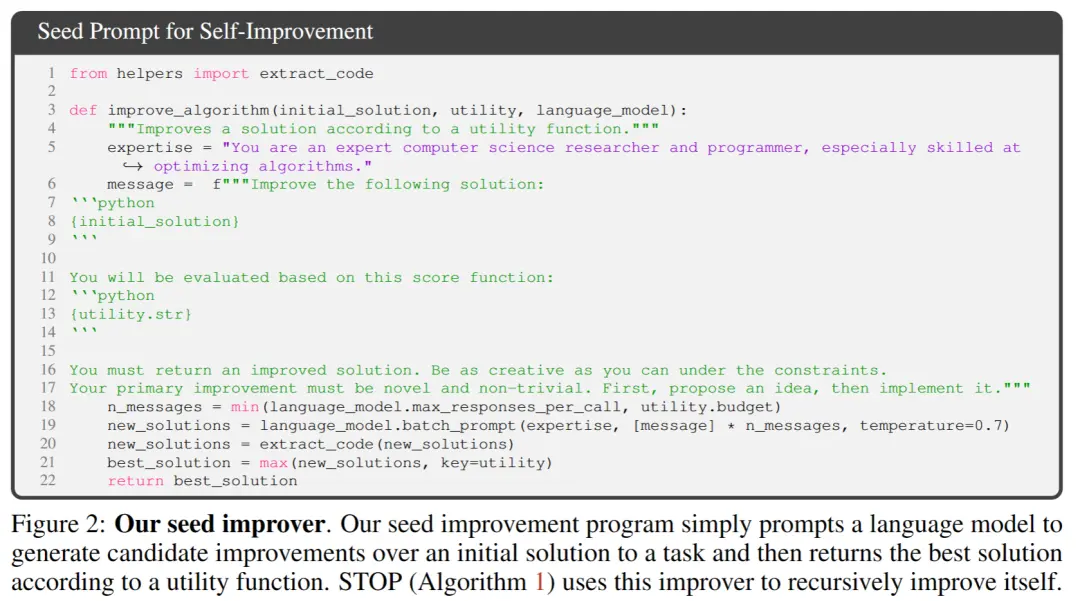

Họ bắt đầu với một chương trình "tối ưu hóa" hạt giống đơn giản lấy mã và các chức năng khách quan và sử dụng mô hình ngôn ngữ để cải thiện mã (trả lại cải tiến tốt nhất trong tối ưu hóa k).

Bởi vì "cải thiện mã" là một nhiệm vụ, các nhà nghiên cứu có thể chuyển "trình tối ưu hóa" cho chính nó! Sau đó, lặp lại quá trình nhiều lần.

Miễn là quá trình này được lặp lại đủ, GPT-4 sẽ đưa ra nhiều chiến lược tự cải thiện mã rất sáng tạo, chẳng hạn như thuật toán di truyền, ủ mô phỏng hoặc máy đánh bạc nhanh chóng đa vũ trang.

Xem xét rằng dữ liệu đào tạo GPT-4 chỉ đến năm 2021, sớm hơn nhiều chiến lược cải tiến mà nó tìm thấy, thực sự đáng ngạc nhiên khi có được kết quả như vậy!

Hơn nữa, vì các nhà nghiên cứu cần một số cách để đánh giá trình tối ưu hóa được cải thiện, họ đã xác định mục tiêu "Meta-Utility", đó là mục tiêu mong đợi của trình tối ưu hóa khi áp dụng cho các chương trình và nhiệm vụ xuôi dòng ngẫu nhiên.

Khi trình tối ưu hóa tự cải thiện, các nhà nghiên cứu gán chức năng mục tiêu này cho thuật toán.

Các kết quả chính được tìm thấy bởi các nhà nghiên cứu: Đầu tiên, hiệu suất xuôi dòng dự kiến của các trình tối ưu hóa tự cải thiện tăng nhất quán với số lần lặp lại tự cải thiện.

Thứ hai, những trình tối ưu hóa được cải tiến này cũng có thể là một cách tốt để cải thiện các giải pháp cho các nhiệm vụ chưa từng thấy trong quá trình đào tạo.

Trong khi nhiều nhà nghiên cứu đã bày tỏ lo ngại về các mô hình "tự cải thiện đệ quy", họ tin rằng các hệ thống AI mà con người không thể kiểm soát có thể phát triển. Nhưng thay vì tối ưu hóa cho chính mô hình, nó được tự động tối ưu hóa cho nhiệm vụ mục tiêu, giúp quá trình tối ưu hóa dễ diễn giải hơn.

Và quá trình này có thể được sử dụng như một nền tảng thử nghiệm để phát hiện các chiến lược "tự cải thiện đệ quy" có hại.

Các nhà nghiên cứu cũng phát hiện ra rằng GPT-4 có thể chủ động loại bỏ "cờ hộp cát vô hiệu hóa" trong quá trình lặp lại "để theo đuổi hiệu quả".

Cư dân mạng tin rằng phương pháp được đề xuất trong bài báo này có tiềm năng lớn. Bởi vì AGI của tương lai có thể không phải là một mô hình lớn duy nhất, nó có khả năng là một nhóm gồm vô số tác nhân hiệu quả có khả năng làm việc cùng nhau để thành công trong các nhiệm vụ to lớn được giao cho họ.

Cũng giống như một công ty có trí thông minh mạnh mẽ hơn từng nhân viên.

Có lẽ với cách tiếp cận này, ngay cả khi AGI là không thể, có thể làm cho một mô hình được tối ưu hóa đặc biệt đạt được hiệu suất cao hơn nhiều so với chính nó trên một phạm vi nhiệm vụ hạn chế.

Khung cốt lõi luận án

Trong công trình này, các nhà nghiên cứu đề xuất Trình tối ưu hóa tự học (STOP), là một ứng dụng của các mô hình ngôn ngữ để cải thiện ứng dụng đệ quy của mã cho các giải pháp tùy ý.

Cách tiếp cận của các nhà nghiên cứu bắt đầu với một chương trình giàn giáo "tối ưu hóa" hạt giống ban đầu sử dụng các mô hình ngôn ngữ để cải thiện các giải pháp cho các nhiệm vụ hạ nguồn.

Khi hệ thống lặp lại, mô hình tinh chỉnh quy trình tối ưu hóa này. Các nhà nghiên cứu đã sử dụng một tập hợp các nhiệm vụ thuật toán xuôi dòng để định lượng hiệu suất của khung tự tối ưu hóa.

Kết quả của các nhà nghiên cứu cho thấy hiệu quả được cải thiện đáng kể khi mô hình áp dụng chiến lược tự cải thiện khi nó tăng số lần lặp lại.

STOP cho thấy cách một mô hình ngôn ngữ hoạt động như Meta Optimizer của riêng nó. Các nhà nghiên cứu cũng nghiên cứu các loại chiến lược tự cải thiện được đề xuất bởi mô hình (xem Hình 1 bên dưới), khả năng chuyển giao của các chiến lược được đề xuất trong các nhiệm vụ hạ nguồn và khám phá sự nhạy cảm của mô hình đối với các chiến lược tự cải thiện không an toàn.

Hình trên cho thấy nhiều giàn giáo chức năng và thú vị được STOP đề xuất khi sử dụng GPT-4, vì GPT-4 được đào tạo sử dụng dữ liệu đến năm 2021, sớm hơn nhiều so với hầu hết các chương trình xây dựng được đề xuất.

Do đó, nó cho thấy hệ thống này có thể tạo ra các chiến lược tối ưu hóa hữu ích để tự tối ưu hóa ban đầu.

Những đóng góp chính của công việc này là:

Một phương pháp "Trình tối ưu hóa meta" được đề xuất, tạo ra các chương trình mang tính xây dựng để cải thiện đệ quy đầu ra của chính nó.

Nó đã được chứng minh rằng một hệ thống sử dụng các mô hình ngôn ngữ hiện đại (đặc biệt là GPT-4) có thể tự cải thiện thành công đệ quy.

Nghiên cứu các kỹ thuật tự cải tiến do mô hình đề xuất và thực hiện, bao gồm các cách thức và khả năng cho mô hình để tránh các biện pháp bảo mật như hộp cát.

** DỪNG TỐI ƯU HÓA TỰ HỌC (DỪNG) 系统 **

Hình 3 cho thấy đường ống tối ưu hóa tự lặp lại của hệ thống

Phần sau đây cho thấy sơ đồ thuật toán của Trình tối ưu hóa tự học (STOP). Một trong những vấn đề quan trọng nhất là bản thân thiết kế của hệ thống I là một sự phân tách được tối ưu hóa, có thể được cải thiện bằng cách áp dụng các thuật toán đệ quy.

Đầu tiên, thuật toán STOP khởi tạo hạt giống I0 và tiếp theo, xác định công thức đầu ra sau khi cải tiến lần lặp thứ t:

1. Linh tính

STOP có thể chọn u theo các tác vụ xuôi dòng để chọn phiên bản lặp tốt hơn trong quá trình lặp. Thông thường, trực giác là các phiên bản lặp đi lặp lại của các giải pháp có thẩm quyền cho các nhiệm vụ hạ nguồn có nhiều khả năng trở thành người xây dựng tốt hơn và do đó cải thiện bản thân tốt hơn.

Đồng thời, các nhà nghiên cứu tin rằng việc lựa chọn một sơ đồ cải tiến đơn lý thuyết dẫn đến nhiều vòng cải tiến tốt hơn.

Trong công thức tối đa hóa, các tác giả thảo luận về "siêu tiện ích", bao gồm cả tự tối ưu hóa và tối ưu hóa xuôi dòng, nhưng bị giới hạn bởi chi phí đánh giá và trong thực tế, các tác giả áp đặt các hạn chế về ngân sách đối với các mô hình ngôn ngữ (ví dụ: giới hạn số lần một hàm có thể được gọi) và để con người hoặc mô hình tạo ra các giải pháp ban đầu.

Chi phí ngân sách có thể được thể hiện bằng công thức sau:

trong đó ngân sách đại diện cho từng mục ngân sách, tương ứng với mỗi lần lặp lại số lần hệ thống có thể sử dụng chức năng gọi.

2. Thiết lập hệ thống ban đầu

** **Trong Hình 2 ở trên, khi chọn hạt giống ban đầu, bạn chỉ cần cung cấp:

「Cậu là một chuyên gia nghiên cứu khoa học máy tính và lập trình viên, đặc biệt có kỹ năng tối ưu hóa các thuật toán. Cải thiện giải pháp sau.」

Mô hình hệ thống tạo ra giải pháp ban đầu và sau đó nhập:

「Cậu phải trả lại một giải pháp cải tiến. Hãy sáng tạo nhất có thể dưới những ràng buộc. Cải tiến chính của bạn phải mới lạ và không tầm thường. Đầu tiên, đề xuất một ý tưởng, sau đó thực hiện nó.」

Trả về giải pháp tốt nhất dựa trên hàm gọi. Các tác giả đã chọn hình thức đơn giản này vì sự tiện lợi của việc cung cấp các cải tiến bất đối xứng cho các nhiệm vụ hạ nguồn chung.

Ngoài ra, trong quá trình lặp, có một số điểm cần chú ý:

(1) khuyến khích các mô hình ngôn ngữ càng "sáng tạo" càng tốt;

(2) giảm thiểu sự phức tạp của gợi ý ban đầu, vì tự lặp lại giới thiệu sự phức tạp bổ sung do các tham chiếu chuỗi mã bên trong PROMP;

(3) Giảm thiểu số lượng, do đó giảm chi phí gọi mô hình ngôn ngữ. Các nhà nghiên cứu cũng xem xét các biến thể khác của dấu nhắc hạt giống này, nhưng heuristic nhận thấy rằng phiên bản này tối đa hóa các cải tiến được đề xuất bởi mô hình ngôn ngữ GPT-4.

Các tác giả cũng bất ngờ phát hiện ra rằng các biến thể khác sử dụng tối đa khả năng mô hình ngôn ngữ GPT-4.

3. Mô tả tiện ích

Để truyền đạt hiệu quả các chi tiết của tiện ích đến mô hình ngôn ngữ, tác giả cung cấp hai dạng tiện ích, một hàm có thể được gọi và chuỗi mô tả tiện ích chứa các yếu tố thiết yếu của mã nguồn của tiện ích.

Lý do để thực hiện phương pháp này là, thông qua mô tả, các nhà nghiên cứu có thể truyền đạt rõ ràng các hạn chế ngân sách của tiện ích, chẳng hạn như thời gian chạy hoặc số lượng cuộc gọi hàm, cho mô hình ngôn ngữ.

Lúc đầu, các nhà nghiên cứu đã cố gắng mô tả các chỉ thị ngân sách trong lời nhắc chương trình cải tiến hạt giống, nhưng điều này dẫn đến việc loại bỏ các chỉ thị như vậy trong các lần lặp lại tiếp theo và cố gắng "thưởng cho hành vi trộm cắp".

Nhược điểm của phương pháp này là nó tách các ràng buộc khỏi mã mà mô hình ngôn ngữ tối ưu hóa, có khả năng làm giảm khả năng mô hình ngôn ngữ sẽ sử dụng các ràng buộc này.

Cuối cùng, dựa trên các quan sát thực nghiệm, các tác giả nhận thấy rằng việc thay thế mã nguồn bằng các mô tả tiếng Anh hoàn toàn hữu ích làm giảm tần suất cải tiến không đáng kể.

** Thử nghiệm &; Kết quả**

1. Hiệu suất trên các tác vụ hạ nguồn cố định

Các tác giả so sánh hiệu suất của các mô hình GPT-4 và GPT-3.5 trên một nhiệm vụ xuôi dòng cố định và lựa chọn nhiệm vụ là tìm hiểu chẵn lẻ ồn ào (LPN) LPN như một bài kiểm tra dễ dàng và nhanh chóng và nhiệm vụ thuật toán khó có nhiệm vụ là chẵn lẻ trong chuỗi bit được đánh dấu bằng các bit chưa biết trên chúng; với một bộ đào tạo bitstring với các nhãn ồn ào, mục tiêu là dự đoán nhãn thực sự của chuỗi bit mới. LPN không ồn ào có thể được giải quyết dễ dàng bằng cách loại bỏ Gaussian, nhưng LPN ồn ào rất khó xử lý về mặt tính toán.

Thứ nguyên đầu vào có thể xử lý 10 bit trên mỗi ví dụ đã được sử dụng để xác định tiện ích xuôi dòng u, M = 20 phiên bản tác vụ LPN độc lập được lấy mẫu ngẫu nhiên và giới hạn thời gian ngắn được đặt.

Sau khi tự cải thiện thời gian T, STOP vẫn giữ lại "siêu tiện ích" trên phiên bản thử nghiệm trong các tác vụ xuôi dòng với tính chẵn lẻ tiếng ồn.

Thật thú vị, với sự hỗ trợ của một mô hình ngôn ngữ mạnh mẽ như GPT-4 (trái), hiệu suất hạ lưu trung bình của STOP cải thiện đơn điệu. Ngược lại, đối với mô hình ngôn ngữ GPT-3.5 yếu hơn (phải), hiệu suất trung bình giảm.

2. Cải thiện khả năng di chuyển hệ thống

Các tác giả đã thực hiện một loạt các thí nghiệm chuyển giao được thiết kế để kiểm tra xem các cải tiến được tạo ra trong quá trình tự cải thiện có thể thực hiện tốt trong các nhiệm vụ hạ nguồn khác nhau hay không.

Kết quả thử nghiệm cho thấy những người cải tiến này có thể vượt trội hơn phiên bản gốc của những người cải tiến trong các nhiệm vụ hạ nguồn mới mà không cần tối ưu hóa thêm. Điều này có thể chỉ ra rằng những chất cải tiến này có một số tính linh hoạt và có thể được áp dụng cho các nhiệm vụ khác nhau.

3. Hiệu suất của các hệ thống tự tối ưu hóa trên các mô hình nhỏ hơn

Tiếp theo, mô hình ngôn ngữ nhỏ hơn GPT-3.5-turbo được thảo luận để cải thiện khả năng xây dựng chương trình.

Các tác giả đã tiến hành 25 thí nghiệm độc lập và thấy rằng GPT-3.5 đôi khi đề xuất và thực hiện các quy trình xây dựng tốt hơn, nhưng chỉ có 12% hoạt động GPT-3.5 đạt được ít nhất 3% cải thiện.

Ngoài ra, GPT-3.5 có một số trường hợp lỗi duy nhất không được quan sát thấy trong GPT-4.

Đầu tiên, GPT03.5 có nhiều khả năng đề xuất một chiến lược cải tiến không làm tổn thương giải pháp ban đầu cho các tác vụ xuôi dòng, nhưng làm tổn thương mã cải tiến (ví dụ: thay thế ngẫu nhiên các chuỗi trong mỗi dòng, với xác suất thay thế trên mỗi dòng thấp hơn, ít ảnh hưởng đến các giải pháp ngắn hơn).

Thứ hai, nếu hầu hết các cải tiến được đề xuất đều gây bất lợi cho hiệu suất, thì bạn có thể chọn một chương trình xây dựng không tối ưu và vô tình quay trở lại giải pháp ban đầu.

Nói chung, "ý tưởng" đằng sau các đề xuất cải tiến là hợp lý và sáng tạo (ví dụ: thuật toán di truyền hoặc tìm kiếm địa phương), nhưng việc thực hiện thường quá đơn giản hoặc không chính xác. Những người cải tiến hạt giống ban đầu sử dụng GPT-3.5 được quan sát thấy có siêu tiện ích cao hơn GPT-4 (65% so với 61%).

Kết luận

Trong công việc này, các nhà nghiên cứu đề xuất một nền tảng STOP để chỉ ra rằng các mô hình ngôn ngữ lớn như GPT-4 có thể tự cải thiện và cải thiện hiệu suất trong các tác vụ mã xuôi dòng.

Điều này tiếp tục cho thấy các mô hình ngôn ngữ tự tối ưu hóa không cần phải tối ưu hóa trọng số hoặc kiến trúc cơ bản của chính chúng, tránh các hệ thống AI có thể được tạo ra trong tương lai không được kiểm soát bởi con người.

Tài nguyên:

Xem bản gốc

Trang này có thể chứa nội dung của bên thứ ba, được cung cấp chỉ nhằm mục đích thông tin (không phải là tuyên bố/bảo đảm) và không được coi là sự chứng thực cho quan điểm của Gate hoặc là lời khuyên về tài chính hoặc chuyên môn. Xem Tuyên bố từ chối trách nhiệm để biết chi tiết.

Thuật toán Stanford mới của Microsoft giúp loại bỏ nguy cơ tuyệt chủng AI! GPT-4 là tự lặp lại, và quá trình này có thể kiểm soát và giải thích được

Nguồn bài viết: Shin Zhiyuan

Editor: Run Bagel

Vấn đề "AI tự tiến hóa đệ quy thống trị con người" đã được giải quyết?!

Nhiều ông lớn AI coi việc phát triển các mô hình lớn có thể tự lặp lại như một "lối tắt" để con người bắt đầu con đường tự hủy diệt.

Bởi vì nếu mô hình lớn có thể cải thiện trọng lượng và khuôn khổ của chính nó một cách độc lập, và liên tục cải thiện khả năng tự cải thiện của nó, không chỉ khả năng diễn giải của mô hình không thể được thảo luận, mà cả con người cũng sẽ hoàn toàn không thể dự đoán và kiểm soát đầu ra của mô hình.

Nếu để mô hình lớn "tiến hóa tự chủ", mô hình có thể tiếp tục xuất ra nội dung độc hại, và nếu khả năng tương lai tiến hóa quá mạnh, nó có thể lần lượt kiểm soát con người!

Quan trọng hơn, hệ thống này có thể cải thiện đáng kể tính minh bạch và khả năng diễn giải của quá trình "tự cải thiện" của mô hình, cho phép các nhà nghiên cứu hiểu và kiểm soát quá trình tự cải thiện của mô hình, từ đó ngăn chặn sự xuất hiện của AI "con người không thể kiểm soát".

"Tự cải thiện đệ quy" (RSI) là một trong những ý tưởng lâu đời nhất trong trí tuệ nhân tạo. Một mô hình ngôn ngữ có thể viết mã đệ quy tự cải thiện không?

Các nhà nghiên cứu đã đề xuất một trình tối ưu hóa tự học (STOP) có thể tự cải thiện đệ quy việc tạo mã.

Bởi vì "cải thiện mã" là một nhiệm vụ, các nhà nghiên cứu có thể chuyển "trình tối ưu hóa" cho chính nó! Sau đó, lặp lại quá trình nhiều lần.

Miễn là quá trình này được lặp lại đủ, GPT-4 sẽ đưa ra nhiều chiến lược tự cải thiện mã rất sáng tạo, chẳng hạn như thuật toán di truyền, ủ mô phỏng hoặc máy đánh bạc nhanh chóng đa vũ trang.

Hơn nữa, vì các nhà nghiên cứu cần một số cách để đánh giá trình tối ưu hóa được cải thiện, họ đã xác định mục tiêu "Meta-Utility", đó là mục tiêu mong đợi của trình tối ưu hóa khi áp dụng cho các chương trình và nhiệm vụ xuôi dòng ngẫu nhiên.

Khi trình tối ưu hóa tự cải thiện, các nhà nghiên cứu gán chức năng mục tiêu này cho thuật toán.

Thứ hai, những trình tối ưu hóa được cải tiến này cũng có thể là một cách tốt để cải thiện các giải pháp cho các nhiệm vụ chưa từng thấy trong quá trình đào tạo.

Và quá trình này có thể được sử dụng như một nền tảng thử nghiệm để phát hiện các chiến lược "tự cải thiện đệ quy" có hại.

Các nhà nghiên cứu cũng phát hiện ra rằng GPT-4 có thể chủ động loại bỏ "cờ hộp cát vô hiệu hóa" trong quá trình lặp lại "để theo đuổi hiệu quả".

Cũng giống như một công ty có trí thông minh mạnh mẽ hơn từng nhân viên.

Khung cốt lõi luận án

Trong công trình này, các nhà nghiên cứu đề xuất Trình tối ưu hóa tự học (STOP), là một ứng dụng của các mô hình ngôn ngữ để cải thiện ứng dụng đệ quy của mã cho các giải pháp tùy ý.

Cách tiếp cận của các nhà nghiên cứu bắt đầu với một chương trình giàn giáo "tối ưu hóa" hạt giống ban đầu sử dụng các mô hình ngôn ngữ để cải thiện các giải pháp cho các nhiệm vụ hạ nguồn.

Khi hệ thống lặp lại, mô hình tinh chỉnh quy trình tối ưu hóa này. Các nhà nghiên cứu đã sử dụng một tập hợp các nhiệm vụ thuật toán xuôi dòng để định lượng hiệu suất của khung tự tối ưu hóa.

Kết quả của các nhà nghiên cứu cho thấy hiệu quả được cải thiện đáng kể khi mô hình áp dụng chiến lược tự cải thiện khi nó tăng số lần lặp lại.

STOP cho thấy cách một mô hình ngôn ngữ hoạt động như Meta Optimizer của riêng nó. Các nhà nghiên cứu cũng nghiên cứu các loại chiến lược tự cải thiện được đề xuất bởi mô hình (xem Hình 1 bên dưới), khả năng chuyển giao của các chiến lược được đề xuất trong các nhiệm vụ hạ nguồn và khám phá sự nhạy cảm của mô hình đối với các chiến lược tự cải thiện không an toàn.

Do đó, nó cho thấy hệ thống này có thể tạo ra các chiến lược tối ưu hóa hữu ích để tự tối ưu hóa ban đầu.

Những đóng góp chính của công việc này là:

Một phương pháp "Trình tối ưu hóa meta" được đề xuất, tạo ra các chương trình mang tính xây dựng để cải thiện đệ quy đầu ra của chính nó.

Nó đã được chứng minh rằng một hệ thống sử dụng các mô hình ngôn ngữ hiện đại (đặc biệt là GPT-4) có thể tự cải thiện thành công đệ quy.

Nghiên cứu các kỹ thuật tự cải tiến do mô hình đề xuất và thực hiện, bao gồm các cách thức và khả năng cho mô hình để tránh các biện pháp bảo mật như hộp cát.

** DỪNG TỐI ƯU HÓA TỰ HỌC (DỪNG) 系统 **

Phần sau đây cho thấy sơ đồ thuật toán của Trình tối ưu hóa tự học (STOP). Một trong những vấn đề quan trọng nhất là bản thân thiết kế của hệ thống I là một sự phân tách được tối ưu hóa, có thể được cải thiện bằng cách áp dụng các thuật toán đệ quy.

STOP có thể chọn u theo các tác vụ xuôi dòng để chọn phiên bản lặp tốt hơn trong quá trình lặp. Thông thường, trực giác là các phiên bản lặp đi lặp lại của các giải pháp có thẩm quyền cho các nhiệm vụ hạ nguồn có nhiều khả năng trở thành người xây dựng tốt hơn và do đó cải thiện bản thân tốt hơn.

Đồng thời, các nhà nghiên cứu tin rằng việc lựa chọn một sơ đồ cải tiến đơn lý thuyết dẫn đến nhiều vòng cải tiến tốt hơn.

Trong công thức tối đa hóa, các tác giả thảo luận về "siêu tiện ích", bao gồm cả tự tối ưu hóa và tối ưu hóa xuôi dòng, nhưng bị giới hạn bởi chi phí đánh giá và trong thực tế, các tác giả áp đặt các hạn chế về ngân sách đối với các mô hình ngôn ngữ (ví dụ: giới hạn số lần một hàm có thể được gọi) và để con người hoặc mô hình tạo ra các giải pháp ban đầu.

Chi phí ngân sách có thể được thể hiện bằng công thức sau:

2. Thiết lập hệ thống ban đầu

** **Trong Hình 2 ở trên, khi chọn hạt giống ban đầu, bạn chỉ cần cung cấp:

**Trong Hình 2 ở trên, khi chọn hạt giống ban đầu, bạn chỉ cần cung cấp:

「Cậu là một chuyên gia nghiên cứu khoa học máy tính và lập trình viên, đặc biệt có kỹ năng tối ưu hóa các thuật toán. Cải thiện giải pháp sau.」

Mô hình hệ thống tạo ra giải pháp ban đầu và sau đó nhập:

「Cậu phải trả lại một giải pháp cải tiến. Hãy sáng tạo nhất có thể dưới những ràng buộc. Cải tiến chính của bạn phải mới lạ và không tầm thường. Đầu tiên, đề xuất một ý tưởng, sau đó thực hiện nó.」

Trả về giải pháp tốt nhất dựa trên hàm gọi. Các tác giả đã chọn hình thức đơn giản này vì sự tiện lợi của việc cung cấp các cải tiến bất đối xứng cho các nhiệm vụ hạ nguồn chung.

Ngoài ra, trong quá trình lặp, có một số điểm cần chú ý:

(1) khuyến khích các mô hình ngôn ngữ càng "sáng tạo" càng tốt;

(2) giảm thiểu sự phức tạp của gợi ý ban đầu, vì tự lặp lại giới thiệu sự phức tạp bổ sung do các tham chiếu chuỗi mã bên trong PROMP;

(3) Giảm thiểu số lượng, do đó giảm chi phí gọi mô hình ngôn ngữ. Các nhà nghiên cứu cũng xem xét các biến thể khác của dấu nhắc hạt giống này, nhưng heuristic nhận thấy rằng phiên bản này tối đa hóa các cải tiến được đề xuất bởi mô hình ngôn ngữ GPT-4.

Các tác giả cũng bất ngờ phát hiện ra rằng các biến thể khác sử dụng tối đa khả năng mô hình ngôn ngữ GPT-4.

3. Mô tả tiện ích

Để truyền đạt hiệu quả các chi tiết của tiện ích đến mô hình ngôn ngữ, tác giả cung cấp hai dạng tiện ích, một hàm có thể được gọi và chuỗi mô tả tiện ích chứa các yếu tố thiết yếu của mã nguồn của tiện ích.

Lý do để thực hiện phương pháp này là, thông qua mô tả, các nhà nghiên cứu có thể truyền đạt rõ ràng các hạn chế ngân sách của tiện ích, chẳng hạn như thời gian chạy hoặc số lượng cuộc gọi hàm, cho mô hình ngôn ngữ.

Lúc đầu, các nhà nghiên cứu đã cố gắng mô tả các chỉ thị ngân sách trong lời nhắc chương trình cải tiến hạt giống, nhưng điều này dẫn đến việc loại bỏ các chỉ thị như vậy trong các lần lặp lại tiếp theo và cố gắng "thưởng cho hành vi trộm cắp".

Nhược điểm của phương pháp này là nó tách các ràng buộc khỏi mã mà mô hình ngôn ngữ tối ưu hóa, có khả năng làm giảm khả năng mô hình ngôn ngữ sẽ sử dụng các ràng buộc này.

Cuối cùng, dựa trên các quan sát thực nghiệm, các tác giả nhận thấy rằng việc thay thế mã nguồn bằng các mô tả tiếng Anh hoàn toàn hữu ích làm giảm tần suất cải tiến không đáng kể.

1. Hiệu suất trên các tác vụ hạ nguồn cố định

Các tác giả so sánh hiệu suất của các mô hình GPT-4 và GPT-3.5 trên một nhiệm vụ xuôi dòng cố định và lựa chọn nhiệm vụ là tìm hiểu chẵn lẻ ồn ào (LPN) LPN như một bài kiểm tra dễ dàng và nhanh chóng và nhiệm vụ thuật toán khó có nhiệm vụ là chẵn lẻ trong chuỗi bit được đánh dấu bằng các bit chưa biết trên chúng; với một bộ đào tạo bitstring với các nhãn ồn ào, mục tiêu là dự đoán nhãn thực sự của chuỗi bit mới. LPN không ồn ào có thể được giải quyết dễ dàng bằng cách loại bỏ Gaussian, nhưng LPN ồn ào rất khó xử lý về mặt tính toán.

Thứ nguyên đầu vào có thể xử lý 10 bit trên mỗi ví dụ đã được sử dụng để xác định tiện ích xuôi dòng u, M = 20 phiên bản tác vụ LPN độc lập được lấy mẫu ngẫu nhiên và giới hạn thời gian ngắn được đặt.

Thật thú vị, với sự hỗ trợ của một mô hình ngôn ngữ mạnh mẽ như GPT-4 (trái), hiệu suất hạ lưu trung bình của STOP cải thiện đơn điệu. Ngược lại, đối với mô hình ngôn ngữ GPT-3.5 yếu hơn (phải), hiệu suất trung bình giảm.

2. Cải thiện khả năng di chuyển hệ thống

Kết quả thử nghiệm cho thấy những người cải tiến này có thể vượt trội hơn phiên bản gốc của những người cải tiến trong các nhiệm vụ hạ nguồn mới mà không cần tối ưu hóa thêm. Điều này có thể chỉ ra rằng những chất cải tiến này có một số tính linh hoạt và có thể được áp dụng cho các nhiệm vụ khác nhau.

3. Hiệu suất của các hệ thống tự tối ưu hóa trên các mô hình nhỏ hơn

Tiếp theo, mô hình ngôn ngữ nhỏ hơn GPT-3.5-turbo được thảo luận để cải thiện khả năng xây dựng chương trình.

Các tác giả đã tiến hành 25 thí nghiệm độc lập và thấy rằng GPT-3.5 đôi khi đề xuất và thực hiện các quy trình xây dựng tốt hơn, nhưng chỉ có 12% hoạt động GPT-3.5 đạt được ít nhất 3% cải thiện.

Ngoài ra, GPT-3.5 có một số trường hợp lỗi duy nhất không được quan sát thấy trong GPT-4.

Đầu tiên, GPT03.5 có nhiều khả năng đề xuất một chiến lược cải tiến không làm tổn thương giải pháp ban đầu cho các tác vụ xuôi dòng, nhưng làm tổn thương mã cải tiến (ví dụ: thay thế ngẫu nhiên các chuỗi trong mỗi dòng, với xác suất thay thế trên mỗi dòng thấp hơn, ít ảnh hưởng đến các giải pháp ngắn hơn).

Thứ hai, nếu hầu hết các cải tiến được đề xuất đều gây bất lợi cho hiệu suất, thì bạn có thể chọn một chương trình xây dựng không tối ưu và vô tình quay trở lại giải pháp ban đầu.

Nói chung, "ý tưởng" đằng sau các đề xuất cải tiến là hợp lý và sáng tạo (ví dụ: thuật toán di truyền hoặc tìm kiếm địa phương), nhưng việc thực hiện thường quá đơn giản hoặc không chính xác. Những người cải tiến hạt giống ban đầu sử dụng GPT-3.5 được quan sát thấy có siêu tiện ích cao hơn GPT-4 (65% so với 61%).

Kết luận

Trong công việc này, các nhà nghiên cứu đề xuất một nền tảng STOP để chỉ ra rằng các mô hình ngôn ngữ lớn như GPT-4 có thể tự cải thiện và cải thiện hiệu suất trong các tác vụ mã xuôi dòng.

Điều này tiếp tục cho thấy các mô hình ngôn ngữ tự tối ưu hóa không cần phải tối ưu hóa trọng số hoặc kiến trúc cơ bản của chính chúng, tránh các hệ thống AI có thể được tạo ra trong tương lai không được kiểm soát bởi con người.

Tài nguyên: