- 話題1/3

16796 熱度

170552 熱度

24462 熱度

25 熱度

29 熱度

- 置頂

- Gate 合約開倉激勵計劃火熱上線!零門檻瓜分 50,000 ERA

開倉即有獎,交易越多獎勵越多!

新用戶享 20% 加成!

立即參與:https://www.gate.com/campaigns/1692?pid=X&ch=NGhnNGTf

活動詳情:https://www.gate.com/announcements/article/46429

#Gate # #合约交易 # #ERA#

- 👀 家人們,最近你們都攢了多少 Alpha 積分啦?

空投領到了沒?沒搶到也別急,廣場給你整點額外福利!

🎁 曬出你的 Alpha 收益,咱們就送你$200U代幣盲盒獎勵!

🥇 積分最高曬圖用戶 1 名 → $100 代幣盲盒

✨ 積分榜前五優質分享者 5 名 → 各得 $20 代幣盲盒

📍【怎麼玩】

1️⃣ 帶上話題 #晒出我的Alpha积分收益# 發廣場貼

2️⃣ 曬 Alpha 積分截圖 + 一句話總結:“我靠 Gate Alpha 賺了 ____,真的香!”

👉 還可以分享你的攢分技巧、兌換經驗、積分玩法,越乾貨越容易中獎!

📆【活動時間】

8月4日 18:00 - 8月10日 24:00 (UTC+8)

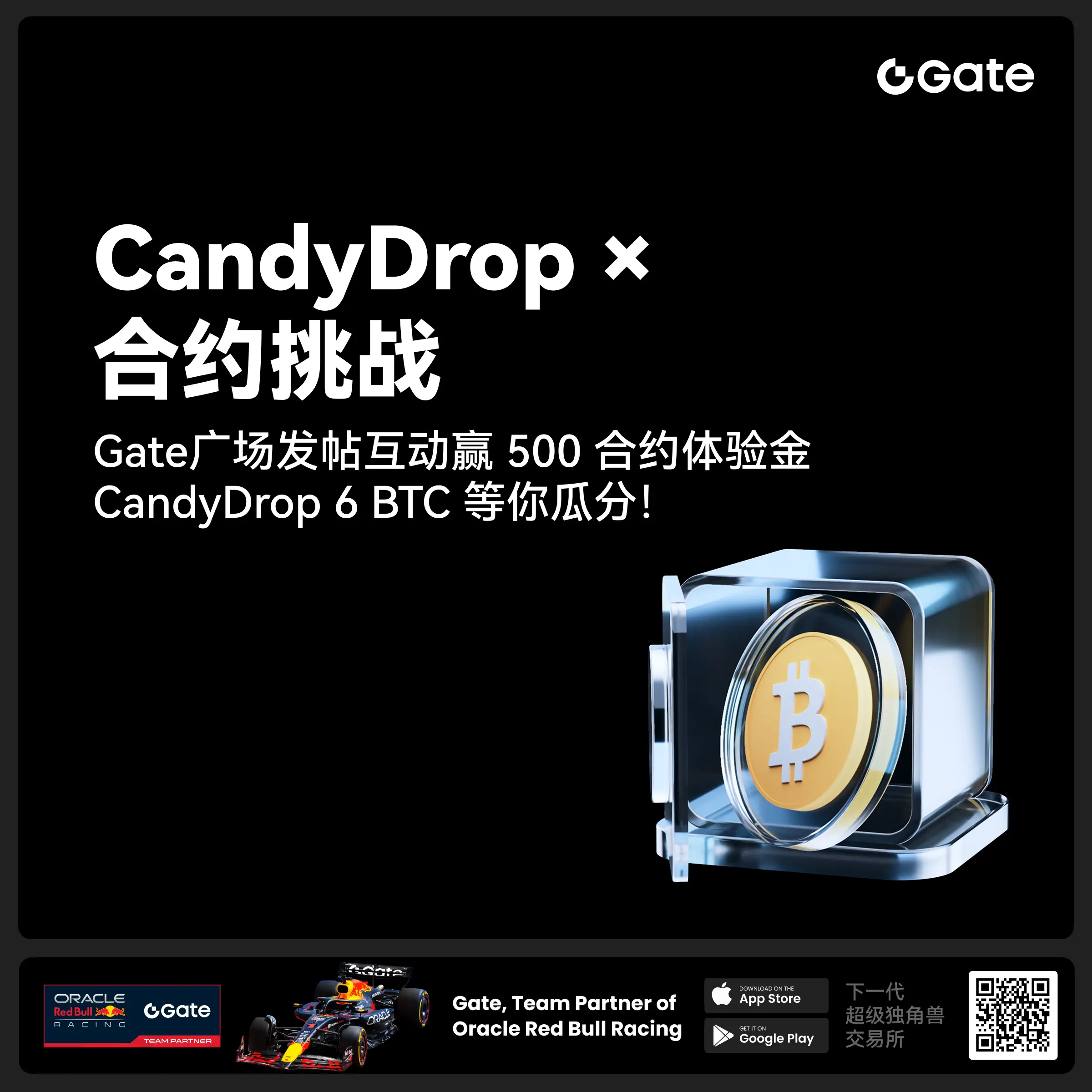

- 🎉 #CandyDrop合约挑战# 正式開啓!參與即可瓜分 6 BTC 豪華獎池!

📢 在 Gate 廣場帶話題發布你的合約體驗

🎁 優質貼文用戶瓜分$500 合約體驗金券,20位名額等你上榜!

📅 活動時間:2025 年 8 月 1 日 15:00 - 8 月 15 日 19:00 (UTC+8)

👉 活動連結:https://www.gate.com/candy-drop/detail/BTC-98

敢合約,敢盈利

- 🎉 攢成長值,抽華爲Mate三折疊!廣場第 1️⃣ 2️⃣ 期夏季成長值抽獎大狂歡開啓!

總獎池超 $10,000+,華爲Mate三折疊手機、F1紅牛賽車模型、Gate限量週邊、熱門代幣等你來抽!

立即抽獎 👉 https://www.gate.com/activities/pointprize?now_period=12

如何快速賺成長值?

1️⃣ 進入【廣場】,點擊頭像旁標識進入【社區中心】

2️⃣ 完成發帖、評論、點讚、發言等日常任務,成長值拿不停

100%有獎,抽到賺到,大獎等你抱走,趕緊試試手氣!

截止於 8月9日 24:00 (UTC+8)

詳情: https://www.gate.com/announcements/article/46384

#成长值抽奖12期开启#

- 📢 Gate廣場 #NERO发帖挑战# 秀觀點贏大獎活動火熱開啓!

Gate NERO生態周來襲!發帖秀出NERO項目洞察和活動實用攻略,瓜分30,000NERO!

💰️ 15位優質發帖用戶 * 2,000枚NERO每人

如何參與:

1️⃣ 調研NERO項目

對NERO的基本面、社區治理、發展目標、代幣經濟模型等方面進行研究,分享你對項目的深度研究。

2️⃣ 參與並分享真實體驗

參與NERO生態周相關活動,並曬出你的參與截圖、收益圖或實用教程。可以是收益展示、簡明易懂的新手攻略、小竅門,也可以是行情點位分析,內容詳實優先。

3️⃣ 鼓勵帶新互動

如果你的帖子吸引到他人參與活動,或者有好友評論“已參與/已交易”,將大幅提升你的獲獎概率!

NERO熱門活動(帖文需附以下活動連結):

NERO Chain (NERO) 生態周:Gate 已上線 NERO 現貨交易,爲回饋平台用戶,HODLer Airdrop、Launchpool、CandyDrop、餘幣寶已上線 NERO,邀您體驗。參與攻略見公告:https://www.gate.com/announcements/article/46284

高質量帖子Tips:

教程越詳細、圖片越直觀、互動量越高,獲獎幾率越大!

市場見解獨到、真實參與經歷、有帶新互動者,評選將優先考慮。

帖子需原創,字數不少於250字,且需獲得至少3條有效互動

圖靈獎得主吵起來了,LeCun:Bengio、Hinton 等的 AI 滅絕論是荒謬的

來源:機器之心

關於 AI 風險的問題,各路大佬們也是意見不統一。 有人帶頭簽署聯名信,呼籲 AI 實驗室應立即暫停研究,深度學習三巨頭 Geoffrey Hinton、Yoshua Bengio 等都支援這一觀點。

就在近幾日,Bengio、Hinton 等再發聯名信《在快速發展的時代管理人工智慧風險》,呼籲在開發 AI 系統之前,研究者應該採取緊急治理措施,將安全和道德實踐納入重點,呼籲各國政府應該採取行動,管理 AI 帶來的風險。

文中提到了一些緊急治理措施,例如,讓國家機構也參與進來,從而防止人們對 AI 的濫用。 為了實現有效的監管,政府需要全面瞭解人工智慧的發展。 監管機構應採取一系列措施,如模型註冊、對舉報人進行有效保護以及對模型開發和超級計算機使用的監控等。 監管機構還需要在部署之前訪問先進的人工智慧系統,以評估其危險功能。

不僅如此,時間再往前一點,今年五月,美國非營利組織人工智慧安全中心發表了一份聲明,警告人工智慧應被視為與流行病一樣存在滅絕人類的風險,支援該聲明的人同樣包括Hinton、Bengio等人。

今年 5 月,為了暢所欲言地談論人工智慧帶來的風險,Hinton 還辭去了在谷歌的工作。 在一次紐約時報的採訪中,他表示:「大多數人認為這(AI 危害)還很遙遠。 我過去也認為這還很遙遠,可能是 30 到 50 年甚至更長的時間。 但顯然,我現在不這麼想了。」

可以預見,在Hinton等 AI 大佬眼裡,管理 AI 帶來的風險是一項非常緊急的事情。

然而,作為深度學習三巨頭之一的 Yann LeCun,對 AI 發展持有非常樂觀的態度。 對於簽署關於 AI 風險的聯名信,他基本上都是持反對態度,認為人工智慧的發展遠未構成對人類的威脅。

剛剛, LeCun 在與 X 使用者的交流中,對網友的一些關於 AI 風險的問題給出了回答。

LeCun 對這篇文章的反應是這樣的,他不希望英國對 AI 存在宿命論風險的擔憂傳播給其他國家。

「Altman、Hassabis 以及 Amodei 正在進行大規模的企業遊說。 他們正嘗試對 AI 產業進行監管。 而你、Geoff,還有 Yoshua 正在給那些遊說禁止開放 AI 研究的人提供『彈藥』。

如果你們的恐懼宣傳活動取得成功,將不可避免地造成你我都認為是災難的結果:少數公司將控制 AI。

絕大多數學術同行都非常支持開放式 AI 研發。 很少有人相信你所鼓吹的末日場景。 你、Yoshua、Geoff 和 Stuart 是唯一的例外。

和許多人一樣,我非常支持開放式 AI 平臺,因為我相信各種力量的結合:人們的創造力、民主、市場力量和產品法規。 我也知道,生產安全且受我們控制的 AI 系統是可能的。 我已經為此提出了具體建議。 這一切都將促使人們做正確的事。

你寫得好像 AI 是憑空產生的,它是我們無法控制的自然現象。 但事實並非如此。 它之所以取得進步,是因為你我所認識的每一個人。 我們和他們都有能力打造『正確的事物』。 要求對研發(相對於產品部署)進行監管,其實暗含了這樣的假設:這些人和他們所服務的組織都是無能、魯莽、自我毀滅或者邪惡的。 但事實並非如此。

我已經提出了很多論據來證明你所害怕的末日場景是荒謬的。 在此我就不再贅述了。 但主要的一點是,如果強大的 AI 系統是由目標(包括護欄)驅動的,那麼它們就會是安全可控的,因為他們設定了這些護欄和目標。 (目前的自回歸 LLM 並不是由目標驅動的,所以我們不要從自回歸 LLM 的弱點來推斷)。

關於開源這件事,你的活動所產生的效果將與你所追求的完全相反。 在未來,AI 系統將成為人類所有知識和文化的寶庫,我們需要的是開源和免費的平臺,以便每個人都能為之做出貢獻。 開放是讓 AI 平臺反映人類全部知識和文化的唯一途徑。 這就要求對這些平臺的貢獻是眾包的,類似於維琪百科。 除非平臺是開放的,否則這樣做是行不通的。

如果開放原始程式碼的 AI 平臺被監管,那麼另一種情況將一定發生,那就是少數公司將控制 AI 平臺,進而控制人們的全部數字依賴。 這對民主意味著什麼? 這對文化多樣性意味著什麼? 這是讓我徹夜難眠的原因。」

在 LeCun 長推文的下方,也有許多人「聲援」他的觀點。

蒙特利爾大學計算機科學與運籌學系教授 Irina Rish,也是 Mila - Quebec AI 研究所的核心成員。 她表示或許支持開源 AI 的研究人員們不應該再沉默了,應該引領新興 AI 的發展。

博客主持人 Lex Fridman 對這場辯論有更多的期待。